Modellansatz

252 episodes — Page 5 of 6

Strukturoptimierung

Peter Allinger und Nick Stockelkamp optimieren bei der Dassault Systèmes in Karlsruhe Formen, Strukturen und Strömungen im Bereich des Maschinenbaus. Anwendungsbeispiele reichen vom Zahnimplantat bis zum Schiffsdiesel und typische Optimierungskriterien sind Gewicht, Fertigungskosten und Haltbarkeit. Dabei hat sich der Fokus von einfachen Fragestellungen wie der Durchbiegung hin zu komplexen Fragestellungen wie der Geräuschentwicklung. In der Fluid-Optimierung geht es unter anderem um die Reduzierung von Druckverlusten, der Vermeidung von Turbulenzen oder auch Verbesserung von Wärmetauschern, beispielweise unterstützt durch den Löser OpenFOAM. Dabei gibt es unterschiedliche Vorhegensweisen: Man kann entweder die Veränderung der Objekte durch Hinzufügen oder Abziehen von Material hervorrufen, oder man berechnet die Sensitivität der Zielgröße bezüglich Veränderungen an den Oberflächen. Der mögliche Design-Raum wird in vielen Anwendungen mit der Finite-Elemente-Methode diskretisiert, um zu einem lösbaren Problem zu gelangen, wobei Strömungen oft mit Finite-Volument-Verfahren gelöst werden. Die zentrale Frage ist jedoch, wann man ein Bauteil als optimal bezeichnen kann. Hier hat Prof. Eckart Schnack in den 70er Jahren den Ansatz beschrieben, dass eine gleichmäßige Spannungsverteilung eines beanspruchten Bauteils ein optimales Bauteil auszeichnen kann. Im Fall von strukturmechanischen Belastungen gibt es für diesen Optimalitätsbegriff iterative Löser, jedoch sind Fragestellungen im Umfeld von Eigenwertprobleme noch ein offenes Forschungsgebiet. Literatur und Zusatzinformationen Schnack, E. "Ein Iterationsverfahren zur Optimierung von Spannungskonzentrationen." Inaugural Dissertation, Kaiserslautern University (1977).

Erdrutsche

Katharina Elsen ist für 6 Monate aus Bologna im Rahmen eines Forschungsaufenthalts nach Karlsruhe gekommen. In Ihrer Forschungsgruppe zur numerischen Geophysik sind Tsunamis im Mittelmeerraum, wie beispielsweise im Raum von Italien und der Türkei, das Hauptforschungsgebiet. Ein Auslöser für Tsunamis sind Erdbeben, aber auch Erdrutsche können der Grund für die großen Wasserwellen sein, die dann sogar eine globale Auswirkung haben können. Im Varjont-Tal kam es 1963 nach dem Aufstauen eines Stausees zu einem Landrutsch. Dieser führte zu einer Tsnuamiwelle im Stausee, die in ihrer Größe weit unterschätzt wurde, und zur schrecklichen Tragödie von Langarone führte. Solche Vorgänge können natürlich auch in Küstengebieten auftreten und die gegenüberliegenden Küsten gefährden. Im Gegensatz zu sehr plötzlichen seismischen Aktivitäten können Landrutsche weit langfristigere Vorgänge sein. Auch können die sich bewegenden Landmassen aus beweglichem Schlamm oder feinem Geröll bestehen oder aus eher festen Bestandteilen. Dies beeinflusst stark die möglichen Modelle, und Katharina Elsen beschreibt im Gespräch mit Gudrun Thäter ihre Modelle und Forschung zu Landrutschen von Bergabschnitten, die sich eher wie ein Festkörper als wie ein Fluid verhalten. Die Landmassen werden in einige Festkörper-Masseblöcke aufgeteilt, die jeweils Massenzentren bzw. Baryzentren besitzen und deren Berandung bekannt ist. Daraus wird die individuelle Bewegung der Blöcke modelliert, wie auch die gegenseitige Beeinflussung auf verschiedene Arten. Letztlich wird dann untersucht, wie die Blöcke letztlich durch Geschwindigkeit und Form auf das Wasser wirken, um bessere Aussagen über resultierende Wellenhöhe treffen zu können. Der erste Schritt zur Simulation ist die Zerlegung der gleitenden Oberflächen in Dreiecke, und dann wird die Bewegung der einzelnen Massepunkte für das vereinfachte Modell durch die klassische Newtonsche Mechanik zunächst exakt berechnet. Für die Beeinflussung der Massepunkte zueinander werden verschiedene approximierende Modelle erforscht, und Parameter entsprechend den Beobachtungen identifiziert. Die Ansätze und Modelle fließen in eine Software zur Erdrutschsimulation, die auch im Bereich der Reibungsmodelle überarbeitet wurde: Da auf triangulisierten Oberflächen alle Funktionen und Eigenschaften dort bisher nur in linearisierter Form auftreten, können höhere Ableitungen nur über erweiterte Modelle approximiert werden. Literatur und Zusatzinformationen F. Zaniboni, S. Tinti: Numerical simulations of the 1963 Vajont landslide, Italy: application of 1D Lagrangian modelling, Natural hazards 70.1: 567-592, 2014. S. Tinti, P. Gianluca, Z. Filippo: The landslides and tsunamis of the 30th of December 2002 in Stromboli analysed through numerical simulations, Bulletin of Volcanology 68.5, 462-479, 2006. S. Tinti: How can we defend ourselves from the hazard of Nature in the modern society?, GIFT 2013, Natural Hazards Geosciences Information for Teachers Workshop, Vienna, Austria, 2013. Podcast Modellansatz 012: Erdbeben und optimale Versuchsplanung Podcast Modellansatz 015: Lawinen und Muren

Flipped Classroom

An Pädagogischen Hochschulen werden Lehrerinnen und Lehrer für fast alle Schulformen ausgebildet, es gibt sie inzwischen in Deutschland nur noch in Baden-Württemberg. Beispielsweise seien die Pädagogische Hochschule Heidelberg und die Pädagogische Hochschule Karlsruhe genannt- hier in Karlsruhe gibt es zusätzlich auch eine Abteilung für Didaktik an der Fakultät für Mathematik am KIT. An den pädagogischen Hochschulen werden aber nicht nur Pädagogik und Didaktik unterrichtet, sondern auch die entsprechenden Fachrichtungen und jeweilige didaktische Konzepte in diesen Fachrichtungen. Christian Spannagel unterrichtet so als Professor für Mathematik und Informatik in den Fächern, und erzählt im Gespräch mit Sebastian Ritterbusch, wie er didaktische Konzepte für den Mathematikunterricht erforscht und aktiv erprobt. Die Frage nach Verbesserung des Mathematik-Unterrichts ist sehr aktuell: Die OECD-Studie zu Geschlechtsunterschieden in der Schule hat gerade in Mathematik Verbesserungspotential aufgezeigt, denn viele geben Mathe auf, weil sie nachweislich fälschlich glauben, sie könnten es nicht. Der zentrale Begriff ist hier die Selbstwirksamkeitserwartung, die insbesondere in Naturwissenschaften und Mathematik durch gesellschaftliche Einflüsse stark geprägt ist. Die Erforschung neuer Lehrmethoden kann aber nicht den Ersatz der bisherigen und erprobten Konzepte zum Ziel haben: So sind selbst vermeintlich alte Übungen zum Kopfrechnen und zur schriftlichen Division auch heute noch überaus wichtige Hilfen zur Vermittlung von Algorithmen, Stellenwertsystemen und auch zur Vorbereitung auf ein Studium. Das Ziel muss sein, den Fundus möglicher Vermittlungsformen zu bereichern, und für verschiedene Konzepte bessere Kombinationen der Verfahren zu finden. Ein nützliches neues Werkzeug ist die Tabellenkalkulation, mit der beispielsweise Würfelexperimente und Simulationen im Unterricht interaktiv erfahrbar gemacht werden können. Ebenso können Dynamische Geometriesysteme den Zugang zur Konstruktion und Analytischer Geometrie, wie beispielsweise den Satz des Thales, deutlich vereinfachen. Die Software GeoGebra ist ein solches System, das insbesondere auch unterschiedliche Darstellungen und Analyse der Konstruktionen ermöglicht. Leider ist es zu Zeit noch nicht möglich, dass in Klassen jederzeit an jedem Platz ein Rechner zum Einsatz interaktiver Experimente vorhanden ist. Aber auch an einem interaktiven Whiteboard können die Methoden durchgeführt werden. Die technische Ausstattung ist aber nur ein kleiner Schritt zur Einführung neuer Werkzeuge in den Unterricht, auch die Lehrerinnen und Lehrer müssen die Kompetenzen zum Einsatz der neuen Medien erlernen. Hier müssen die pädagogischen Hochschulen den Lehramtsstudierenden den Weg bereiten, damit das Lehrpersonal zu Beginn und auch in ihrer langen Lehrzeit für den Stand und die Entwicklung der Technik vorbereitet ist. Auch Wissensmanagement in der Form von Wikis haben in Schulen Einzug gehalten, so setzen Maria Eirich und Andrea Schellmann auf ein Schulwiki am Regiomontanus-Gymnasium Haßfurt und Lernpfade zum interaktiven Mathematik-Unterricht. Auch Schülerinnen und Schüler können hier selbst Quiz-Aufgaben erstellen. Michael Gieding und Andreas Schnirch haben für Geometrie-Vorlesungen an der PH Heidelberg ein Geometrie-Wiki auf dieser Technologie erstellt, das auch weiterhin für Lehrveranstaltungen für Lehramtsstudierende genutzt wird. Eine Einführung in die frühen interaktiven Elemente am CMS der Fakultät für Mathematik sind auf der Fragebogen-Seite mit einer Vielzahl von Beispielen zu finden. Gerade in Mathematik stellt die Einbindung digitaler Medien eine gewisse Hürde dar, da Formeln, Beweise, Algorithmen und Konstruktionszeichnung nicht leicht digitalisierbar sind- auch wenn das Textsatz-System LaTeX oder LyX im mathematischen Bereich mit perfektem Druckbild für fast alles verwendet werden kann, so muss man es erst erlernen- beispielsweise mit der l2kurz-Anleitung. Das Austauschen von abfotografierten Seiten ist da häufig deutlich effektiver. Dabei ein solcher Austausch zwischen den Lernenden sehr zu begrüßen, da es zum einen die gemeinsame Konstruktion von Lösungswegen begünstigt, aber auch die angehenden Lehrenden auf die Nutzung der Medien trainiert. Wichtig sind niederschwellige Zugänge und die Möglichkeit zu anonymen Beiträgen, da nur so das Lernen aus Fehlern ermöglicht wird. Im Flipped Classroom wird der Prozess der interaktiven Auseinandersetzung mit dem Lernstoff, der traditionell zu Hause erst bei den Hausaufgaben auftritt, in den Unterricht gebracht, und der herkömmliche Frontal-Unterricht aus dem Klassenzimmer verbannt. Dazu erhalten die Schülerinnen und Schüler oder die Studierenden zur Vorbereitung ein Video, in dem das grundsätzliche Verfahren erklärt wird. Die Unterrichtsstunde kann dann mit einer Fragerunde zum Videomaterial starten, gefolgt von einigen Aufgaben, die vom Plenum in Gruppenarbeit bearbeitet werden sollen. Hier werden Probleme und Fragen offensicht

Klothoiden

Klothoiden sind Kurven, die 1794 von Jakob I. Bernoulli zuerst beschrieben wurden. Er hatte die Form eines Metallstreifens untersucht, der von einem Gewicht an einem Ende verbogen wird, während das andere Ende eingespannt ist. Als Resultat des elastischen Verhaltens ist dann die Krümmung proportional zur Kurvenlänge. Viele weitere Eigenschaften von Kurven mit dIeser Eigenschaft wurden dann von Leonhard Euler über den Rahmen des Gedankenexperiments von Bernoulli hinaus bewiesen , wie zum Beispiel die Position der asymptotischen Endpunkte. Im Straßen- und Schienenbau sind Klothoiden ausgezeichnete Übergangsbögen zwischen geraden Strecken und Kurven, da diese Kurve die Krümmung zwischen den beiden Abschnitten gleichmäßig anpasst. Bei der Planung von Schienentrassen wurde diese Eigenschaft vor etwa 100 Jahren schon ausgenutzt. Eine aktuelle wichtige Anwendung ist die Abbildung der Straßen in Fahrassistenzsystemen, wo passend parametrisierte Klothoiden große Vorteile gegenüber Splines besitzen, wie Gotami Heller im Gespräch mit Gudrun Thäter erklärt. Um Klothoiden tatsächlich im Computermodell benutzen zu können, muss eine möglichst adäquate Approximation gesucht und implementiert werden, die die nötige Glattheit in der Kurve erhält. Literatur und Zusatzinformationen M. Bäumker: Rechenverfahren der Ingenieurvermessung http://www.eecs.berkeley.edu/Pubs/TechRpts/2008/EECS-2008-111.pdf: R. Levien: The Euler spiral, a mathematical history, Technical Report University of Carlifornia at Berkeley, UCB/EECS-2008-111, 2008. D. Khosla: Accurate estimation of forward path geometry using two-clothoid road model, Intelligent Vehicle Symposium, 2002. IEEE. Vol. 1. IEEE, 2002.

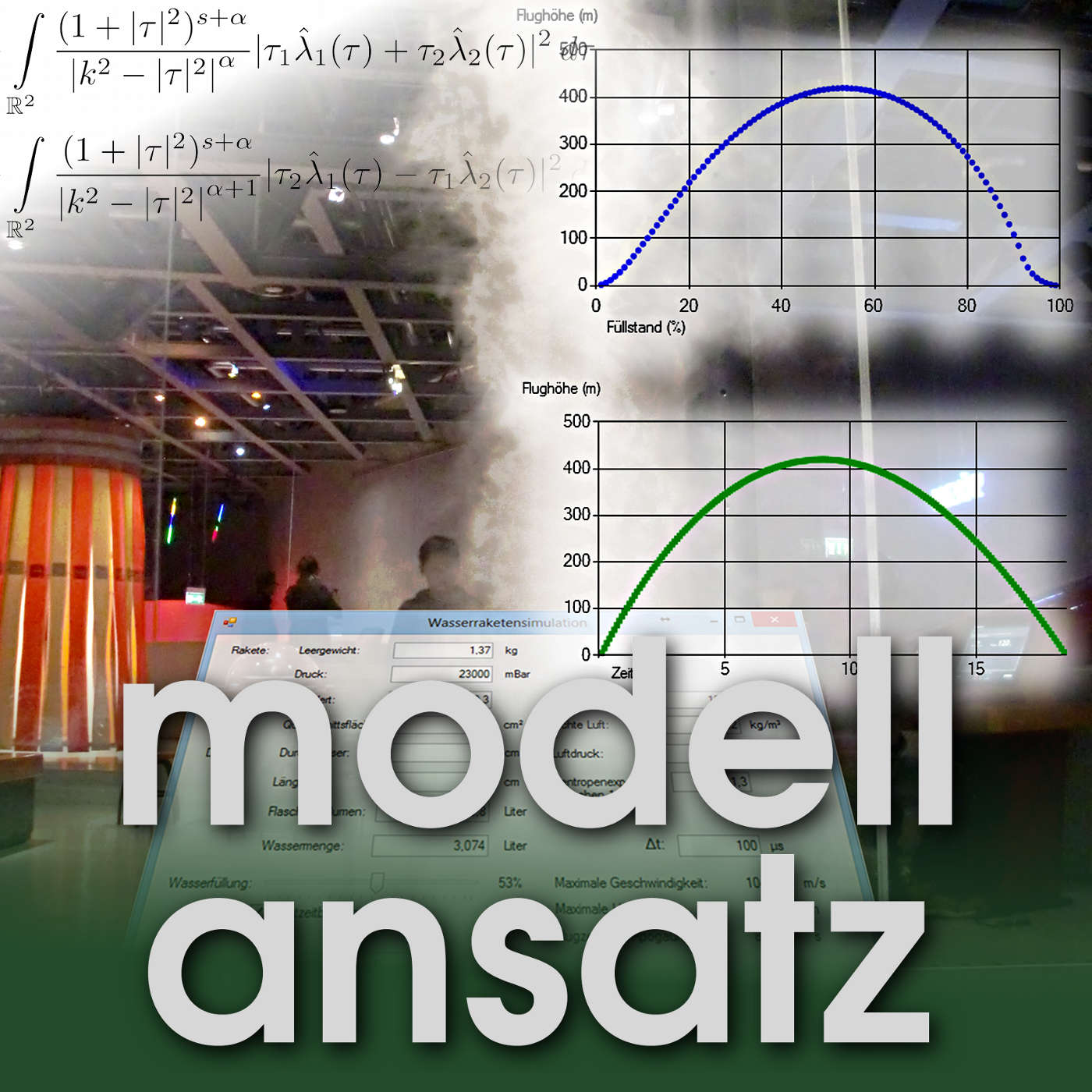

Wasserraketen

Gabriel Thäter ist im Rahmen eines BOGY-Praktikums zum Institut gekommen, um einen Eindruck von der Forschungstätigkeit in der angewandten Mathematik zu erhalten. Dazu befasste er sich mit der Simulation, Auslegung und Optimierung von Wasserraketen, die durch Impulserhaltung ihre Beschleunigung erhalten. Sein Interesse an der Raketentechnik entstand durch die Kerbal Space Program Simulation, in der Raketen und Flugzeuge zur Erfüllung verschiedener Aufträge aufgebaut werden. Die Wasserraketen unterscheiden sich unter anderem durch ihre Bauform, dem zur Befüllung zur Verfügung stehenden Volumen, wie viel Wasser darin mit welchem Druck eingefüllt wird und welche Düse verbaut wurde. Der erste Ansatz die Auswirkung der Düse durch den Druckunterschied mit einer laminaren Strömung zu berechnen, führte zu unrealistischen Ergebnissen, was auf Basis der hohen Reynolds-Zahl zu erwarten war. Ein Ansatz über ein turbulentes Strömungsmodell führte zu sinnvollen Werten für die Rückstoßgeschwindigkeit in diskretisierter zeitlicher Abhängigkeit. Die Berechnung der Steighöhe ist besonders durch die Schwerkraft und den Luftwiderstand abhängig. Neben der Berücksichtigung des sich stark verändernden Gewichts, ist die Bestimmung des geeigneten cW-Werts für den Strömungswiderstand eine große Herausforderung. Neben dem Vergleich mit einfachen Körpern wie Zylindern und Kugeln konnte eine Parameteridentifikation aus experimentellen Messwerten den cW-Wert sinnvoll bestimmen. Die praktische Ausführung des Experiments verfolgt man am Besten bei unseren Kollegen bei Methodisch Inkorrekt, die beim 31C3 ihre Wasserrakete live im Sendezentrum zündeten. Natürlich gibt es auch reine Luftraketen, die beeindruckende Höhen erreichen können. Literatur und Zusatzinformationen J. Prusa: Hydrodynamics of a water rocket, SIAM review 42.4: 719-726, 2000. R. Barrio-Perotti, et al: Experimental evaluation of the drag coefficient of water rockets by a simple free-fall test, European Journal of Physics 30.5: 1039, 2009. Bauanleitung Wasserrakete und Bauanleitung Startrampe vom School-Lab zu Raketenantrieben des Deutschen Zentrums für Luft und Raumfahrt. Raumfahrt Würzburg: Bauanleitung Luftraketen

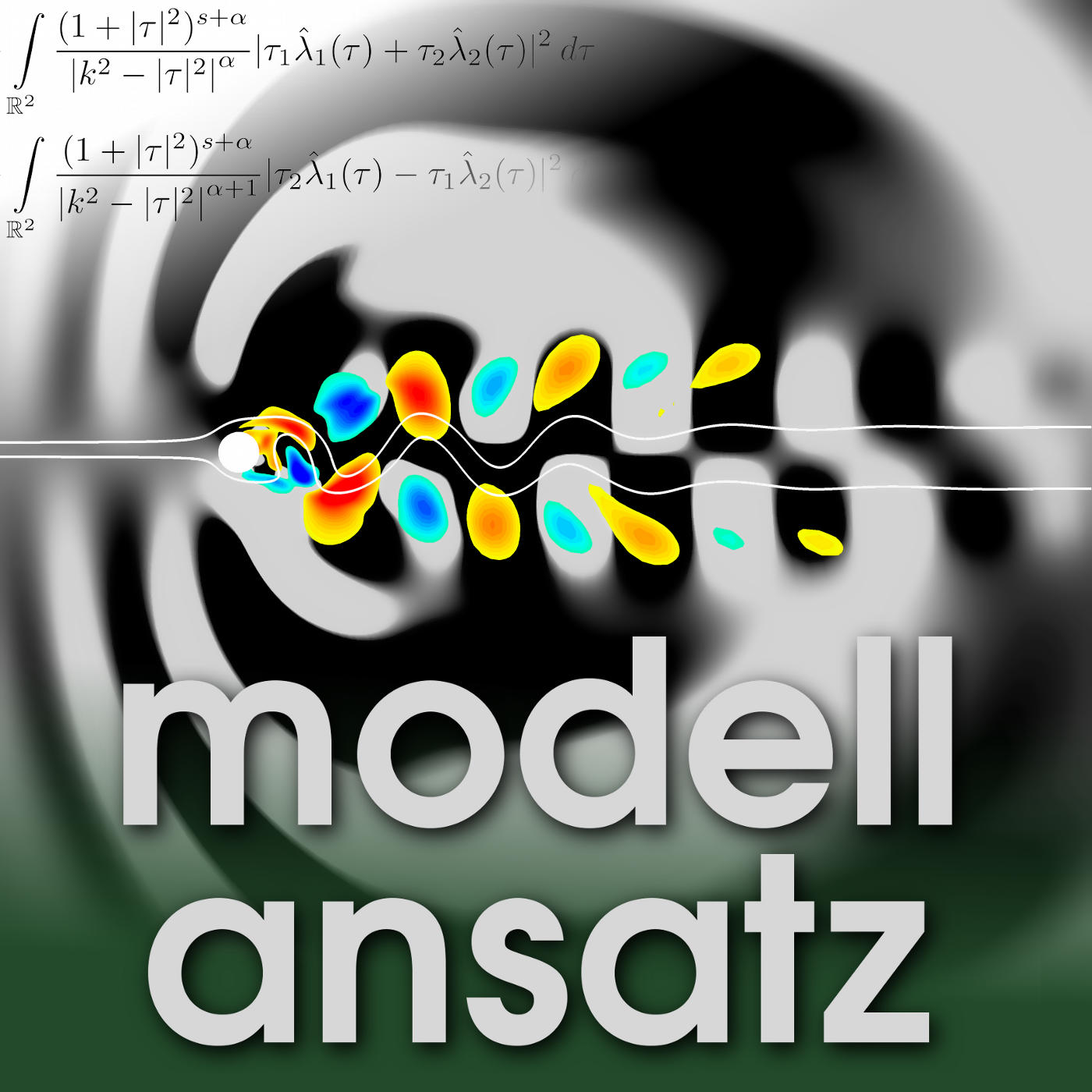

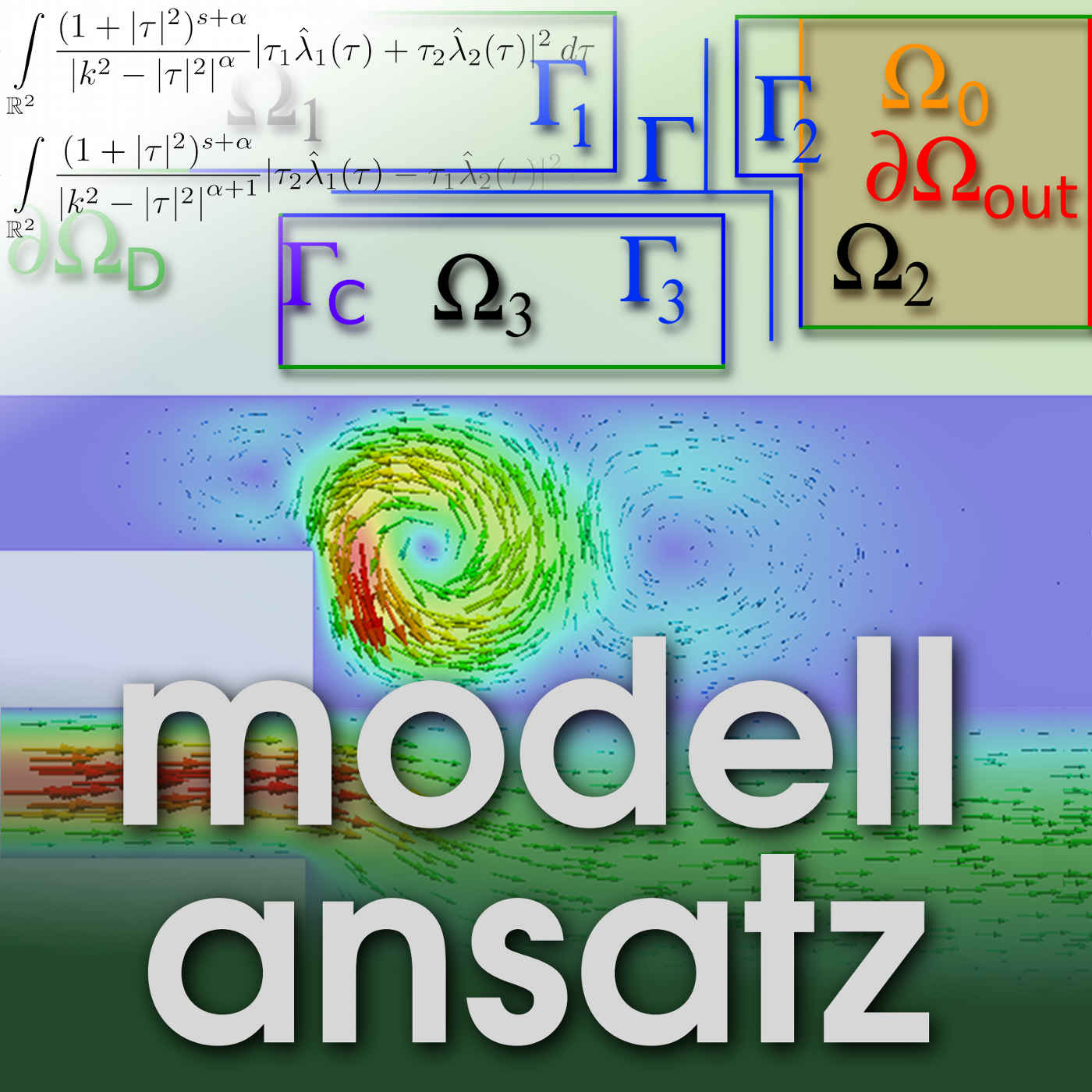

Strömungslärm

Die Gründer Carlos Falquez, Iris Pantle und Balazs Pritz aus dem Karlsruher Institut für Technologie (KIT), befassen sich mit Verfahren für Strömungslärmprognose und bieten diese Ingenieurbüros und Unternehmen zur Nutzung auf ihrer Cloud-Simulationsplattform NUBERISIM an. Während für viele Strömungen die inkompressiblen Navier-Stokes-Gleichungen ausreichen, kommen hier kompressible Gleichungen zum Einsatz. Dies ändert das Gleichungssystem von einem dominant elliptischen zu einem dominant hyperbolischen System, dem die numerischen Verfahren Rechnung tragen müssen. Der Definition des Simulationsgebiets und den an dessen Rändern festzulegenden Randbedingungen kommt hier eine besondere Bedeutung zu: Beides muss aufeinander abgestimmt sein, jede ins Simulationsgebiet einlaufende Störung besitzt selbst wieder die Größenordnung akustischer Wellen und kann daher vom eigentlichen Simulationsergebnis, dem durch die Strömung erzeugten Schall, schlecht getrennt werden. Daneben ergeben sich weitere Herausforderungen, wie den Einsatz von Verfahren höherer Ordnung, um die Wellendispersion zu bewahren, deren Erhaltung in einer typischen Strömungssimulation normalerweise weder forciert wird noch das Ergebnis signifikant verbessern würde. Schließlich sind solche Verfahren hoch-instationär, so dass sich für realistische Fragestellungen äußerst lange Rechenzeiten ergeben. Dadurch wurden sie in der Vergangenheit nur in der akademischen Forschung untersucht und angewendet. Der Schritt zur kommerziellen Nutzung schien lange undenkbar. Durch moderne Parallelisierungstechniken und Cloud-Systeme jedoch steht plötzlich auch kleineren Unternehmen wie z.B. Ingenieursdienstleitern ausreichend Rechenkapazität zur Verfügung – theoretisch, denn der Zugang hierzu ist immer noch Eingeweihten vorbehalten. Darum haben die Gründer die Idee entwickelt, solche Verfahren nicht nur als Software, sondern als Plattform einschließlich Nutzeroberfläche anzubieten, gerade so wie bei einer konventionellen Software – nur eben über einen Browser anzusteuern. Die Plattform wird voraussichtlich im März zugänglich gemacht. Literatur und Zusatzinformationen Falquez, Pantle und Pritz GbR: Nubersim.de Iris Pantle: Strömungsakustik auf der Basis akustischer Analogie mit LES und URANS, Der Andere Verlag, ISBN 978-3936231823, 2002. Christoph Richter, Łukasz Panek, Norbert Schönwald, Mei Zhuang: Numerische Methoden in der Strömungsakustik – CAA, Vorlesungsskript, TU Berlin, 2005.

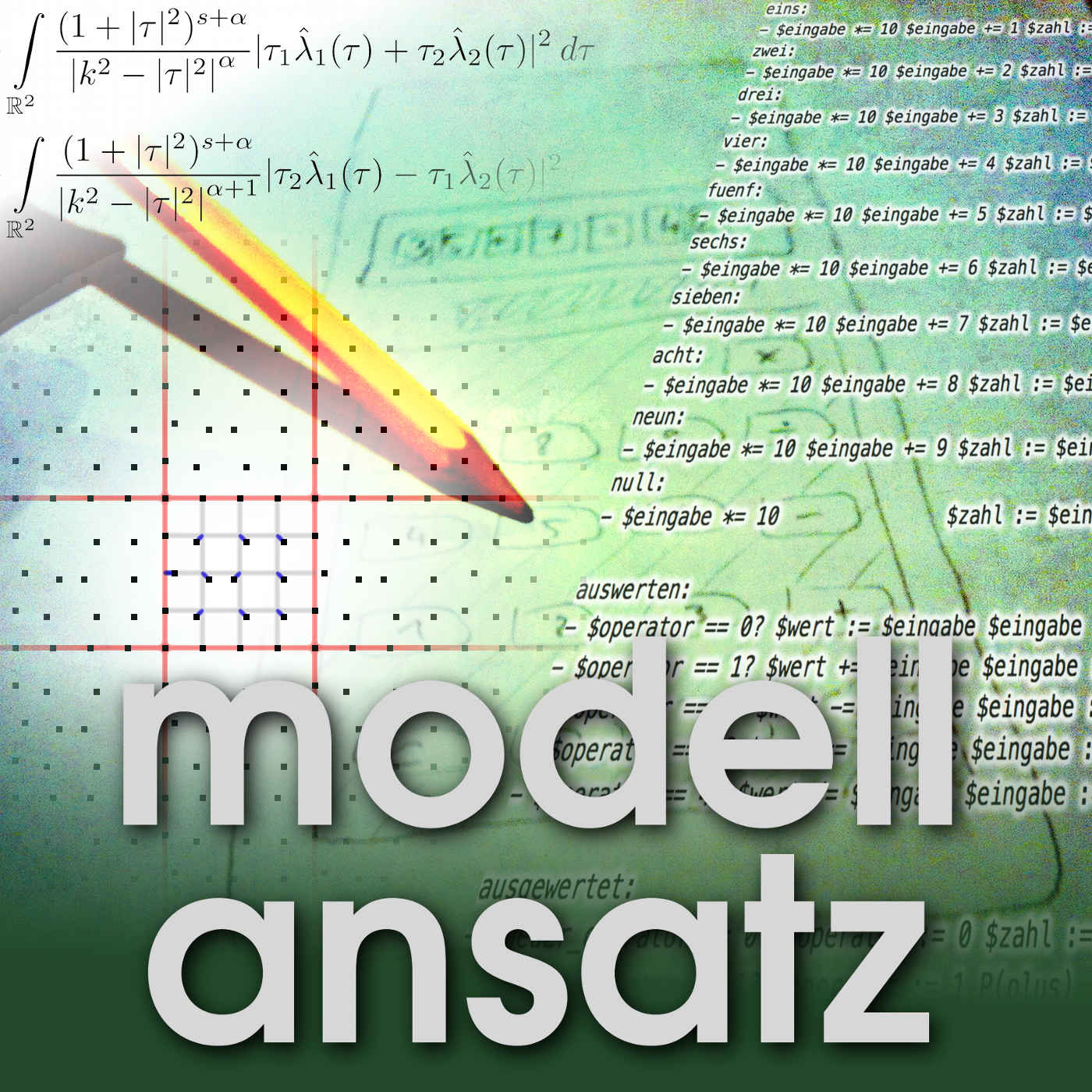

Papierrechner

Joachim Breitner veranstaltete im FabLab Karlsruhe einen Workshop auf dem er unter anderem seinen Taschenrechner auf Papier vorstellte. Den Rechner hat er mit einem speziellen Digitalstift realisiert, dessen genaue Funktionsweise analysiert wurde. Im Workshop ging es speziell um den Tiptoi-Stift, der auf dem Papier ein fast unsichtbares Punktemuster analysiert. Dieses Punktemuster macht das Papier zu digitalem Papier. Hier werden immer im Code 16 Punkte zu einem Block zusammengefasst, von denen die Punkte am linken und oberen Rand zur Erkennung, und die restlichen neun Punkte die eigentliche Information als Zahl mit Prüfbits beinhalten. Dabei entsprechen vier Punkte etwa einem Millimeter und daher sind die Muster, die sich auf den aktiven Bereichen wiederholen, mit dem Auge kaum zu erkennen. Die Funktionen des Stifts werden als GME-Dateien wie auf einen USB-Stick kopiert, und diese konnten in einem längeren Prozess zum Großteil analysiert werden. Zunächst wurden die im freien Ogg Vorbis-Format kodierten Tondateien gefunden, die über eine einfache Substitutions-Chiffre verschleiert wurden. Im Folge der weiteren Analyse wurden die Programme zu den Papiermustern gefunden, und aus diesen konnte die Maschinensprache der Stifte im Großteil bestimmt werden. Das System reagiert auf gescannte Codes, und kann dann verschiedene Aktionen wie das Abspielen von Audio, Variablen setzen, Rechnungen durchführen und Variablen abfragen. Ein Rätsel verblieb, warum die berechneten Werte aus den Papiercodes nicht mit den Kennungen in den Programmen übereinstimmten. Dies konnte man durch Wechsel des Stifts in einen Debug-Modus durch Drücken der Minus-Taste beim Anschalten und anschließend der Plus-Taste nachvollziehen, denn dann liest der Stift die in der Maschinensprache verwendeten Codes auf Chinesisch vor. Zum Verständnis braucht man da nur eine Tabelle der chinesischen Zahlen von 1 bis 10. Aber auch diese Zuordnung konnte inzwischen analysiert und gelöst werden. Damit können nun komplett eigene Seiten mit Papier-Code und zugehörigen GME-Programmen von jedem selbst erstellt werden, dazu wurde das tttool entwickelt, mit dem sowohl die Programme in einer speziellen Sprache, wie auch die zugehörigen Punktemuster erzeugt werden können. Das Erstellen druckbarer Seiten erfordert dann nur noch ein geeignetes Grafikprogramm und passende Hintergrundbilder, wie Joachim Breitner im Gespräch mit Sebastian Ritterbusch darlegt. Literatur und Zusatzinformationen J.Breitner: tttool, Das Schweizer Taschenmesser für den Tiptoi-Bastler Mailingliste für das tttool FabLab Karlsruhe e.V. Entropia e.V. Karlsruhe

Extremereignisse

Sebastian Lerch befasst sich mit der Vorhersage von Extremereignissen, zum Beispiel bei Stürmen und extrem starken Regenfällen und deren Auswirkung auf Fluten oder auch bei Ausnahmeereignissen in der Finanzindustrie. Das Dilemma ist dabei, dass die öffentliche Bewertung oft nur nach eventuell nicht vorhergesagten Katastrophen erfolgt, wie bei dem Erdbeben von L’Aquila, das sogar zur in erster Instanz Verurteilung von Wissenschaftlern führte. Tatsächlich gibt es Fälle erfolgreicher Erdbebenvorhersage, doch leider sind dies nur seltene Ereignisse. Die grundsätzliche Schwierigkeit liegt darin, ein angemessenes Modell für die Risikobewertung zu finden, auch wenn manche Ereignisse nur selten oder in bestimmter Umgebung sogar noch nie aufgetreten sind, und so kaum Daten vorliegen. Die Lösung liegt darin auf probabilistische Vorhersagen zu setzen. Hier wird kein deterministischer fester Wert vorhergesagt, sondern die stochastische Verteilung, in der man die Wahrscheinlichkeit für alle Ereignisse definiert. Verschiedene probabilistische Vorhersagen können mit Hilfe des Continuous Rank Probability Score (CRPS) zu Beobachtungen verglichen und evaluiert werden. Die CRPS ist dabei ein Vertreter der Proper Scoring Rules, da die wahre Verteilung diesen Score tatsächlich maximiert. Eine Herausforderung verbleibt die Frage nach einer geeigneten Vermittlung von probabilistischen Aussagen, wie sie uns in der Regenwahrscheinlichkeit täglich in der Wettervorhersage begegnet, und leider selten richtig verstanden wird. Literatur und Zusatzinformationen S. Lerch: Verification of probabilistic forecasts for rare and extreme events, Diplomarbeit, 2012. S. Lerch, T. L. Thorarinsdottir: Comparison of nonhomogeneous regression models for probabilistic wind speed forecasting, arXiv preprint arXiv:1305.2026, 2013. T. Gneiting, A. E. Raftery: Strictly proper scoring rules, prediction, and estimation, Journal of the American Statistical Association 102.477: 359-378, 2007. T. L. Thorarinsdottir, T. Gneiting, S. Lerch, N. Gissibl, N. Paths and pitfalls in prediction verification, Vortrag Norges Bank, 2013.

Kaufverhalten

Bei der stochastischen Analyse von Kaufverhalten konzentriert man sich besonders auf die Aspekte des Kaufzeitpunkts, der Produktwahl und der Kaufmenge, um im Wettbewerb einen Vorteil gegenüber der Konkurrenz zu erhalten. Kristina Cindric führt im Gespräch mit Gudrun Thäter aus, wie sie auf Basis großer Datenmengen von anonymisierten Vertragsabschlüssen über ein Jahr Analysen erstellt, Modelle entworfen, trainiert und die entstehenden Prognosen getestet hat. Die auftretenden stochastischen Modelle können sehr vielseitig sein: So kann der Kaufzeitpunkt beispielsweise durch einen stochastischen Prozess mit exponentieller Verteilung modelliert werden, für die Produktwahl kann ein Markow-Prozess die wahrscheinlichsten nächsten Käufe abbilden. Ein zentrales Konzept für die Analyse und das Training von Modellen ist dann die Parameterschätzung, die die tatsächliche Ausgestaltung der Modelle aus den Daten bestimmt. Literatur und Zusatzinformationen L. Fahrmeir, G. Raßer, T. Kneib: Stochastische Prozesse, Institut für Statistik, Ludwig-Maximilians-Universität München, 2010. O. C. Ibe: Markov Processes for Stochastic Modeling, Academic Press, Amsterdam, 2009. L. Yan, R. H. Wolniewicz, R. Dodier: Predicting Customer Behavior in Telecommunications, IEEE Computer Society 19, 50-58, 2004. J. Xia, P. Zeephongsekul, D. Packer: Spatial and temporal modelling of tourist movements using Semi-Markov processes, Tourism Management 32, 844-851, 2010. C. Ebling, Dynamische Aspekte im Kaufverhalten: Die Determinanten von Kaufzeitpunkt, Marken- und Mengenwahl, Inaugural-Dissertation, Johann Wolfgang Goethe-Universität Frankfurt am Main, 2007. Forschungszentrum Informatik (FZI)

Geometrische Analysis

Geometrie und Analysis sind auf den ersten Blick zwei sehr unterschiedliche Disziplinen in der Mathematik. Wie sie jedoch wunderbar zusammenpassen, erläutert Prof. Dr. Tobias Lamm im Gespräch mit Gudrun Thäter. Ein klassisches Beispiel für die geometrische Analysis ist das Problem der Dido: Wie kann man bei festgelegtem Umfang ein möglichst großes Gebiet abstecken? Es geht also darum den Flächeninhalt unter einer Nebenbedingung zu maximieren, und das ist ein typisches Variationsproblem, das stark von der gegebenen Geometrie abhängt. Ein anderes Beispiel sind Minimalflächen, wie man sie beim Olympiastadion in München und Seifenblasen sehen kann. Überraschenderweise sind Minimalflächen nicht immer eindeutig. Ein Weg dies zu analysieren geht über die Beschreibung des Problems durch Partielle Differentialgleichungen. Oft kann man über das Maximumsprinzip die Eindeutigkeit beweisen: Bei linearen elliptischen partiellen Differentialgleichungen sagt das Prinzip aus, dass das Maximum entweder auf dem Rand angenommen wird oder konstant ist. Betrachtet man nun die Differenz zweier angenommen unterschiedlicher Lösungen zu gleichen Randwerten, so folgt, dass die Differenz wegen der Linearität auch eine Lösung ist, und wegen des Maximumprinzips konstant 0 ist. Damit waren als Resultat dieses Widerspruchbeweises die zwei Lösungen identisch. Bei allgemeineren, u.a. nicht-linearen, Problemstellungen muss dieses Prinzip nicht unbedingt gelten, und so kann es zu mehreren Lösungen zur gleichen Aufgabenstellung kommen. Aktuelle Forschungsbereiche in der geometrischen Analysis sind der mittlere Krümmungsfluss und die geometrische Evolutionsgleichung im Allgemeinen. Ebenso geht es um die Frage, mit welcher minimalen Regularität für die Anfangsdaten, noch eine Lösung rekonstruiert werden kann. Ein weiteres Forschungsgebiet sind die recht jungen Willmore-Flächen. Das Willmore-Funktional ist sehr eng verwandt zur Plattengleichung, d.h. der Approximation des Durchbiegens von Platten. Es hat aber auch Anwendungen in der Zellbiologie in der Modellierung der Form der Zellen. Letztlich kommt es auch in der allgemeinen Relativitätstheorie zum Einsatz. Sehr aktuell ist der Beweis der Poincaré-Vermutung, die 2002 von Perelman bewiesen werden konnte. Literatur und Zusatzinformationen T. Lamm: Geometric Variational Problems, Vorlesung gehalten an der FU Berlin, 2007. H. Koch, T. Lamm: Geometric flows with rough initial data, Asian Journal of Mathematics 16.2: 209-235, 2012. T. Lamm, J. Metzger, F. Schulze: Foliations of asymptotically flat manifolds by surfaces of Willmore type, Mathematische Annalen 350.1: 1-78, 2011.

Fußgänger

Auch Menschenströme können mathematisch beschrieben und mit geeigneten Modellen auch simuliert werden. Damit können große Veranstaltungen im Vorfeld besser geplant und ausgelegt werden, damit Engpässe oder sogar Katastrophen wie bei der Love-Parade 2010 möglichst verhindert werden. Henrieke Benner hat dazu die Parameter für die Simulation von Fußgängern im Gegenstrom kalibriert und spricht mit Gudrun Thäter über die Verfahren, Herausforderungen und Erkenntnisse.Mathematisch betrachtet sie die Fußgänger in einem mikroskopischen Modell, wo jede Person als eigenes Objekt simuliert wird. Entsprechend der Situation wirken nun virtuelle Kräfte auf diese Objekte, so verhindert eine virtuelle Abstoßungskraft zwischen zwei Personen, dass diese zusammenstoßen. Die betrachtete Simulation wird durch eine Vielzahl von Parametern konfiguriert, die mit realen Experimenten kalibriert werden müssen. Dies kann durch eine Optimierung der Parameter gelöst werden, die die Simulation den Experimenten möglichst weitgehend annähert. Literatur und Zusatzinformationen H.-J. Bungartz, S. Zimmer, M. Buchholz, D. Pflüger: Modellbildung und Simulation: Eine anwendungsorientierte Einführung, Springer Verlag, 2013. U. Chattaraj, A. Seyfried, P. Chakroborty: Comparison of pedestrian fundamental diagram across cultures, Advances in complex systems, 12(03), 393-405, 2009. A. Johansson, D. Helbing, P. K. Shukla: Specification of the social force pedestrian model by evolutionary adjustment to video tracking data, Advances in complex systems, 10(supp02), 271-288, 2007. D. Helbing, P. Mukerji: Crowd disasters as systemic failures: analysis of the Love Parade disaster, EPJ Data Science 1:7, 2012. PTV Viswalk Software

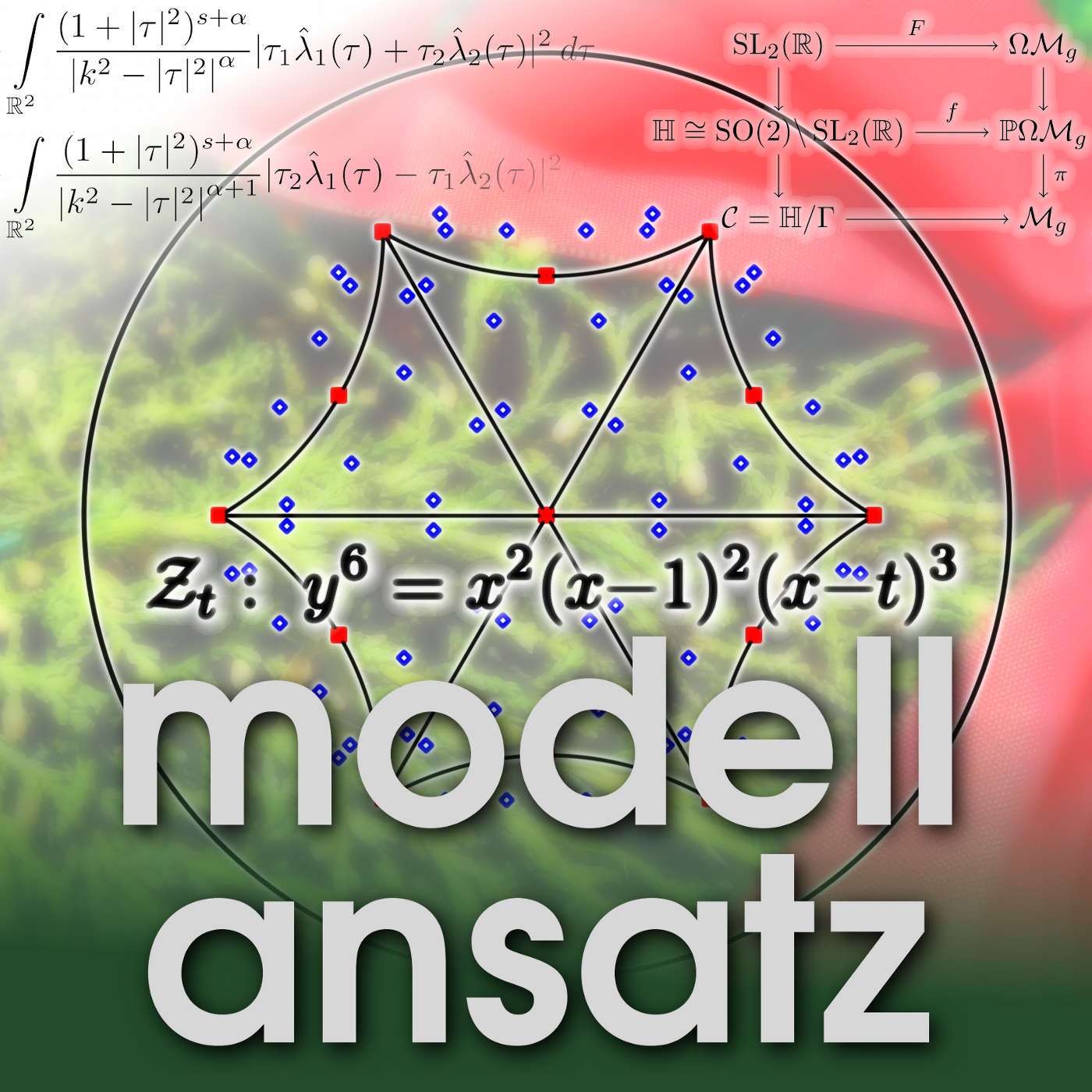

Teichmüllerkurven

Jonathan Zachhuber war zum 12. Weihnachtsworkshop zur Geometrie und Zahlentheorie zurück an seine Alma Mater nach Karlsruhe gekommen und sprach mit Gudrun Thäter über Teichmüllerkurven. Kurven sind zunächst sehr elementare ein-dimensionale mathematische Gebilde, die über den komplexen Zahlen gleich viel reichhaltiger erscheinen, da sie im Sinne der Funktionentheorie als Riemannsche Fläche verstanden werden können und manchmal faszinierende topologische Eigenschaften besitzen. Ein wichtiges Konzept ist dabei das Verkleben von Flächen. Aus einem Rechteck kann man durch Verkleben der gegenüberliegenden Seiten zu einem Torus gelangen (Animation von Kieff zum Verkleben, veröffentlicht als Public Domain): Polynome in mehreren Variablen bieten eine interessante Art Kurven als Nullstellenmengen zu beschreiben: Die Nullstellen-Menge des Polynoms ergibt über den reellen Zahlen den Einheitskreis. Durch Ändern von Koeffizienten kann man die Kurve verformen, und so ist die Nullstellenmenge von eine Ellipse. Über den komplexen Zahlen können diese einfachen Kurven dann aber auch als Mannigfaltigkeiten interpretiert werden, die über Karten und Atlanten beschrieben werden können. Das ist so wie bei einer Straßenkarte, mit der wir uns lokal gut orientieren können. Im Umland oder anderen Städten braucht man weitere Karten, und alle Karten zusammen ergeben bei vollständiger Abdeckung den Straßenatlas. Auch wenn die entstehenden abstrakten Beschreibungen nicht immer anschaulich sind, so erleichtern die komplexen Zahlen den Umgang mit Polynomen in einem ganz wichtigen Punkt: Der Fundamentalsatz der Algebra besagt, dass der Grad des Polynoms gleich der Anzahl der Nullstellen in ihrer Vielfachheit ist. Also hat nun jedes nichtkonstante Polynom mindestens eine Nullstelle, und über den Grad des Polynoms wissen wir, wie viele Punkte sich in der Nullstellenmenge bewegen können, wenn wir an den Koeffizienten Veränderungen vornehmen. Eine gute Methode die entstehenden Flächen zu charakterisieren ist die Bestimmung möglicher geschlossener Kurven, und so gibt es beim Torus beispielsweise zwei unterschiedliche geschlossene Kurven. Die so enstehende Fundamentalgruppe bleibt unter einfachen Deformationen der Flächen erhalten, und ist daher eine Invariante, die hilft die Fläche topologisch zu beschreiben. Eine weitere wichtige topologische Invariante ist das Geschlecht der Fläche. Die Teichmüllerkurven entstehen nun z.B. durch das Verändern von einem Koeffizienten in den Polynomen, die uns durch Nullstellenmengen Kurven beschreiben- sie sind sozusagen Kurven von Kurven. Die entstehenden Strukturen kann man als Modulraum beschreiben, und so diesen Konstruktionen einen Parameterraum mit geometrischer Struktur zuordnen. Speziell entstehen Punkte auf Teichmüllerkurven gerade beim Verkleben von gegenüberliegenden parallelen Kanten eines Polygons; durch Scherung erhält man eine Familie von Kurven, die in seltenen Fällen selbst eine Kurve ist. Ein Beispiel ist das Rechteck, das durch Verkleben zu einem Torus wird, aber durch Scherung um ganz spezielle Faktoren zu einem ganz anderen Ergebnis führen kann. Die durch Verklebung entstandenen Flächen kann man als Translationsflächen in den Griff bekommen. Hier liefert die Translationssymmetrie die Methode um äquivalente Punkte zu identifizieren. Für die weitere Analyse werden dann auch Differentialformen eingesetzt. Translationen sind aber nur ein Beispiel für mögliche Symmetrien, denn auch Rotationen können Symmetrien erzeugen. Da die Multiplikation in den komplexen Zahlen auch als Drehstreckung verstanden werden kann, sind hier Rotationen als komplexe Isomorphismen ganz natürlich, und das findet man auch in den Einheitswurzeln wieder. Literatur und Zusatzinformationen A. Zorich: Flat Surfaces, Frontiers in Number Theory, Physics and Geometry, On Random Matrices, Zeta Functions, and Dynamical Systems, Ed. by P. Cartier, B. Julia, P. Moussa, and P. Vanhove. Vol. 1. Berlin: pp. 439–586, Springer-Verlag, 2006. M. Möller: Teichmüller Curves, Mainly from the Viewpoint of Algebraic Geometry, IAS/Park City Mathematics Series, 2011. J. Zachhuber: Avoidance of by Teichmüller Curves in a Stratum of , Diplomarbeit an der Fakultät für Mathematik am Karlsruher Institut für Technologie (KIT), 2013. C. McMullen: Billiards and Teichmüller curves on Hilbert modular surfaces, Journal of the AMS 16.4, pp. 857–885, 2003. C. McMullen: Prym varieties and Teichmüller curves, Duke Math. J. 133.3, pp. 569–590, 2006. C. McMullen: Dynamics of SL(2,R) over moduli space in genus two, Ann. of Math. (2) 165, no. 2, 397–456, 2007. Weitere Paper von C. McMullen, u.a. The mathematical work of Maryam Mirzakhani Podcast: Modellansatz 040: Topologie mit Prof. Dr. Wolfgang Lück

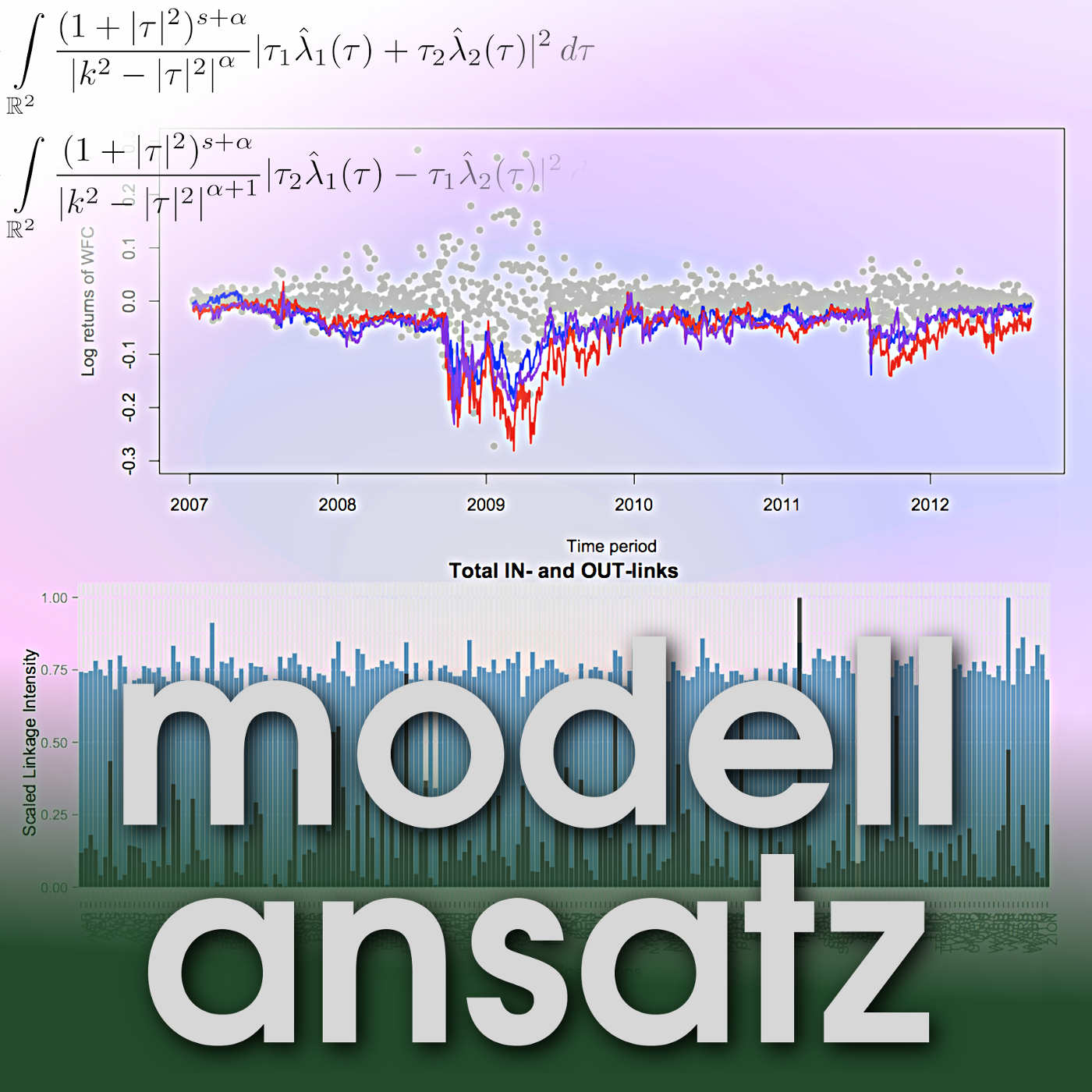

Risikobewertung

Prof. Dr. Wolfgang Härdle war im Rahmen des Workshop zu High Dimensional, High Frequency and Spatial Data in Karlsruhe und sprach mit Gudrun Thäter über sein Forschungsgebiet. Er befasst sich an der Humboldt-Universität zu Berlin mit der Bewertung von Risiken und ist am Lehrstuhl der Nachfolger von Ladislaw Bodjevich, der unter anderem für seine Arbeiten zum Gesetz der kleinen Zahlen berühmt geworden ist: Es sagt aus, dass auch wenn alle 37 Roulette-Zahlen gleich wahrscheinlich sind, nach 37 Würfen im Durchschnitt nur etwa 2/3 der Zahlen aufgetreten sind. Damit steht es nur scheinbar in gewissem Kontrast zum Gesetz der großen Zahlen, das bestimmt, wie die Auftrittshäufigkeit sich für viele Würfe der Gleichverteilung annähert. Das Flanken-Maß ist eine Eigenschaft von Profit and Loss (PnL, GuV)-Funktionen oder Zufallsvariablen, die die Dicke von Flanken oder Entferntheit von seltenen Ereignissen modelliert. Schon Ladislaw Bodjevich hat erkannt, dass das die Bewertung von Extremrisiken und wenige vorhandene Daten einen Widerspruch darstellt. Die Normalverteilung ist die Grenzverteilung gewichteter Zufallsgrößen, wenn der Grenzwert existiert, also bei vielen Ereignissen das Gesetz der großen Zahlen zum Einsatz kommen kann. Bei wenigen Ereignissen gelangt man zur Poisson-Verteilung. Obwohl sie theoretisch viele Prozesse gut beschreiben sollte, funktioniert die Normalverteilung in der Realität aus vielen Gründen oft schlechter als erwartet: Sich verändernde Prozesse können Mischverhältnisse von an sich normal-verteilten Bestandteilen verändern, ebenso kann sich die Volatilität bzw. die Streuung um den Erwartungswert über die Zeit verändern. Es kann aber auch eine vollkommene andere Verteilung vorliegen wie zum Beispiel die Extremwertverteilung, Weibull-Verteilung mit algebraisch abfallenden Tails oder der Pareto-Verteilung. Leider ist die stochastische Konvergenz von Extermwertverteilungen sehr schlecht, und erschwert so Vorhersagen und Bewertungen. So wurden strukturierte Finanzprodukte mit multivariaten Modellen und einer Normalverteilungsannahme viel zu vereinfacht modelliert. So waren CDO-Produkte daher vor der Finanzkrise ab 2007 viel zu billig und hatten einen beträchtlichen Anteil an der Krise. Die Risikobewertung ist aber nicht nur für die Bewertung von Katastrophen-Bonds für Versicherungen gegen Erdbeben wichtig, sondern auch für die Analyse von EEG von Kindern. Sie hilft aber auch den Risikofaktor Mensch im Sinne der Behaviour Finance zu verstehen. Literatur und Zusatzinformationen J. Franke, W. Härdle, C. Hafner: Statistics of Financial Markets, Springer-Verlag Berlin Heidelberg, 2004. J. Hull: Risk Management and Financial Institutions, John Wiley & Sons, 2012. J. Leider: A Quantile Regression Study of Climate Change in Chicago, 1960-2010, SIAM Undergraduate Research Online (SIURO) Vol. 5, 2012. Publikationen, Vorträge und Papers von Wolfgang Härdle

Topologie

Prof. Dr. Wolfgang Lück befasst sich am HIM (Hausdorff Research Institute for Mathematics) und dem Mathematisches Institut der Universität Bonn mit der Topologie von Mannigfaltigkeiten und Flächen wie auf einem Torus oder einer Kugel. Speziell für Kugeln und Kreise gibt es die Sphären-Notation , die die Oberflächen des Objekts im beschreiben. Damit ist eine Kreislinie und die Kugeloberfläche.Auch wenn Flächen lokal ähnliche Eigenschaften haben, kann die Situation global ganz anders aussehen: So unterscheidet sich die Vorstellung einer flachen Erde lokal nicht von der Kugelform der Erde, global sieht es aber ganz anders aus. Ebenso kennen wir auch jetzt noch nicht sicher die Topologie des Weltalls. Dazu beschränkt sich unser Vorstellungsraum oft auf drei Dimensionen, obwohl schon die relativistische Physik uns lehrt, unsere Umgebung als Raumzeit in 4 Dimensionen zu verstehen.Bei der Klassifikationen von Flächen auf unterschiedlichen Körpern verwendet man Homöomorphismen um ähnliche Flächen einander zuzuordnen, und letztlich unterscheiden sich die Flächenklassen dann nur noch durch die Anzahl der Löcher bzw. dem Geschlecht, was dann auch die Eigenschaften der Flächen bestimmt. Ein Weg das Geschlecht der Fläche zu bestimmen ist die Triangularisierung, eine andere Möglichkeit bietet die Analyse des Spektrums eines Operators wie dem Laplace-Operators, das auch in der Topologie von Graphen zum Einsatz kommen kann.Ein Beispiel für die Anwendung des Laplace-Operators ist die Wärmeleitungsgleichung, die zwar die lokalen Eigenschaften des Wärmetransports beschreibt, jedoch das Wärmegleichgewicht nach unendlicher Zeit die globalen Zusammenhänge beinhaltet. Ein wichtiger Begriff ist hier der Integralkern, der hilft Lösungen durch Integraloperatoren darzustellen.Ein wichtiger mathematischer Begriff ist dabei der -Funktionenraum, der über die Fourier-Transformation auf bestimmten Gebieten mit dem -Folgenraum identifiziert werden kann, und man dadurch auf Lösungen von partiellen Differentialgleichungen schließen kann.Besonderes Interesse liegt in der Topologie auf Invarianten, wie der Fundamentalgruppe, mit der man auch den Fundamentalsatz der Algebra beweisen kann. Ein weiteres Beispiel für eine Invariante ist die Windungszahl, die gerade in der Funktionentheorie zum Residuensatz und effizienten Integralberechnungsmethoden führt.Dabei entstehen oft nicht kommutative Verknüpfungen, wie man es zum Beispiel von der Matrizenmultiplikation oder den Symmetriegruppen kennen kann.Ein elementarer Einstieg in die Topologie ist auch über die Knotentheorie möglich, wo ebenso Knoten-Invarianten gefunden werden können, und über zum Beispiel Jones-Polynome klassifiziert werden können.Im weiteren Gespräch geht es um Themen wie die unterschiedlichen Bilder der Mathematik in Gesellschaft, Schule und Universität, die Bedeutung der Mathematik für Gesellschaft, die Ausbildung für Industrie und das Lehramt, und über den Stand und Möglichkeiten der Gleichberechtigung und Förderung von Frauen in der Wissenschaft.Literatur und Zusatzinformationen W. Lück: Was und wie zählt man im Alltag und in der modernen Mathematik? Vortrag im Kolloquium zur Didaktik der Mathematik, Karlsruhe, Dezember 2014. W. Lück: Algebraische Topologie, Homologie und Mannnigfaltigkeiten, Vieweg Spektrum, 2005. W. Lück: Transformation Groups and Algebraic K-Theory, Lecture Notes in Mathematics, 1989. Publikationen von Wolgang Lück Wolfgang Lück in der Wikipedia

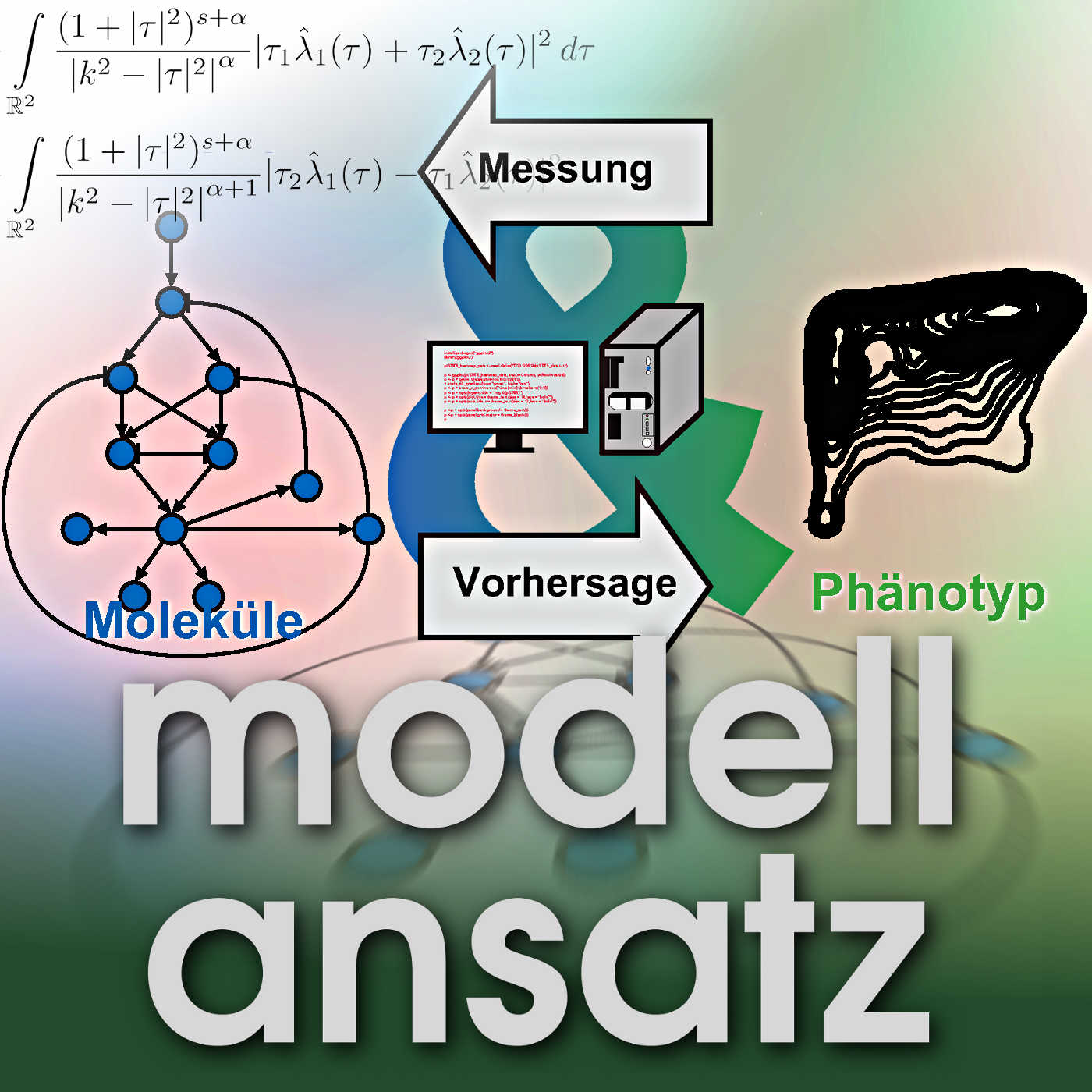

Systembiologie

Auf den Vorschlag von Henning Krause verbreiteten viele Forschende unter dem Hashtag #1TweetForschung ihr Forschungsthema in Kurzform. So auch Lorenz Adlung, der in der Abteilung Systembiologie der Signaltransduktion am Deutschen Krebsforschungszentrum in Heidelberg die mathematische Modellbildung für biologische Prozesse erforscht. Bei der Anwendung einer Chemotherapie leiden Krebspatienten oft unter Blutarmut. Hier kann neben der Bluttransfusion das Hormon Erythropoetin, kurz EPO, helfen, da es die körpereigene Erzeugung von roten Blutkörperchen (Erythrozyten) unterstützt. Leider ist EPO als Dopingmittel bekannt, und um dem Doping noch deutlicher Einhalt zu gebieten, wurde im November 2014 in Deutschland ein Entwurf eines Anti-Doping-Gesetz vorgelegt. Trotz gängigem Einsatz und erprobter Wirkung von EPO ist die genaue Wirkung von EPO auf Krebszellen nicht bekannt. Daher verfolgt Lorenz Adlung den Ansatz der Systembiologie, um im Zusammenwirken von Modellbildung und Mathematik, Biologie und Simulationen sowohl qualitativ und quantitativ analysieren und bewerten zu können. Vereinfacht sind rote Blutkörperchen kleine Sauerstoff-transportierende Säckchen aus Hämoglobin, die auch die rote Farbe des Bluts verursachen. Sie stammen ursprünglich aus Stammzellen, aus denen sich im Differenzierungs-Prozess Vorläuferzellen bzw. Progenitorzellen bilden, die wiederum durch weitere Spezialisierung zu roten Blutkörperchen werden. Da es nur wenige Stammzellen gibt, aus denen eine unglaubliche große Anzahl von Trillionen von Blutkörperchen werden müssen, gibt es verschiedene Teilungs- bzw. Proliferationsprozesse. Das Ganze ergibt einen sehr komplexen Prozess, dessen Verständnis zu neuen Methoden zur Vermehrung von roten Blutkörperchen führen können. Den durch Differenzierung und Proliferation gekennzeichnete Prozess kann man mathematisch beschreiben. Eine zentrale Ansichtsweise in der Systembiologie der Signaltransduktion ist, Zellen als informationsverarbeitende Objekte zu verstehen, die zum Beispiel auf die Information einer höheren EPO-Konzentration in der Umgebung reagieren. Von diesem Ansatz werden durch Messungen Modelle und Parameter bestimmt, die das Verhalten angemessen beschreiben können. Diese Modelle werden in Einklang mit bekannten Prozessen auf molekularer Ebene gebracht, um mehr über die Abläufe zu lernen. Die erforderlichen quantitativen Messungen basieren sowohl auf manuellem Abzählen unter dem Mikroskop, als auch der Durchflusszytometrie, bei der durch Streuung von Laserlicht an Zellen durch Verwendung von Markern sogar Aussagen über die Zelloberflächen getroffen werden können. Zusätzlich kann mit der Massenspektrometrie auch das Innere von Zellen ausgemessen werden. In diesem Anwendungsfall werden die mathematischen Modelle in der Regel durch gekoppelte gewöhnliche Differenzialgleichungen beschrieben, die Zell- oder Proteinkonzentrationen über die Zeit beschreiben. Die Differenzialgleichungen und deren Parameter werden dabei sowohl mit Messungen kalibriert, als auch mit den Kenntnissen in der Molekularbiologie in Einklang gebracht. Die Anzahl der Parameter ist aber oft zu hoch, um naiv auf geeignete zu den Messungen passende Werte zu gelangen. Daher wird unter anderem das Latin Hypercube Sampling verwendet, um schnell nahe sinnvollen Parameterwerten zu gelangen, die durch gradienten-basierte Optimierungsverfahren verbessert werden können. Die Basis für diese Art von Optimierungsverfahren ist das Newton-Verfahren, mit dem man Nullstellen von Funktionen finden kann. Ein wichtiger Aspekt im Umgang mit Messergebnissen ist die Berücksichtigung von Messfehlern, die auch vom Wert der Messung abhängig verstanden werden muss- denn nahe der Messgenauigkeit oder der Sättigung können die relativen Fehler extrem groß werden. Die Bestimmung der Modellparameter ist schließlich auch ein Parameteridentifikationsproblem, wo insbesondere durch eine Sensitivitätsanalyse auch der Einfluss der geschätzten Parameter bestimmt werden kann. Sowohl die Parameter als auch die Sensitivitäten werden mit den biologischen Prozessen analysiert, ob die Ergebnisse stimmig sind, oder vielleicht auf neue Zusammenhänge gedeuten werden können. Hier ist die Hauptkomponentenanalyse ein wichtiges Werkzeug, um zentrale beeinflussende Faktoren erfassen zu können. Ein wichtiges Ziel der Modellbildung ist die numerische Simulation von Vorgängen, die als digitale Experimente sich zu einem eigenen Bereich der experimentellen Forschung entwickelt haben. Darüber hinaus ermöglicht das digitale Modell auch die optimale Planung von Experimenten, um bestimmte Fragestellungen möglichst gut untersuchen zu können. Die Umsetzung auf dem Computer erfolgt unter anderem mit Matlab, R (The R Project for Statistical Computing) und mit der spezialisierten und freien Software D2D - Data to Dynamics.Literatur und Zusatzinformationen M. Boehm, L. Adlung, M. Schilling, S. Roth, U. Klingmüller, W. Lehmann: Identification of Isoform-Specific Dynamics in Phosphorylation-Dep

Graphpartitionierung

Ein Graph ist eine Menge von Knoten und Kanten zwischen diesen Knoten. Man unterscheidet zwischen gerichteten Graphen, wo Einbahnstraßen darstellbar sind, oder den ungerichteten Graphen, wo Beziehungen zwischen zwei Knoten immer beidseitig sind. Beispiele sind die graphische Darstellung von Beziehungen in einem sozialen Netz oder Straßennetze, für deren Verarbeitung das Forschungsgebiet von Christian Schulz immer bedeutender wird, wie wir in seinem Gespräch mit Gudrun Thäter erfahren.Eine wichtige Aufgabe im Umgang mit Graphen ist die Aufteilung (oder fachsprachlich Partitionierung), von Graphen in kleinere Teile. Dies kommt z.B. der Parallelisierung der Arbeit auf den Graphen zugute, und ist unumgänglich, wenn Graphen eine Größe haben, die nicht mehr von einem Prozessor bearbeitet werden kann. Ein wichtiges Merkmal ist hier, die Aufteilung möglichst gleichmäßig vorzunehmen, damit die Aufteilung von z.B. Rechenzeit gleichmäßig erfolgt, und gleichzeitig wenig Kommunikation zwischen der Bearbeitung der Einzelteile erforderlich ist. Es geht um eine möglichst gute Skalierbarkeit der Graphverarbeitung.Ein wichtiges Anwendungsproblem ist die Routenplanung, bei der zwischen zwei Punkten auf der Erde die zeitlich kürzeste Verbindung berechnet werden soll. In der Informatik ist der Dijkstra-Algorithmus der passende Basis-Algorithmus für diese Aufgabe, doch er ist für große Graphen in seiner ursprünglichen Form sehr ineffizient. In Kombination mit einer passenden Graphpartitionierung und Algorithmen kann man das Verfahren deutlich effizienter ausführen und beschleunigen.Ein klassisches Verfahren zur Aufteilung ist das Mehrschichtverfahren über die Laplace-Matrix, wo ausgenutzt wird, dass zwischen den Eigenwerten der Matrix und der Schnittstruktur des Graphen enge Zusammenhänge bestehen. Dieses Verfahren wurde zum Mehrschichtverfahren für Graphen weiterentwickelt, bei dem in einer sogenannten Kontraktion benachbarte Knoten und parallele Kanten jeweils zusammengeführt werden, und der Graph zu einem kleinen und kantengewichteten Graph vereinfacht wird. Schließlich wird das Problem auf einem vereinfachten, groben Gitter gelöst, und dann jeweils mit lokalen Suchen auf feinere Graphen erweitert. Für die Kontraktion werden Heuristiken und Kantenbewertungsfunktionen verwendet.Ein weiterer Ansatz sind auch evolutionäre Algorithmen. Dabei wurde eine allgemeinere Umgebung geschaffen, die auf eine weite Klasse von Optimierungsproblemen angewendet werden kann.Die Graphentheorie ist natürlich auch Teil der diskreten Mathematik, und besonders berühmt ist auch das Traveling Salesperson Problem. Gleichzeitig ist das Thema aber auch in der Theoretischen Informatik, im Algorithm Engineering und in der Software-Entwicklung beheimatet.Literatur und Zusatzinformationen C. Schulz: High Quality Graph Partitioning, PhD thesis. Karlsruhe Institute of Technology, 2013. P. Sanders, C. Schulz: Distributed Evolutionary Graph Partitioning, Proceedings of the 12th Workshop on Algorithm Engineering and Experimentation (ALENEX'12), pages 16--19, 2012. P. Sanders, C. Schulz: High Quality Graph Partitioning, Proceedings of the 10th DIMACS Implementation Challenge Workshop: Graph Partitioning and Graph Clustering, pages 1--17, AMS, 2013. P. Sanders, C. Schulz: Think Locally, Act Globally: Highly Balanced Graph Partitioning, proceedings of the 12th International Symposium on Experimental Algorithms (SEA'13), volume 7933 of LNCS, pages 164--175, 2013. R. Glantz, H. Meyerhenke, C. Schulz: Tree-based Coarsening and Partitioning of Complex Networks, Technical Report, Karlsruhe Institute of Technology, 2014. KaHIP Homepage KaHIP auf Twitter Christian Schulz auf Twitter Podcast: Death of a traveling salesman

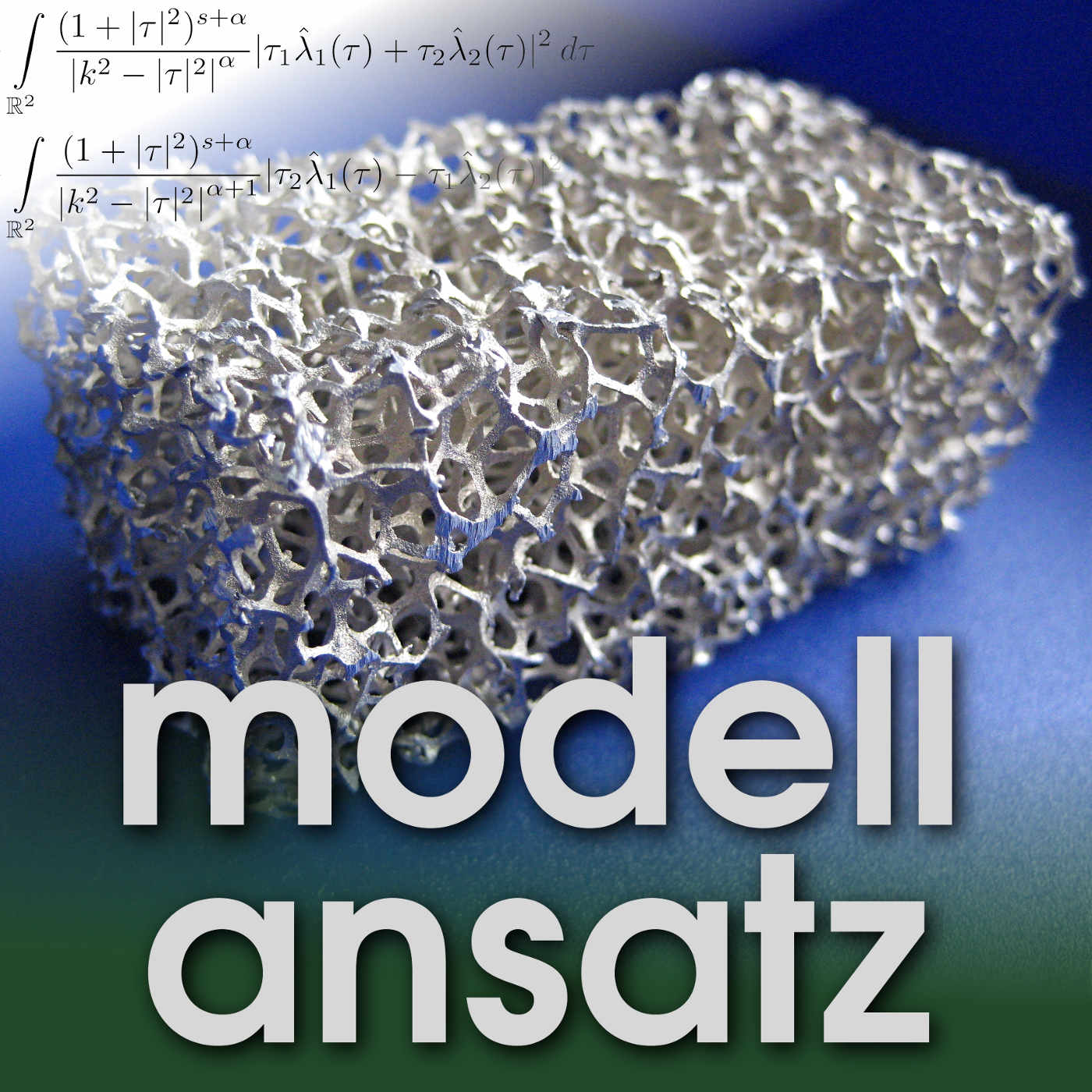

Metallschaum

In den Materialwissenschaften ist man immer auf der Suche nach neuen Werkstoffen und Materialien. Sehr vielversprechend sind dabei Metallschäume, dessen Wärmeleitungseigenschaften Anastasia August am Institut für angewandte Materialien erforscht und über die sie uns im Gespräch mit Sebastian Ritterbusch erzählt.Zu den besonderen Eigenschaften von Metallschäumen gehören unter anderem die große Oberfläche bzw. Grenzfläche im Verhältnis zum Volumen wie bei Lungenbläschen und die hohe Wärmeleitungsfähigkeit im Verhältnis zum Gewicht. Gleichzeitig können Metallschäume mit Luft oder anderen Materialien wie Paraffin gefüllt werden, um besondere Eigenschaften zu erhalten. Neben Bierschaum ist auch der Badeschaum eine Möglichkeit Schäume mit ihrem außergewöhnlichem Verhalten kennenzulernen. Das geschäumte Materialgemisch erhält dabei aber typischerweise nicht durchschnittliche Materialeigenschaften, sondern es können Eigenschaften der einzelnen Materialien teilweise kombiniert werden; z.B. erhält ein Metall-Paraffinschaum eine recht hohe Wärmeleitfähigkeit vom Metall gepaart mit einer hohen Wärmekapazität und vor Allem mit einem günstigen Schmelzpunkt (45-80°C) vom Paraffin und ist damit ein sehr effizienter Latentwärmespeicher.In der Natur finden sich Schaumstrukturen zum Beispiel in Knochen, die bei hoher Stabilität ein deutlich geringeres Gewicht als ein massives Material haben. Aber auch für Knochenimplantate sind Metallschäume aus Titan durch die hohe Stabilität bei geringem Gewicht und guter Verträglichkeit sehr interessant.Problematisch ist für den Einsatz von Metallschäumen, dass noch viele quantitative Messgrößen fehlen, die Herstellung noch recht teuer ist, und insbesondere nur in kleinen Größen produziert werden kann. Als Unterscheidungsmerkmal hat sich neben der Unterscheidung in offen oder geschlossen porigen Schaum die ppi-Zahl als Maß für die Porendichte etabliert, dabei zählt man die Poren pro Inch (Zoll, entspricht 2,54 cm). Dazu erfasst man auch die mittlere Porengröße (Durchmesser), ihre Standardabweichung, die Porosität, die mittlere Stegdicke und deren Form. Weiterhin können sich Größen in verschiedenen Richtungen im Material unterscheiden, und dadurch merklich deren Eigenschaften verändern.Für die Herstellung von Metallschäumen gibt es unterschiedliche Verfahren: Zwei typische Vertreter sind das Pressen mit dem anschließenden Schmelzen von gemischtem Metall- und Metallhybridpulvern für geschlossen porige feste Schäume oder Gießverfahren, wo der Metallschaum für offen porige Materialien durch keramische Negativabbildungen von Polyurethan-Schäumen nachempfunden wird.Schon früh waren Schäume als möglichst dichte Packungen ein Forschungsfeld in der Mathematik. Im Jahr 1994 haben Weaire-Phelan eine noch optimalere regelmäßige Schaumstruktur veröffentlicht, die in der Architektur des zu den olympischen Sommerspielen 2008 in Peking errichteten Nationalen Schwimmzentrums verewigt wurde. Das ebenfalls zu den Sommerspielen errichtete Vogelnest hat im Gegenteil eine zufälligere Struktur. Lange hatte man keine verlässlichen Aussagen über die Wärmeleitfähigkeit von Metallschäumen. Bei einer Leitfähigkeit von etwa 200 W/(mK) von Aluminium erreicht ein Metallschaum Leitfähigkeiten zwischen 5-13 W/(mK) während man bei Luft von einer Leitfähigkeit von etwa 0.025 W/(mK) ausgehen kann. Außerdem haben Metallschäume einen hohen Oberflächenanteil, dies bezeichnet die vorhandene Oberfläche im Verhältnis zum Volumen. Während ein voller Metallwürfel ein Verhältnis von etwa hat, kann ein Schaum ein Verhältnis von bis zu erreichen.Eine interessante Fragestellung ist auch, ab welcher Porengröße die natürliche Konvektion in mit Luft gefüllten Metallschäumen eine Rolle gegenüber der Wärmeleitung spielt. Die relevante Größe ist hier die Rayleigh-Zahl, die für Metallschäume typischer Porengrößen ergibt, dass die natürliche Konvektion zu vernachlässigen ist.Für die Simulation wird der komplette Raum des Metallschaums diskretisiert, und es gibt eine Funktion, die als Indikatorfunktion anzeigt, ob an diesem Punkt Metall oder Luft vorliegt. Hier können sowohl aus an der Hochschule Pforzheim durchgeführten Schnitten rekonstruierte Schaumstrukturen abgebildet werden, aber auch künstlich mit Algorithmen erzeugte Schäume für die Simulation abgebildet werden. Bei der künstlichen Erzeugung von Schäumen ist die Voronoi-Zerlegung ein wichtiger Algorithmus zur Bestimmung der Poren.Den eigentlichen Wärmetransport im Metallschaum wird durch die Wärmeleitungsgleichung modelliert. Sie leitet sich aus dem Energieerhaltungssatz und dem Fourierschen Satz ab. Dieses Modell stimmt aber in dieser Form nur für homogene Materialien mit konstantem Koeffizienten . Daher müssen die Sprünge in Materialeigenschaften (etwas im Übergang Luft-Metall) zusätzlich berücksichtigt werden. Dies kann über die Phasenfeldmethode realisiert werden, wo eine künstliche, diffuse Übergangsschicht zwischen den Materialien eingeführt wird. Dies ist im Prinzip eine Art von M

Analysis und die Abschnittskontrolle

Im Herbst beginnen die neuen Studiengänge der Mathematik am KIT und neben den Vorlesungen zur Linearen Algebra, Stochastik oder Numerik gehört die Analysis zu den mathematischen Vorlesungen, mit dem das Studium der Mathematik in den ersten Semestern beginnt. Dazu spricht Sebastian Ritterbusch mit Johannes Eilinghoff, der im letzten Jahr den Übungsbetrieb der Analysis-Vorlesungen mit großem Anklang organisiert hat.Die Analysis befasst sich besonders mit der Mathematik um Funktionen auf reellen Zahlen, welche Eigenschaften sie haben, und wie man diese differenzieren oder integrieren kann. Vieles zur Geschichte der Analysis findet man besonders in den Büchern von Prof. Dr. Michael von Renteln, der unter anderem über die Geschichte der Analysis im 18. Jahrhundert von Euler bis Laplace, die Geschichte der Analysis im 19. Jahrhundert von Cauchy bis Cantor, über Aspekte zur Geschichte der Analysis im 20. Jahrhundert von Hilbert bis J. v. Neumann und über die Die Mathematiker an der Technischen Hochschule Karlsruhe 1825-1945 geschrieben hat.Grundlage für die Mathematik in der Analysis sind die Zahlenmengen, wie die abzählbaren natürlichen Zahlen , ganzen Zahlen , rationale Zahlen und schließlich die überabzählbaren reellen Zahlen . Während die natürlichen Zahlen direkt mit dem Beweisprinzip der vollständigen Induktion in Verbindung stehen und für sich schon ein Thema der Zahlentheorie sind, benötigt man für die Analysis mindestens die reellen Zahlen. Diese kann man über konvergente Folgen bzw. Cauchy-Folgen rationaler Zahlen einführen. Für den Beweis der Äquivalenz dieser beiden Konvergenzbegriffe kann man die Dreiecksungleichung sehr gut gebrauchen. Ein Beispiel für eine Folge rationaler Zahlen, die gegen eine irrationale Zahl konvergieren ist , die gegen die Eulersche Zahl konvergiert, d.h. . Aus jeder Folge kann man eine Reihe bilden, indem man die Folgenglieder aufsummiert. Wichtige Reihen sind die geometrische Reihe mit Summenwert , wenn , und die divergente Harmonische Reihe, mit der man sogar Brücken bauen kann.Über den Begriff der Folge kann man auch offene Mengen und abgeschlossene Mengen definieren, so wie dies auch mit Epsilon-Umgebungen definiert werden kann. Diese Eigenschaften werden im Bereich der mathematischen Topologie noch viel umfassender eingeführt, aber schon diese Darstellungen helfen, den wichtigen Begriff der Funktion in der Analysis und deren Eigenschaften einzuführen. Zur Definition einer Funktion gehört neben der eigentlichen Abbildungsvorschrift die Angabe der Definitionsmenge und der Wertebereich. Ohne diese Informationen ist es nicht möglich Surjektivität und Injektivität nachzuweisen.Eine wichtige Eigenschaft von Funktionen ist der Begriff der Stetigkeit, die man für den Zwischenwertsatz benötigt. Damit kann man zum Beispiel wackelnde Tische reparieren oder mit Anastasia im Science Slam Orte gleicher Temperaturen auf der Erde suchen. Der Zwischenwertsatz gilt zunächst nur für reelle Funktionen, es gibt den Zwischenwertsatz aber auch in allgemeinerer Form.Eine weitere wichtige Eigenschaft von Funktionen ist die Differenzierbarkeit und das Berechnen von Ableitungen mit ihren Ableitungsregeln. Sehr wichtig ist dabei die Exponentialfunktion, die mit ihrer eigenen Ableitung übereinstimmt. Diese Funktion findet man im Alltag in jeder Kettenlinie in der Form des Cosinus Hyperbolicus wieder. Eine wichtige Anwendung für differenzierbare Funktionen ist der Mittelwertsatz, ohne den die Abschnittskontrolle auf Autobahnen zur Geschwindigkeitsüberprüfung nicht denkbar wäre. Aber auch in höheren Dimensionen kann man Differentialrechnung betreiben, und man führt dazu den Gradienten, Richtungsableitungen und z.B. die Divergenz eines Vektorfelds ein.Als Umkehrung der Differentiation erhält man die Integralrechnung. Jedoch ist das Bilden einer Stammfunktion nur bis auf eine Konstante eindeutig. Daher kann man zum Beispiel mit Beschleunigungssensoren im Handy nicht wirklich eine Positions- und Geschwindigkeitsmessung durchführen, sondern muss für die Trägheitsnavigation viele weitere Sensoren mit einbeziehen. Eine andere Einführung des Integrals ist das Lebesgue-Integral oder das Riemannsche Integral, wo man bei letzterem in einem Intervall die Fläche unter einer Kurve durch Treppenfunktionen annähert. Den Zusammenhang dieser beiden Begriff liefert der Fundamentalsatz der Analysis. Leider kann man nicht zu allen Funktionen analytische Stammfunktionen bestimmen. Hier kann dann die numerische Integration zum Einsatz kommen. Die Integration ist aber keine rein abstrakte Idee, sondern wir finden mathematische Zusammenhänge wie den Gaußsche Integralsatz direkt in der Natur wieder.Für den Start im Studium erhält man in Karlsruhe viel Unterstützung: Es gibt Vorkurse und die von der Fachschaft für Mathematik und Informatik organisierte Orientierungsphase, oder kurz O-Phase, in der man die zukünftigen Mitstudierenden kennenlernen kann. Mit diesen sollte man sich gemeinsam den Stoff von Vorlesungen, Übungen und T

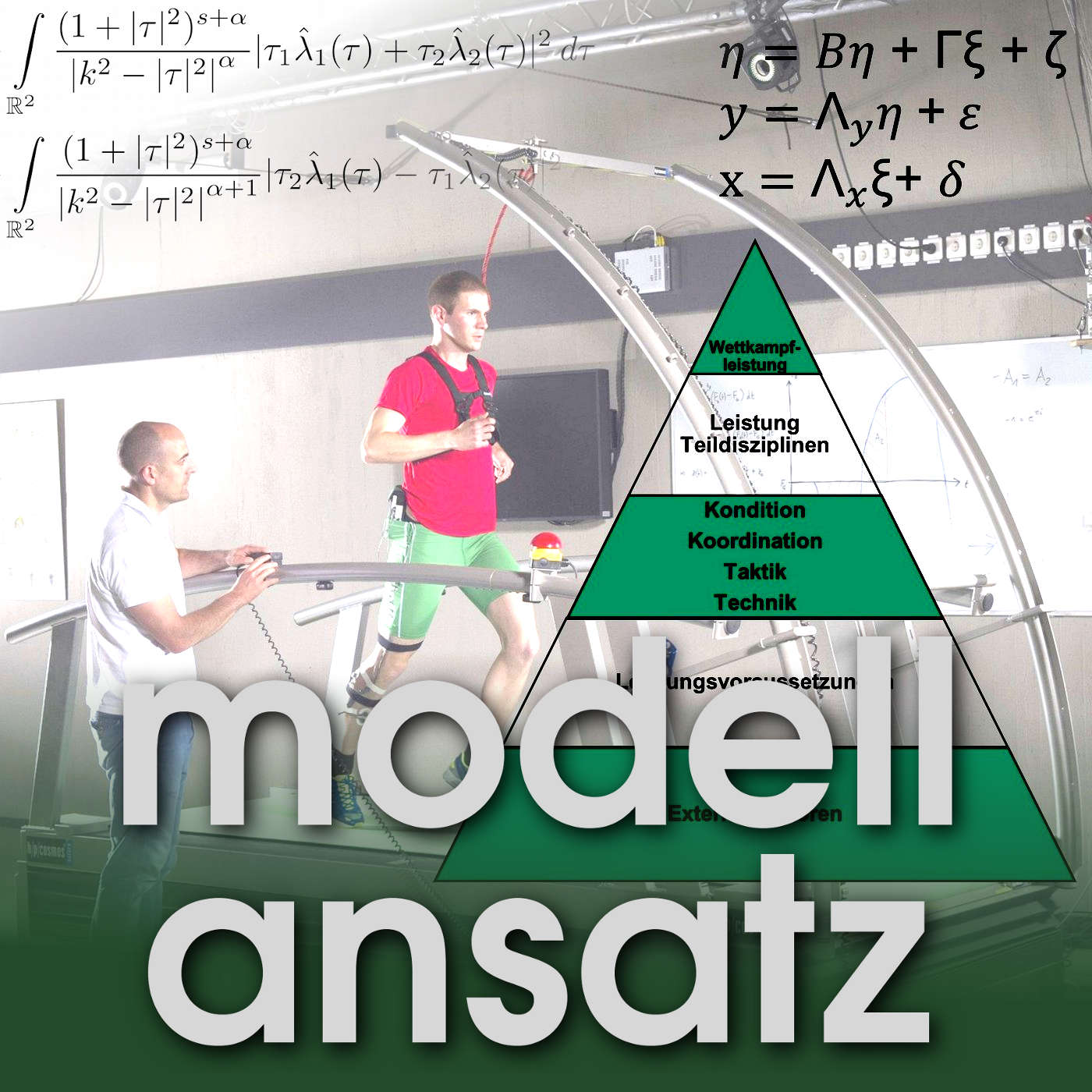

Leistungsstrukturanalyse im Triathlon

Die wissenschaftliche Fundierung des sportlichen Trainings kann sowohl im Amateur- als auch im Profibereich zur Verbesserung der individuellen Leistung beitragen. Marian Hoffmann ist Mitarbeiter des BioMotion Centers und beschäftigt sich mit dem Einsatz multivariater Verfahren zur Identifikationen leistungsrelevanter Einflussgrößen durch Strukturgleichungsmodelle in der Sportart Triathlon. Hierzu zählen beispielsweise Kraft- und Ausdauerfähigkeiten sowie technische und taktische Merkmale. Im Gespräch mit Gudrun Thäter erläutert er den Einsatz mathematischer Methoden zur Bearbeitung dieser interdisziplinären Aufgabenstellung mit dem Ziel, spezifische Trainingsempfehlungen auf Basis einer Leistungsstrukturanalyse in dieser Ausdauersportart generieren zu können. Literatur und Zusatzinformationen K. Backhaus, B. Erichson, R. Weiber: Fortgeschrittene multivariate Analysemethoden. Eine anwendungsorientierte Einführung, (2., überarb. und erw. Aufl), Berlin: Springer Gabler, 2013. R. Bagozzi, Y. Yi: Specification, evaluation, and interpretation of structural equation models, Journal of Academic Marketing Science, 40, 8–34, 2012. A. Fuchs: Methodische Aspekte linearer Strukturgleichungsmodelle: Ein Vergleich von kovarianz- und varianzbasierten Kausalanalyseverfahren, Würzburg : Betriebswirtschaftliches Inst., Lehrstuhl für BWL und Marketing, 2011. H. Letzelter, M. Letzelter: Die Struktur sportlicher Leistungen als Gegenstand der Leistungsdiagnostik in der Trainingswissenschaft, Leistungssport, 12 (5), 351–361, 1982. G. P. Millet, V. E. Vleck, D. J. Bentley: Physiological requirements in triathlon, Journal of Human Sport & Exercise, 6 (2), 184–204, 2011.

Höhere Mathematik

Auch im Studium der Ingenieurswissenschaften steckt viel Mathematik: Diese spielt besonders am Anfang des Studiums der Fächer Maschinenbau, Verfahrenstechnik und Chemieingenieurwesen am KIT eine große Rolle, und Frank Hettlich begleitet mit seinem Team die Studienanfänger in der sogenannten Höheren Mathematik in den ersten drei Semestern. Dabei geht es ihm in den Vorlesungen nicht um die Vermittlung von Patentrezepten, sondern um den kreativen Umgang mit mathematischen Methoden, die für das weitere Studium eine große Rolle spielen werden.Um den Übergang von der Schulmathematik zur universitären Mathematik zu erleichtern, gibt es einen sehr gut besuchten zwei-wöchigen Vorkurs parallel zur Orientierungsphase vor dem eigentlichen Vorlesungsbeginn. Im Gespräch mit Gudrun Thäter erzählt er, dass es besonders wichtig ist, einfach den Stift wieder in die Hand zu nehmen und sich selbst an der Mathematik zu versuchen, um den Einstieg erfolgreich zu vollbringen. Dafür gibt es viele Übungen, anwendungsnahe Beispiele und Materialen, wie das Buch zur Mathematik, in das Frank Hettlich seine langjährigen Erfahrungen aus der Lehre einbringen konnte.Ganz wichtig ist es auch, die Begeisterung für das wissenschaftliche Vorgehen zu vermitteln, und die Studierenden zur Zusammenarbeit anzuregen. Letztlich gibt es aber auch Klausuren zur Mathematik, die zumindest in Karlsruhe eher weniger den Grund für einen Studienabbruch liefern. Keinesfalls sollten sie aber die leichte Schulter genommen werden, und auch dazu hat Frank Hettlich einige wichtige Tipps: Zeitplanung, Zusammenarbeit und Vorsicht im Umgang mit Lösungen.Literatur und Zusatzinformationen T. Arens, F. Hettlich, C. Karpfinger, U. Kockelkorn, K. Lichtenegger, Stachel: Mathematik, Spektrum, Akad. Verlag, 2008. F. Hettlich: Vorkurs Mathematik, Shaker-Verlag, Aachen, 2009. Vorlesung: Mathematischer Vorkurs Vorlesungen: Höhere Mathematik I für die Fachrichtung Maschinenbau, Geodäsie und Materialwissenschaften und Werkzeugstofftechnik, Höhere Mathematik I für die Fachrichtungen Chemieingenieurwesen, Verfahrenstechnik, Bioingenieurwesen und MIT Vorlesung: Höhere Mathematik III für die Fachrichtungen Maschinenbau, Chemieingenieurwesen, Verfahrenstechnik, Bioingenieurwesen und das Lehramt Maschinenbau Podcast zum Maschinenbau: Maschinenraum Podcast

Logistik und Big Data

Im Bereich der Logistik geht es um die fortlaufende Optimierung des Geschäftsprozesses und dies kann man inzwischen auf Basis einer großen Menge von teilweise komplex strukturierten Echtzeitdaten, kurz gesagt Big Data, umsetzen. Liubov Osovtsova hat dazu ein Modell der Transportlogistik auf Basis von Petri-Netzen in CPN Tools in der Form eines Coloured Petri Net aufgestellt. Im Gespräch mit Gudrun Thaeter erklärt sie, wie sie damit unter Nutzung des Gesetz von Little und Warteschlagentheorie stochastische Aussagen über Engpässe und Optimierungspotentiale bestimmen konnte. Literatur und Zusatzinformationen C. Pettey, L. Goasduff: Gartner Says Solving "Big Data" Challenge Involves More Than Just Managing Volumes of Data, Gartner Press Release, 2011. C. Hagar: Crisis informatics: Perspectives of trust - is social media a mixed blessing? SLIS Student Research Journal, Nr. 2 (2), 2012. W. van der Aalst: The Application of Petri Nets to Workflow Management, The Journal of Circuits, Systems and Computers, Nr. 8 (1), 21–66, 1988. CPN-Tools Documentation

Digitale Währungen

Um im digitalen Umfeld elektronischen Handel zu betreiben, benötigt man einen gesicherten Datenaustausch für Angebote, Verhandlungen und Verträge, aber letztlich auch eine Form von elektronischem Geld auf dem der Handel basiert. Ganz zentral ist dabei die moderne Kryptographie und insbesondere die Public Key-Verfahren, die durch mathematische Verfahren das ganze ermöglichen, soweit die Verfahren sicher, korrekt implementiert und richtig benutzt werden, und es nicht zu einem Fiasko wie dem Heartbleed-Bug kommt. Im Gespräch mit Gudrun Thäter erläutert Sebastian Ritterbusch die Mathematik hinter digitalem Geld und der Kryptowährung Bitcoin. Dazu geht es zunächst in die Zahlentheorie der Restklassenkörper und spezielle Restklassenringe . Mit dem kleinen Satz von Fermat versehen wir eine Einwegfunktion mit einer Falltür und kommen auf Hash-Funktionen und das RSA-Verfahren. Damit kann man auch digital Unterschreiben (sogar bei Bedarf blind signieren), wir diskutieren, wie Verträge durch einen Kollisionsangriff und dem Geburtstagsparadoxon gefälscht werden können, und wie damit erfolgreich ein Root-Zertifikat fingiert wurde. Für das zentral organisierte und anonyme digitale Geld benötigt man dann nur noch das Prinzip des geteilten Geheimnis. Leider kommt das Verfahren gegenüber weniger anonymen Verfahren heute kaum zum Einsatz, im Gegensatz zum Bitcoin-Verfahren, das sich wachsender Beliebtheit erfreut. Hier ersetzt ein Peer-to-Peer-Netzwerk und eine Hash-Kette die zentrale Instanz, und verhindert so das doppelte Ausgeben durch die gemeinsame Vergangenheit von Transaktionen, die über einen Merkle-Baum in die Block-Chain platzsparend integriert werden. Literatur und Zusatzinformationen D.Chaum, A.Fiat, M.Naor: Untraceable electronic cash, Proceedings on Advances in Cryptology, S. Goldwasser, Ed. Springer-Verlag New York, New York, NY, 319-327, 1990. S.Nakamoto: Bitcoin, A Peer-to-Peer Electronic Cash System, Whitepaper, The Cryptography Mailing List, 2008. A.Sotirov, M.Stevens, J.Appelbaum, A.Lenstra, D.Molnar, D.A.Osvik, B.Weger: MD5 considered harmful today, Creating a rogue CA certificate, Crypto 2009 Proceedings, 2009. Z.Durumeric, E.Wustrow, J.A.Halderman: ZMap - der IPv4-Scan J.A.Haldermann: Fast Internet-wide Scanning and its Security Applications, Vortrag 30C3, 2013. Heise.de, bbe: Virenscanner warnt vor Bitcoin-Blockchain, 17.5.2014. Heise.de, axk: Bitcoin: Erstmals gefährliche Konzentration der Mining-Leistung, 16.6.2014. Podcast: T.Pritlove und A.Bogk: CRE182, Elektronisches Geld Podcast: M.Richter und A.Bogk: Die Wahrheit 005, Bitcoins Podcast: F.Blue, X.Initrc, M.Malik: Death of a traveling salesman Podcast: D.Jäckel und A.Schildbach: Bitstaub, Ein Bitcoin Podcast Podcast: Bitcoin Austria: Bitcoin Update Podcast: M.Völter, G.Andresen: Omega Tau 59, Bitcoin

Matrixfunktionen

Eine Funktion, die eine Matrix auf eine Matrix abbilden kann, ist eine Matrixfunktion. Diese Funktionen finden besonders bei der numerischen Behandlung von Evolutionsgleichungen wie zum Beispiel der Wärmeleitungsgleichung ihre Anwendung. Dazu bändigt Tanja Göckler die komplizierten partiellen Differentialgleichungen, die aus der mathematischen Modellbildung entstehen, durch Diskretisierung und weiteren Methoden zu gewöhnlichen Differentialgleichungen. Diese können durch Potenzreihen gelöst werden, die auch als Matrixfunktionen eingesetzt werden können. So kann man beispielsweise auch die Exponentialfunktion als Potenzreihe auf eine Matrix anwenden, um lineare Differentialgleichungen zu lösen. Im Gespräch mit Gudrun Thäter erklärt sie, wie man diese Aufgaben aber mit rationalen Krylov-Verfahren noch viel effizienter lösen kann. Literatur und Zusatzinformationen T. Göckler, V. Grimm: Convergence Analysis of an Extended Krylov Subspace Method for the Approximation of Operator Functions in Exponential Integrators, SIAM J. Numer. Anal., 51(4), 2189-2213, 2013. S. Güttel: Rational Krylov approximation of matrix functions: Numerical methods and optimal pole selection, GAMM‐Mitteilungen 36.1: 8-31, 2013. N. J. Higham: Functions of Matrices: Theory and Computation, Society for Industrial and Applied Mathematics, Philadelphia, 2008. S. Ritterbusch: Warum funktioniert das CG-Verfahren? Eine Einführung in das wohl bekannteste Krylovraum-Verfahren.

Motorisches Lernen

Kinder erlernen das Laufen und Schreiben im Spiel, doch für Erwachsene ist es nach z.B. einem Schlaganfall eine ganz andere Herausforderung. Daher untersucht Christian Stockinger im BioMotion Center das motorische Lernen, damit wir besser verstehen können, wie sich der Körper sensormotorische Programme abruft. Mit einem Robotic Manipulandum, dem BioMotionBot, lässt er dazu die Probanden einfache Armbewegungen durchführen, die unbemerkt durch ein Kraftfeld gestört werden. Dadurch erlernen sie unbemerkt neue Bewegungsabläufe, und im Gespräch mit Gudrun Thäter erklärt er, wie man diesen Lernvorgang mathematisch mit einem Zwei-Prozessmodell beschreiben kann. Daraus kann man sowohl viel über die Vorgänge lernen, Therapien verbessern, als auch die Entwicklung von modernen Prothesen und humanuider Roboter voranbringen. Literatur und Zusatzinformationen D. W. Franklin, D. M. Wolpert: Computational mechanisms of sensorimotor control, Neuron 72.3: 425-442, 2011. R. Shadmehr, M.A. Smith, J.W. Krakauer: Error Correction, Sensory Prediction, and Adaptation in Motor Control, Annual Reviews Neuroscience, 33:89-108, 2010. R. Shadmehr, S.P. Wise: The Computational Neurobiology of Reaching and Pointing: A Foundation for Motor Learning, Cambridge: MIT Press, 2005. V. Bartenbach, C. Sander, M. Pöschl, K. Wilging, T. Nelius, F. Doll, W. Burger, C. Stockinger, A. Focke, T. Stein: The BioMotionBot: A robotic device for applications in human motor learning and rehabilitation, Journal of Neuroscience Methods, 213(2):282-297, 2013.

Unfallvorhersage

Aus einem Verkehrsmodell kann man den Straßenverkehr simulieren und damit mögliche Staustellen und auch die Gefahr für Verkehrsunfälle vorhersagen. Dafür wird das Straßennetz in ein Netzwerk aus Knoten und Kanten zerlegt, und mit stochastischen Methoden aus früheren Messungen Aussagen über die Zukunft getroffen und Auswirkung von Änderungen analysiert. Marianne Petersen hat dazu den Verkehr im Rhein-Main-Gebiet betrachtet und beschreibt im Gespräch mit Gudrun Thäter, wie sie mit Bayes-Verfahren, Regressionsanalyse und Poisson-Verteilungen gerade auch seltene Unfallereignisse analysieren konnte. Literatur und Zusatzinformationen A.Aurich: Modelle zur Beschreibung der Verkehrssicherheit innerörtlicher Hauptverkehrsstraßennetze unter besonderer Berücksichtigung der Umfeldnutzung, Dissertation an der Fakultät Verkehrswissenschaften der Technischen Universität Dresden, 2012. Department of Transport: Design Manual for Roads and Bridges, UK, 1995. Department of Transport: The COBA manual, Economic Assessment of road schemes, UK, 2006. L. Fawcett, N. Thorpe: Mobile safety cameras: estimating casualty reductions and the demand for secondary healthcare, Journal of Applied Statistics, Vol. 40, Iss. 11, 2013.

Getriebeauswahl

Getriebe sind mechanische Komponenten, die oft zwischen Motoren und anzutreibenden Maschinenteilen zum Einsatz kommen, und übersetzen Drehmomente und Drehzahlen. Für einen Anwendungsfall gibt es aber viele einsetzbare Getriebe mit vielen weiteren Eigenschaften, wie Wirkungsgrad, Geräuschentwicklung, Größe, Gewicht und vieles mehr. Jonathan Fröhlich hat hier die Frage betrachtet, wie man bei der Auswahl des Getriebes vorgehen kann, und erklärt im Gespräch mit Gudrun Thäter, wie hier der Analytic Hierarchy Process den Entscheidungsprozess durch die Berechnung von Eigenwerten und Eigenvektoren unterstützen kann. Literatur und Zusatzinformationen R.W. Saaty: The analytic hierarchy process—what it is and how it is used, Mathematical Modelling, Volume 9, Issues 3–5, 161-176, 1987. D. Gastes: Erhebungsprozesse und Konsistenzanforderungen im Analytic Hierarchy Process (AHP), Dissertation am Karlsruher Institut für Technologie (KIT), 2011. W. Steinhilper, B. Sauer: Konstruktionselemente des Maschinenbaus 2, Springer, 2012. Der Maschinenraum-Podcast zu vielen weiteren Fragen im Maschinenbau.

Wahlsysteme

Wahlsysteme definieren den Ablauf von Wahlen, und wie daraus ein Wahlergebnis bestimmt wird. Dieses Ergebnis soll die oft sehr unterschiedlichen Vorstellungen der Wählenden möglichst gut repräsentieren. Philipp Staudt hat dazu mathematisch analysiert, wie das deutsche Wahlsystem gegenüber alternativen Verfahren wie der Rangaddition und der Condorcet-Methode abschneidet. Ein besonderes Augenmerk lag im Gespräch mit Gudrun Thäter auch auf der Frage, wie die 5 Prozent-Klausel unter verschiedenen Voraussetzungen das Ergebnis beeinflusst. Literatur und Zusatzinformationen K.J. Arrow: Social choice and individual values, Volume 12, Yale university press, 2012. B. Pareigis: Sind Wahlen undemokratisch, mathe-lmu.de Nr.14, (26-33), 2006. D. Black, R.A. Newing, I. McLean, A. McMillan, B.L. Monroe: The theory of committees and elections, Springer, 1958. A. Tangian, Mathematical theory of democracy, Springer, 2013. G.G. Szpiro: Die verflixte Mathematik der Demokratie, Springer, 2011.

Last-Call Auktionen

Last-Call Auktionen sind Auktionen, in denen ein Bieter bevorzugt wird. Marie-Christin Haufe beschäftigt sich in ihrer Diplomarbeit mit dieser Auktionsform und untersucht, wie sich die Vergabe eines Last-Call Rechts auf das Bietverhalten der nichtbevorzugten Bieter auswirkt. Dabei werden spieltheoretische Gleichgewichte berechnet, ökonomisch interpretiert und ihre Auswirkungen auf den erwarteten Auktionserlös mathematisch analysiert. Im Gespräch mit Gudrun Thäter erklärt sie, wie sie mit der Modellierung durch die Betaverteilung Aussagen über die Bieterstärken, Wertschätzung und der Aggressivität im Auktionsprozess sowohl als Erstpreisauktion als auch in einer Zweitpreisauktion treffen konnte. Literatur und Zusatzinformationen J.-S. Lee: Favoritism in asymmetric procurement auctions, International Journal of Industrial Organization 26.6: 1407-1424, 2008. B. Lebrun: Revenue-Superior Variants of the Second-Price Auctions, Discussion paper, York University, 2012. V. Krishna: Auction theory, Academic press, 2009.

Predictive Analytics

Bei Blue Yonder, einem führenden Lösungsanbieter im Bereich Prognosen und Mustererkennung in Europa, arbeitet Florian Wilhelm an verschiedenen Kundenprojekten und spricht darüber mit Gudrun Thäter. Ein konkretes Beispiel sind Absatzprognosen für einen Kunden im Einzelhandel. Mit diesen Prognosen kann der Disponent eine optimale Entscheidung treffen wie viele Produkte er von einem Großhändler kauft, um bei hoher Warenverfügbarkeit möglichst geringe Abschreibungen durch verdorbene Ware zu haben. Zur Generierung dieser Prognosen werden sowohl Methoden aus dem Bereich des Maschinellen Lernens wie auch der Statistik angewendet. Manche Methoden haben ihren Ursprung in der Teilchenphysik, wo sie verwendet werden um Teilchen in den Experimenten am CERN nachzuweisen. Literatur und Zusatzinformationen V. Mayer-Schönberger, K. Cukier: Big Data: A Revolution That Will Transform How We Live, Work and Think, HMH Books, 2013. A. Beck, M. Feindt: Einführung in die Blue Yonder Basistechnologie, Research Paper, 2013. M. Feindt: Why cutting edge technology matters for Blue Yonder solutions, Research Paper, 2014. C. Bishop: Pattern Recognition and Machine Learning (Information Science and Statistics), Springer Science, 2006. T. Hastie, R. Tibshirani, J. Friedman: The Elements of Statistical Learning, Springer Series in Statistics, 2009. Predictive Analytics (19MB,mp3)

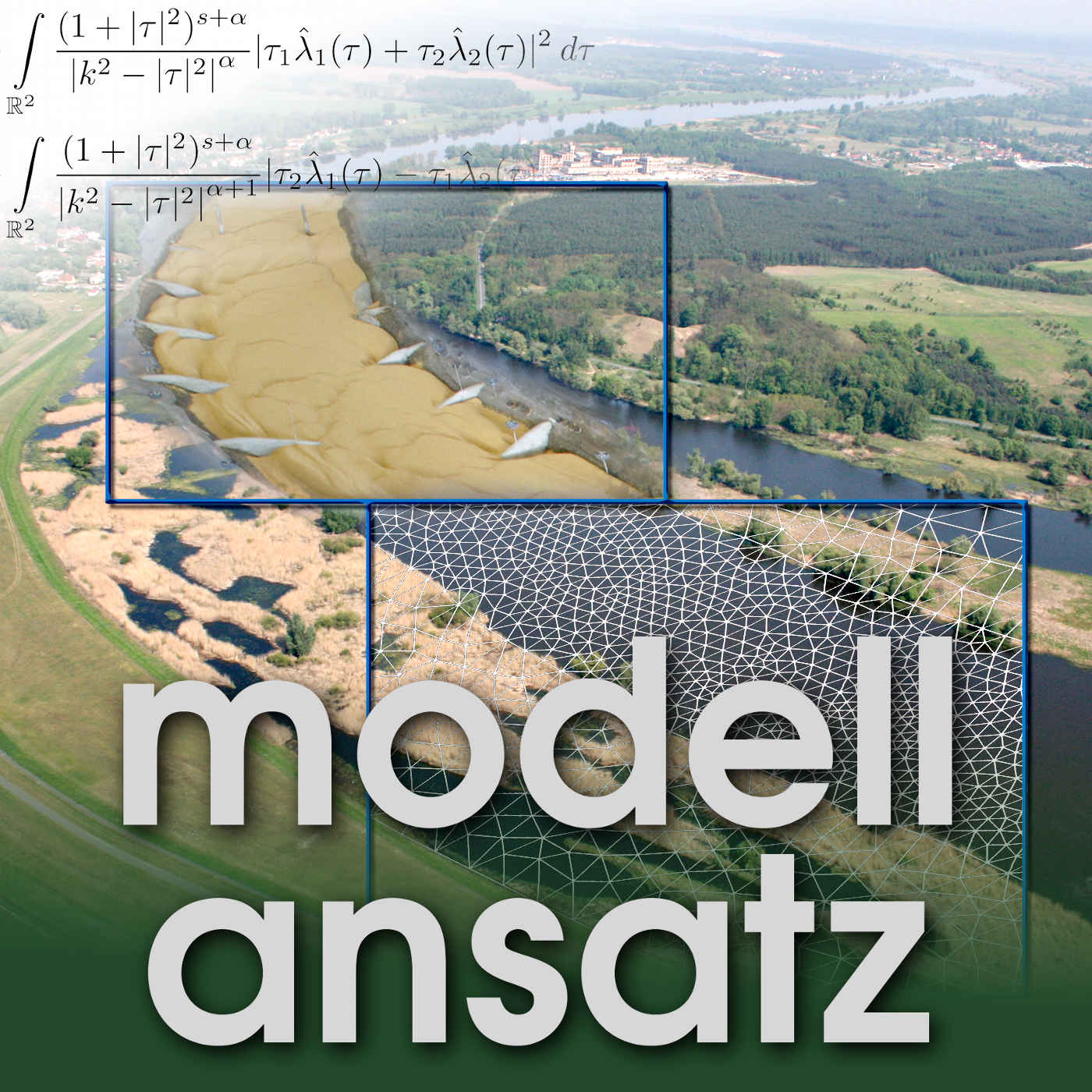

Wasserstraßen

An der Bundesanstalt für Wasserbau (BAW) befasst sich Rebekka Kopmann in der Abteilung für Flusssysteme mit Analysen und Prognosen des Systemzustands von Bundeswasserstraßen. Strömungsmodelle liegen am BAW sowohl als nachgebaute Modelle von Flussstücken als auch als mathematisch beschriebene Computermodelle vor, die nur im Rechner simuliert werden. Im Gespräch mit Gudrun Thäter beschreibt sie die Herausforderung der Kalibration der Simulationsmodelle an die Wirklichkeit, damit sinnvolle Analysen und Prognosen möglich werden. Neben vielen weiteren Parametern ist die Rauheit im Fluss sehr wichtig und ist leider nur sehr zeitaufwendig zu bestimmen. Die Aufgabe führt sie auf ein Optimierungsproblem zurück, wo die unbekannten Parameter durch Annäherung vielfach ausgeführter Simulationen an die gemessene Wirklichkeit bestimmt werden. Da eine einzelne Flusssimulation teilweise tagelang rechnet, sucht sie nach sinnvollen Vereinfachungen oder Alternativen, die das Problem schneller lösen. Aktuell werden Methoden der Automatischen Differentiation eingesetzt, die helfen Gradientenverfahren zur Annährung an die Lösung zu beschleunigen. Dabei trifft man auch auf interdisziplinäre Herausforderungen, wenn es um die feinen mathematischen Unterschiede zum Beispiel zwischen Ableitung, Steigung und einem Gradienten geht. Literatur und Zusatzinformationen R. Kopmann, A. Goll (eds): 20th TELEMAC-MASCARET User Conference 2013, Proceedings, Karlsruhe, 2013. U. Merkel, J. Riehme, U. Naumann: Rückrechnung von Rand- und Anfangsbedingungen mit Telemac und Algorithmischer Differentiation, Wasserwirtschaft H.12, S.22-27, 2013. R. Kopmann, M. Schäfer: Automatic Calibration with Telemac-AD, Proceedings 21st Telemac-Mascaret User Conference 2014, Grenoble (abstract submitted), Okt. 2014. M. Schäfer: Erprobung von Optimierungsalgorithmen für die Kalibrierung eines Finite-Elemente Strömungsmodells auf Basis von Gradienten. Masterarbeit Karlsruher Institut für Technologie, Karlsruhe, 2014.

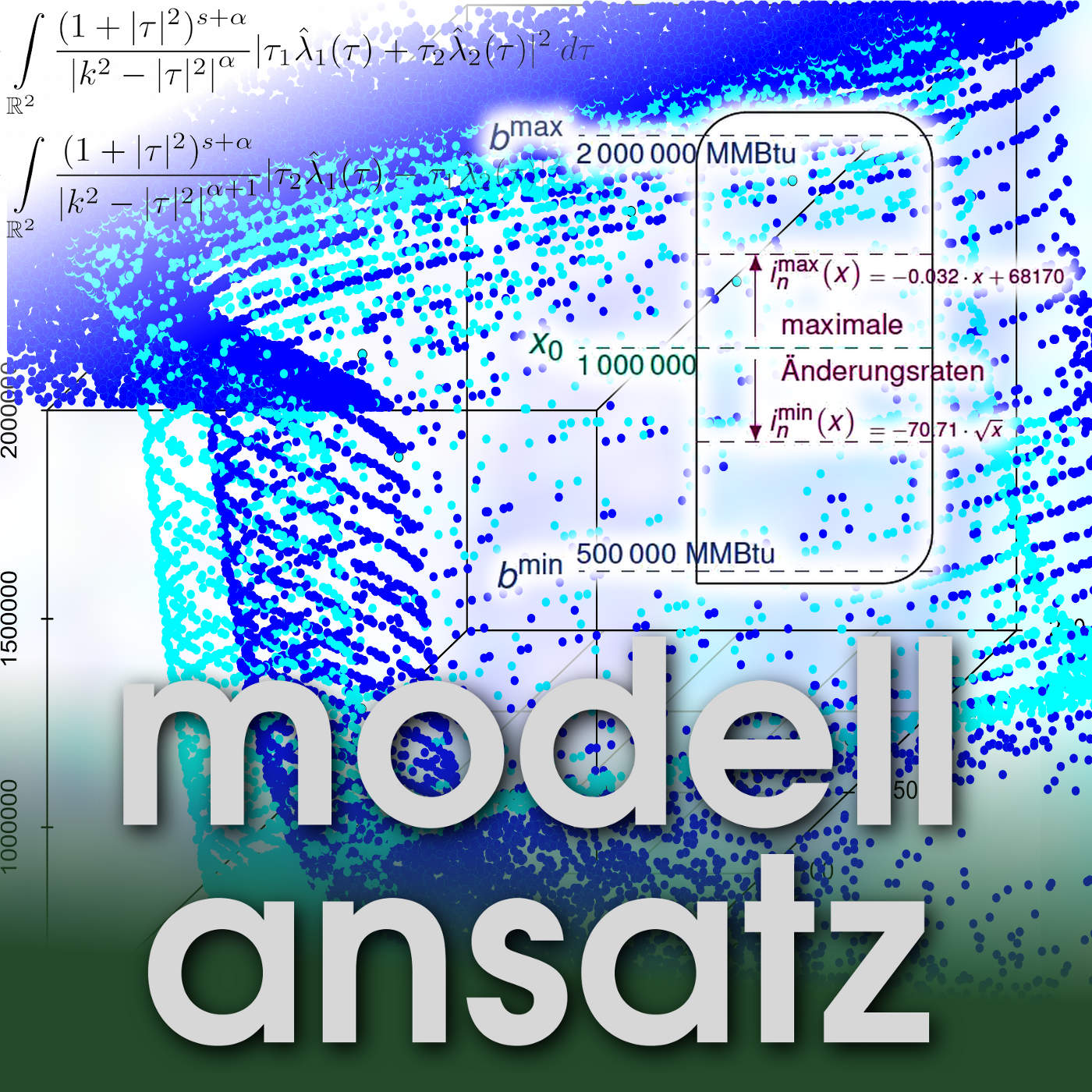

Gasspeicher

Um Gasspeicher mit möglichst viel Gewinn zu betreiben, verwendet Viola Riess Markov-Prozesse, um mit statistischen Methoden und durch mathematische Modelle optimale Handelsstrategien zu berechnen. Dabei muss sie neben Vorhersagemodellen für den Gaspreis auch die Restriktionen des Speichers in Füllstand und Kapazität berücksichtigen. Im Gespräch mit Gudrun Thäter erklärt sie die Diskretisierung des stochastischen Prozesses in ein Gitter, und die Rückwärtsinduktion zur Bewertung der Strategie, wie wir sie auch schon im Podcast zu Pumpspeicherkraftwerken kennengelernt hatten. Literatur und Zusatzinformationen A. Boogert, C. de Jong: Gas storage valuation using a monte carlo method, Journal of Derivatives, Vol. 15, No. 3: pp. 81-98, 2008. N. Secomandi: Optimal Commodity Trading with a capacitated storage asset, Management Science, Volume 56 Issue 3, 2010. F. E. Benth, J. S. Benth, S. Koekebakker: Stochastic modelling of electricity and related markets, Vol. 11. World Scientific, 2008.

Versuchsplanung

Mit Differentialgleichungsmodellen werden oft zeitliche und/oder räumliche Prozesse modelliert, beispielsweise auch enzymatisch katalysierte Reaktionen. Anna Osberghaus schildert im Gespräch mit Gudrun Thäter, wie sie in ihrer Diplomarbeit mit Hilfe von Modelldiskriminierung unter den möglichen Reaktionswegen eines bestimmten Enzyms den wahrscheinlichsten bestimmt hat und danach mittels optimaler Versuchsplanung Experimente entworfen hat, die die Entscheidung für einen bestimmten Reaktionsweg in Zukunft vereinfachen sollten. Nebenbei schildert sie humorvoll und ehrlich ihren Werdegang von einer an "echten Daten" interessierten Mathematikstudentin zum PostDoc im Ingenieurwesen. Literatur und Zusatzinformationen A. Osberghaus (geb. Siudak), E. von Lieres, C. Müller: Estimation, model discrimination, and experimental design for implicitly given nonlinear models of enzyme catalyzed chemical reactions., Mathematica Slovaca, 59(5),593-610, 2009. A. Osberghaus (geb. Siudak): Robuste Parameterschätzung, Modelldiskriminierung und optimale Versuchsplanung am Beispiel von In-vitro-Datensätzen zur Benzaldehydlyase, Diplomarbeit an der Carl von Ossietzky Universität Oldenburg, 2007. A. Pázman: Nonlinear Statistical Models, Mathematics and its Applications, Kluwer, Dordrecht, 1993. A.C. Atkinson, A.N. Donev: Optimum Experimental Designs, Oxford Statistical Science Series, Oxford University Press, Oxford, 1992.

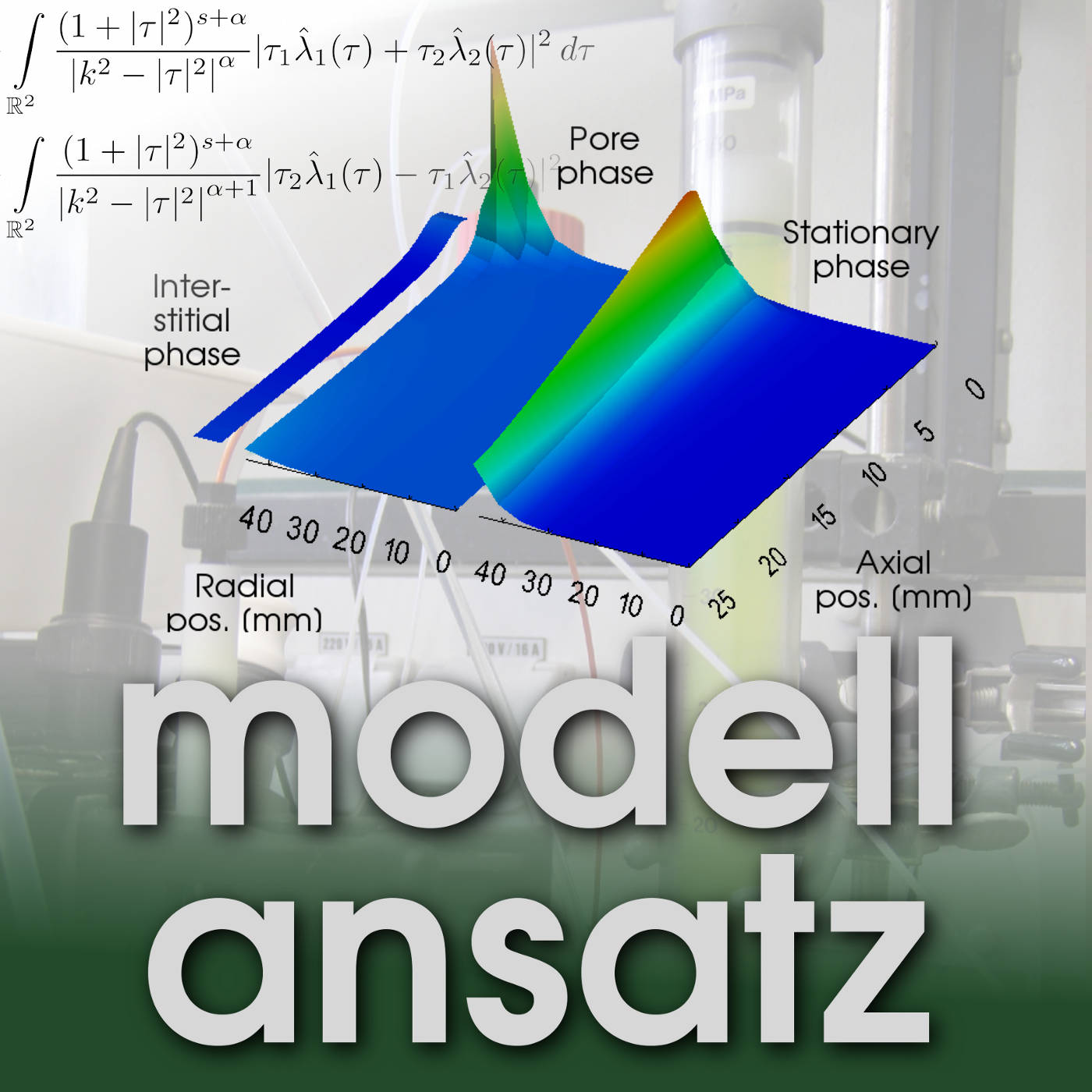

Chromatographie

Tobias Hahn simuliert mit einem Konvektions-Diffusions-Modell die Makrokinetik in einer Chromatographie-Säule zur Isolation und Analyse von Proteinen und Antikörper für verbesserte Medikamente und viele weitere bio-chemische Produkte. Im Gespräch mit Gudrun Thäter erklärt er, wie Simulationen die Chromatographie verbessern und die Anzahl von Experimenten verringern. Eine besonders wichtige Anwendung ist auch die Parameterschätzung von unbekannten Größen aus durchgeführten Experimenten, wo durch das Fitting der Simulation an die gemessenen Daten die einzelnen Prozesse analysiert werden können. Literatur und Zusatzinformationen ChromX - Simulation toolbox for liquid chromatography of proteins. T. Hahn, A. Sommer, A. Osberghaus, V. Heuveline, J. Hubbuch: Adjoint-based estimation and optimization for column liquid chromatography models, Computers & Chemical Engineering, 64, 41-54, 2014. H. Schmidt-Traub, M. Schulte, A. Seidel-Morgenstern (Eds.): Preparative Chromatography, Second Edition, Wiley-VCH Verlag GmbH & Co. KGaA, 2012. Chromatography Online: Library4Science Chrom-Ed Series, Online books on chromatography

Zeitreihen