Modellansatz

252 episodes — Page 3 of 6

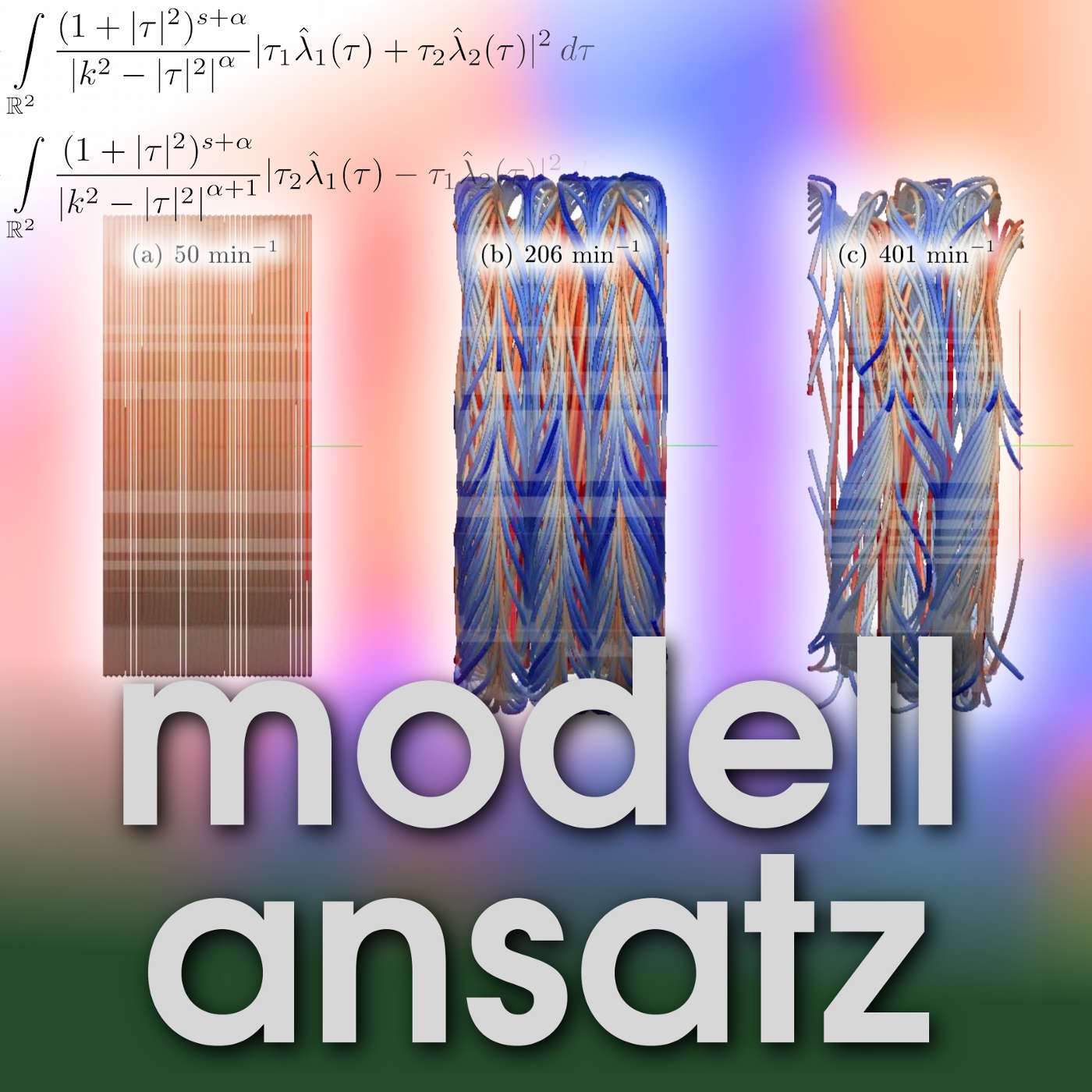

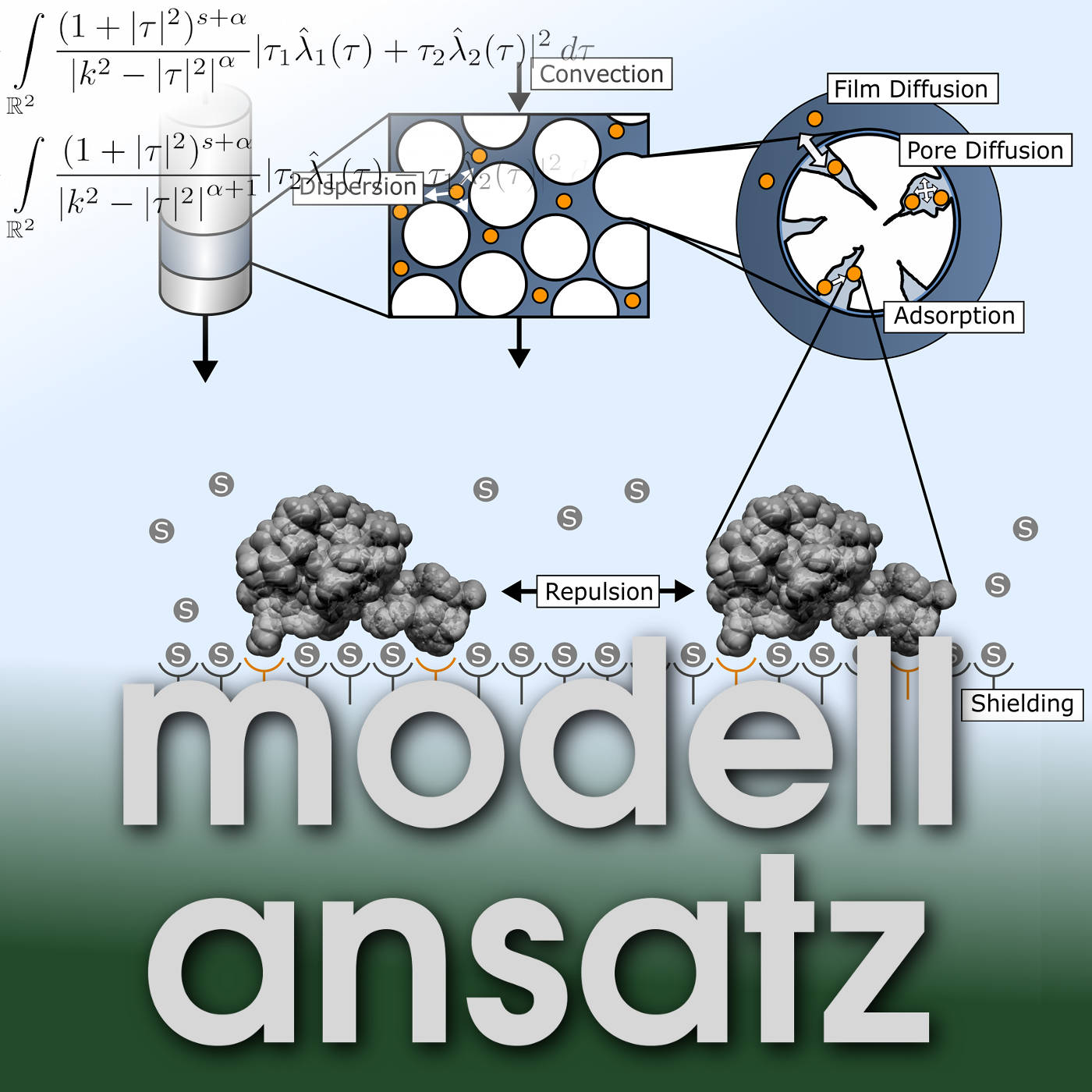

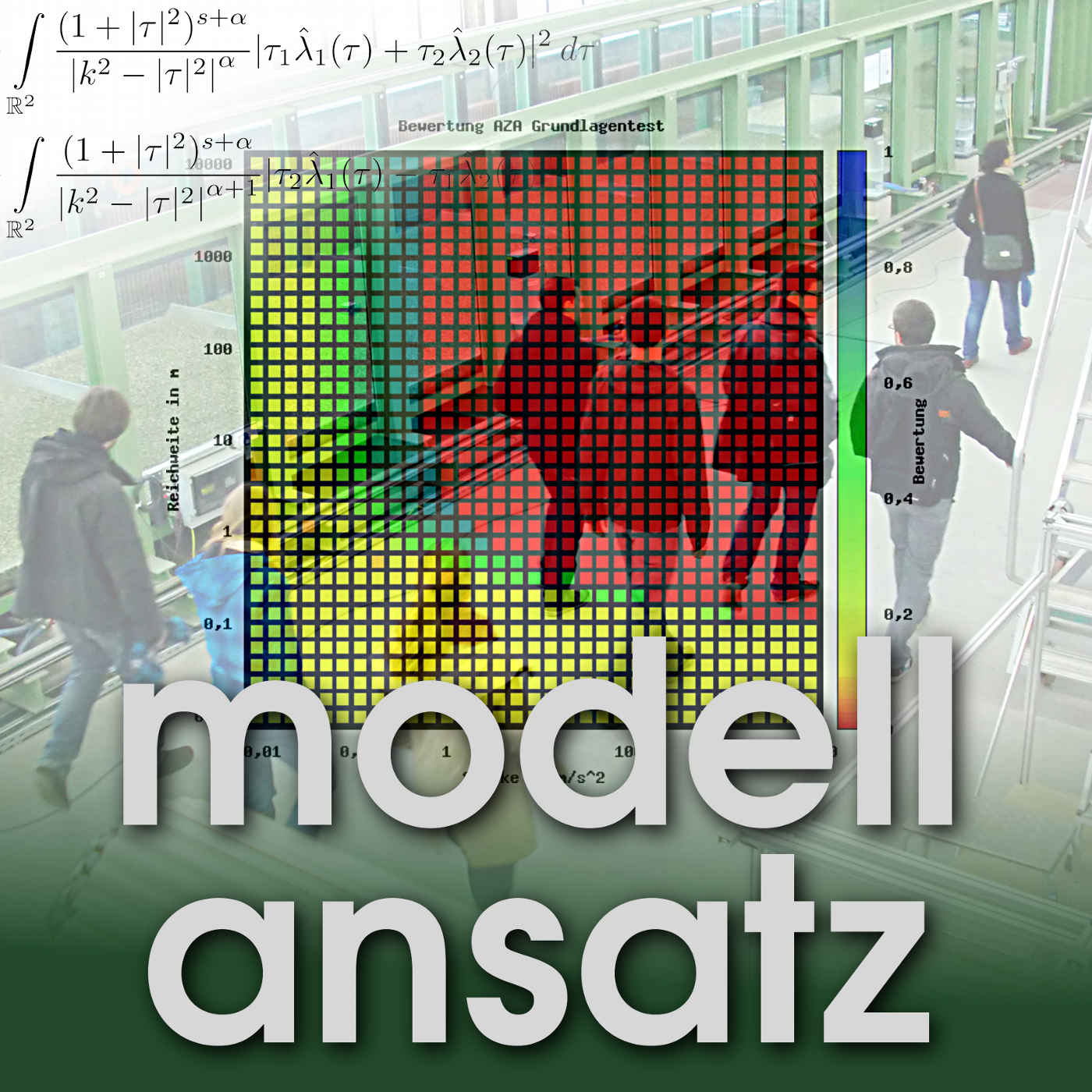

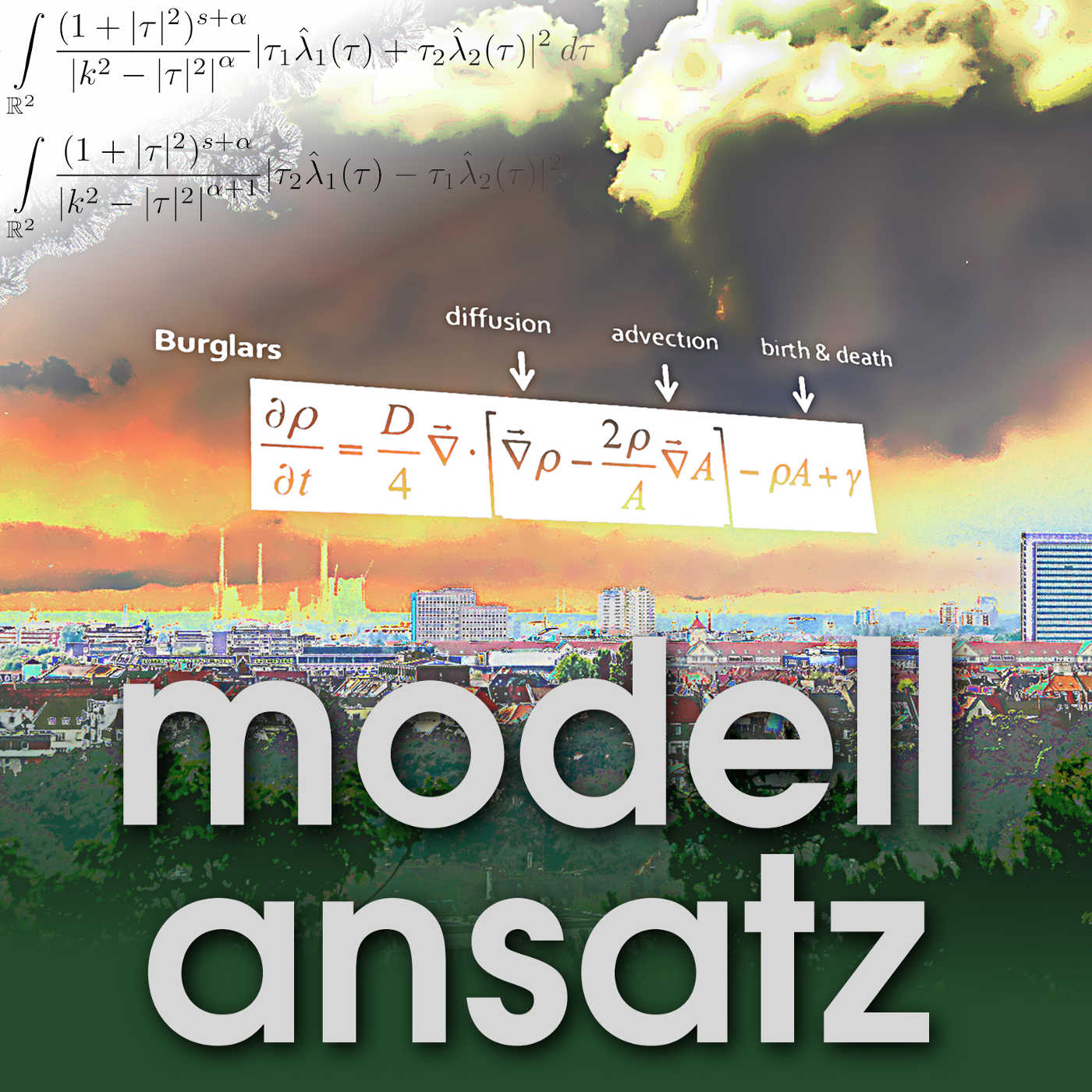

Luftspalt

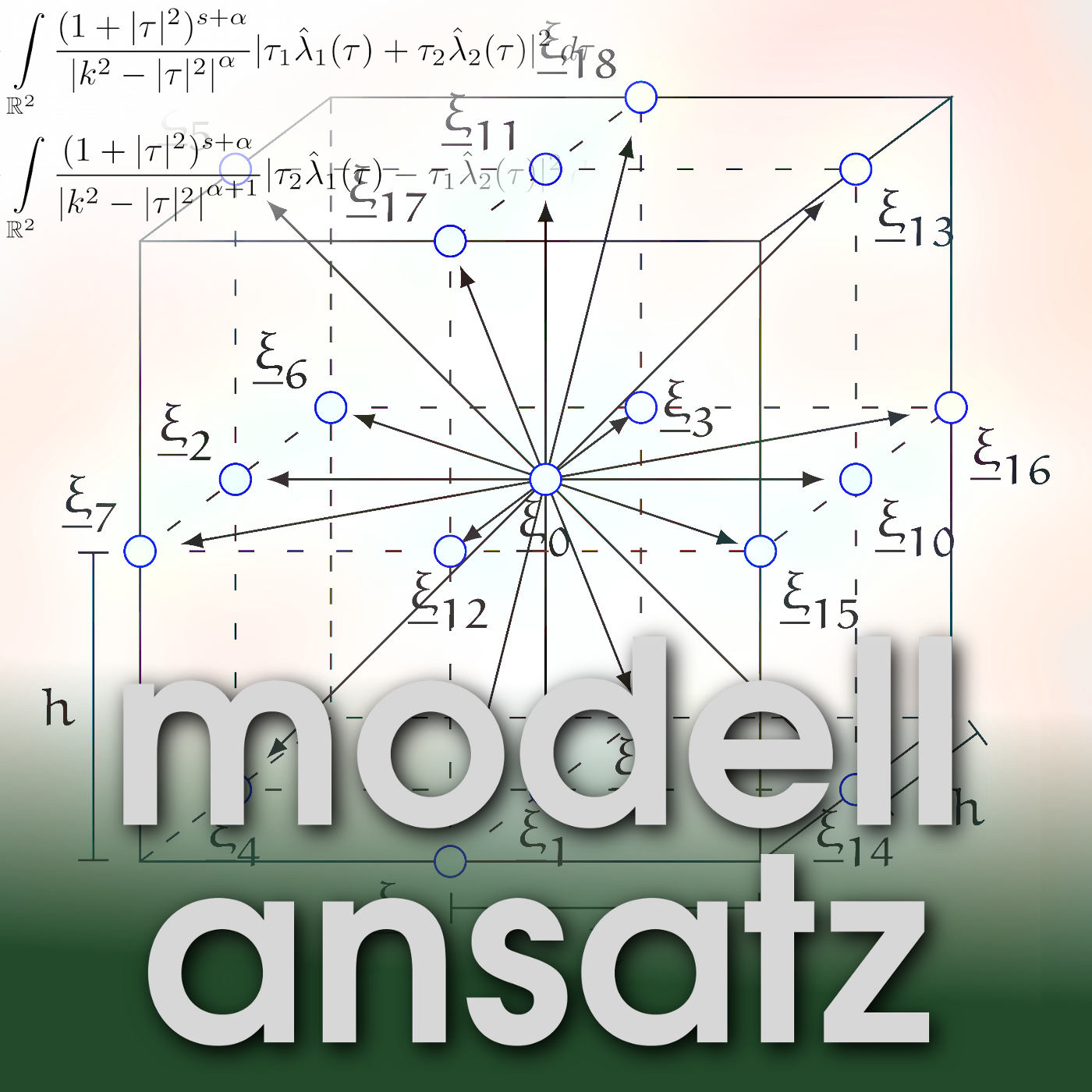

Gudrun unterhält sich mit Tabitha Hoffmann über ihre im Dezember 2017 vorgelegte Masterarbeit mit dem Titel: On the Applicability of Computational Fluid Dynamics on the Determination of Elements in the Thermal Circuit of Electrical Machines. Das Projekt war eine Zusammenarbeit mit der Firma SEW-Eurodrive in Bruchsal. Das Temperaturverhalten von Elektromotoren ist von großem Interesse, denn kennt man die Temperaturverteilung im Elektromotor, kann man Aussagen über das Betriebsverhalten treffen und einzelne Komponenten effektiv vor Überhitzung schützen. Besonders interessant ist dabei der Raum zwischen Rotor und Stator der elektrischen Maschine, der als Luftspalt bezeichnet wird. Um die Auswirkung von Geometrieänderungen auf den thermischen Widerstand am Luftspalt abschätzen zu können, könnten ergänzende Computersimulationen große Vorteile bringen. Im Rahmen der Arbeit von Tabitha wird erstmals prinzipiell untersucht, ob aktuell die numerische Strömungsrechnung (engl. Computational Fluid Dynamics, kurz CFD) - gekoppelt mit Wärmeübertragungssimulationen - den thermischen Widerstand am Luftspalt genau genug bestimmen kann, um hier von Nutzen zu sein. In erster Näherung lässt sich der Luftspalt relativ elementar als Ringraum darstellen. Noch interessanter wären natürlich Ergebnisse, die auf einer möglichst präzisen Geometrienachbildung des Luftspaltes im Computer beruhen. Eine umfangreiche experimentelle wie theoretische Studie liegt zum Glück in Form der Dissertation von Becker aus dem Jahr 1957 vor. Beckers experimentelle Daten sind fundiert und präzise und bilden somit eine gute Grundlage für die Validierung der Simulationsergebnisse in der Masterarbeit. Exemplarisch werden von Tabitha zwei typische CFD-Zugänge gewählt: Einerseits Ansys CFX, da es ein weit verbreitetes und bei SEW gut eingeführtes kommerzielles Softwarepaket ist (es arbeitet als Black box auf der Basis von Finite-Volumen-Methoden ) und andererseits OpenLB, welches eine open source Forschungssoftware ist (auf der Basis von Lattice Boltzmann Methoden (LBM)), die in der Gruppe von Mathias Krause ständig weiterentwickelt wird. Beide Softwarepakete haben je eigene Vor- und Nachteile und stellen zwei typische Fälle dar. Das betrifft z. B. die anwenderfreundliche Benutzeroberfläche in einer kommerziellen Software, die jedoch auf den konkreten Anwendungsfall nur eingeschränkt speziell zugeschnitten werden kann vs. ein in der Schnittstelle nicht so ausgereiftes Produkt, für das jedoch recht schnell konkrete Module für das vorliegende Problem programmiert werden können. Außerdem sind auch die numerischen Paradigmen beider Pakete grundlegend unterschiedlich. Ansys CFX ist klassisch auf die numerische Lösung von kontinuierlich formulierten partiellen Differentialgleichungen spezialisiert, während LBM ein diskretes Modell für Strömung wählt und dieses dynamisch entfaltet. Als möglichst einfacher Einstieg in die Thematik wird in der Arbeit zunächst von Wärmeübertragung zwischen konzentrischen Zylindern mit rotierendem Innenzylinder ausgegangen und das Problem ohne axiale Strömung betrachtet. Man spricht von einer Taylor-Couette Strömung. Ist die Geschwindigkeiten des inneren Zylinders hoch genug, entstehen Taylor-Wirbel. Die Simulationsergebnisse wurden mit den Messergebnissen von Becker und der Theorie zur freien Konvektion in horizontalen Ringen validiert. Anschließend wurden die Löser auf eine realistischere Geometrie angewendet mit Schlitzen am Stator (allerdings wieder ohne axiale Strömung). Zusammenfassend kann gesagt werden, dass die Simulationsergebnisse in guter Übereinstimmung mit den Messergebnissen und der Theorie sind, aber nicht genau die gleiche kritische Taylorzahl liefern. Ein grundlegendes Problem für beide numerische Zugänge ist, dass der Luftspalt im Vergleich zu den Radien von Rotor und Stator sehr klein ist. Literatur und weiterführende Informationen ANSYS, Inc.: Innovative Turbulence Modeling: SST Model in ANSYS CFX/ ANSYS Inc. Version: 2011, Forschungsbericht ANSYS, Inc.: Ansys CFX Documentation 25th November 2017 Batchelor, G. K.: An introduction to fluid dynamics. Cambridge Univ. Press 1967. Becker, K. M.: An experimental and theoretical study of heat transfer in an annulus with an inner rotating cylinder, M.I.T., Diss., 1957 Chorin, A. J. ; Marsden, J. E.: A mathematical introduction to fluid mechanics. 2. ed. Springer Lancial, N. e.a.: Taylor-Couette-Poiseuille flow and heat transfer in an annular channel with a slotted rotor. In: International Journal of Thermal Sciences 112 (2017), Nr. Supplement C, 92 - 103. Hydrodynamische Instabilität

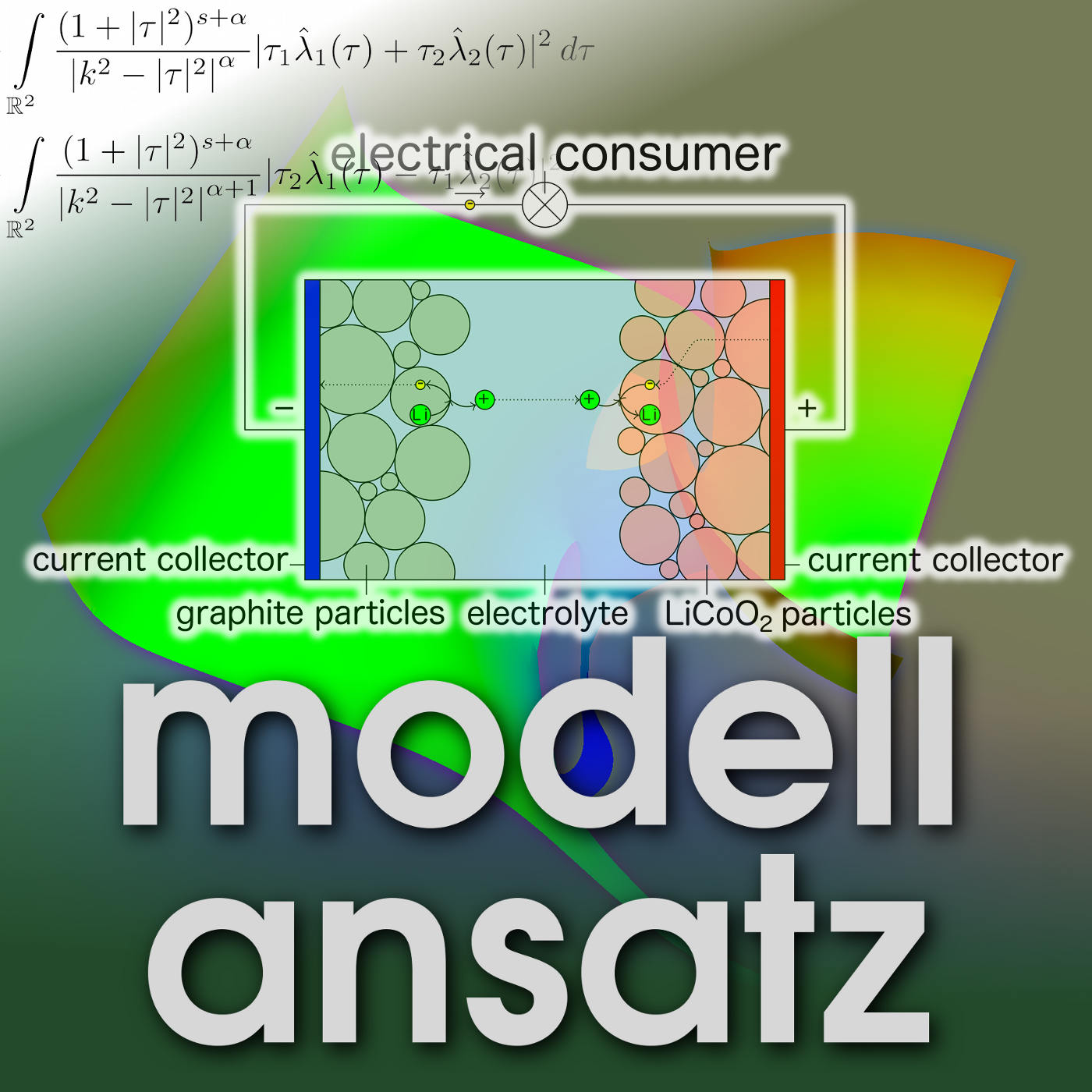

Kinetische Theorie

Gudrun wollte sich mit unserem neuen Kollegen über sein hauptsächliches Forschungsthema, die kinetische Theorie unterhalten. Diese Denkweise wurde zur Modellierung von Gasen entwickelt und ist inspiriert von physikalischen Vorstellungen, die kinetische Energie als inhärente Eigenschaft von Materie ansieht. Die kinetische Gastheorie schaut auf die mikroskopische Ebene, um schließlich makroskopische Größen wie Wärme und Temperatur besser zu erklären. Im sogenannten idealen Gas bewegen sich unfassbar viele kleine Massepunkte entsprechend der Newtonschen Mechanik frei, ungeordnet und zufällig im Raum, stoßen dabei ab und zu zusammen und wir empfinden und messen den Grad der Bewegungsaktivität der Teilchen als Wärme. Die Einheit, die man dieser Größe zunächst zuwies war Kalorie von lat. Calor=Wärme. Heute ist die richtige SI-Einheit für Energie (und damit auch Wärme) das Joule. Die messbare Größe Temperatur ist damit vereinfacht ausgedrückt die mechanische Engergie im Gassystem und das Modell liefert eine kinetische Theorie der Wärme. Man kann es aber auch als Vielteilchensystem von mikroskopischen Teilchen ansehen aus denen sich in klar definierten (unterschiedlichen) Grenzwertprozessen makroskopische Größen und deren Verhalten ableiten lassen. Die Untersuchung dieser Grenzwerte ist eine mathematisch sehr anspruchsvolle Aufgabe und bis heute ein offenes Forschungsfeld, in dem nur Stück für Stück spezielle Fragen beantwortet werden. Eine Schwierigkeit ist dabei nämlich, dass automatisch immer sehr unterschiedliche Skalen nebeneinander existieren und in ihrer Interaktion richtig gefaßt und verstanden werden müssen. Außerdem ist in der Regel jeder Grenzwert, für den sich interessante Forschungsergebnisse ergeben, innerhalb der Theorie eine Singularität. Schon Hilbert hatte 1900 die axiomatische Fassung der Physik zwischen Mechanik und Wahrscheinlichkeitsrechnung als eines der wichtigen mathematischen Probleme für das 20. Jahrhundert dargestellt. Wir sind seitdem vorangekommen, aber es bleibt noch sehr viel zu tun. Zum Beispiel ist die mögliche Korreliertheit zwischen den Teilchenbewegungen für Gase eine offene Frage (außer für kurze Zeiten). Ein Vorteil gegenüber der Zeit Hilberts ist heute, dass wir inzwischen auch den Computer benutzen können, um Modelle zu entwickeln und zu analysieren. Dafür muss man natürlich geeignete numerische Methoden entwickeln. In der Arbeit von Martin Frank sind es in der Regel Integro-Differentialgleichungen mit hyperbolischer partieller Differentialgleichung für die Modellierung von Bewegungen ohne Dämpfung. Diese haben schon durch die Formulierung viele Dimensionen, nämlich jeweils 3 Orts- und 3 Geschwindigkeitskomponenten an jedem Ort des Rechengebietes. Deshalb sind diese Simulationen nur auf großen Parallelrechnern umsetzbar und nutzen High Performance Computing (HPC). Hieraus erklärt sich auch die Doppelrolle von Martin Frank in der Verantwortung für die Weiterentwicklung der HPC-Gruppe am Rechenzentrum des KIT und der Anwendung von Mathematik auf Probleme, die sich nur mit Hilfe von HPC behandeln lassen. Sehr interessant ist in dieser Theorie die gegenseitige Beeinflussung von Numerik und Analysis in der Behandlung kleiner Parameter. Außerdem gibt es Anknüpfungspunkte zur Lattice Boltzmann Research Group die am KIT das Software-Paket OpenLB entwickeln und anwenden. Auch wenn sich geschichtlich gesehen die kinetische Theorie vor allem als Gastheorie etabliert hat, ist die Modellierung nicht nur in Anwendung auf Gase sinnvoll. Beispielsweise lassen sich Finanzmärkte aus sehr vielen unabhängig handelnden Agenten zusammensetzen. Das Ergebnis der Handlungen der Agenten ist der Aktienpreis - sozusagen die Temperatur des Aktienmarktes. Es lassen sich dann aufgrund dieses Modells Eigenschaften untersuchen wie: Warum gibt es so viele Reiche? Außerdem geht es auch darum, die richtigen Modellannahmen für neue Anwendungen zu finden. Zum Beispiel ist ein Resultat der klassischen Gastheorie das Beer-Lambertsche Gesetz. Es besagt, dass Photonen durch Wolken exponentiell abgeschwächen werden. Messungen zeigen aber, dass dies bei unseren Wolken gar nicht gilt. Wieso? Dafür muss man schon sehr genau hinschauen. Zunächst heißt das wohl: Die zugrunde liegende Boltzmann-Gleichung ist für Wolken eine zu starke Vereinfachung. Konkret ist es die Annahme, dass man sich die Wolken als homogenes Medium vorstellt wahrscheinlich nicht zutreffend, d.h. die Streuzentren (das sind die Wassertropfen) sind nicht homogen verteilt. Um ein besseres Modell als die Boltzmann-Gleichung herzuleiten müsste man nun natürlich wissen: Welche Art der Inhomogenität liegt vor? Martin Frank hat Mathematik und Physik an der TU Darmstadt studiert, weil er schon in der Schulzeit großes Interesse an theoretischer Physik hatte. Im Studium hat er sich schließlich auf Angewandte Analysis spezialisiert und darin auch nach dem Diplom in Mathematik an der TU Darmstadt weiter gearbeitet. In dieser Zeit hat er auch das Diplom in Physik a

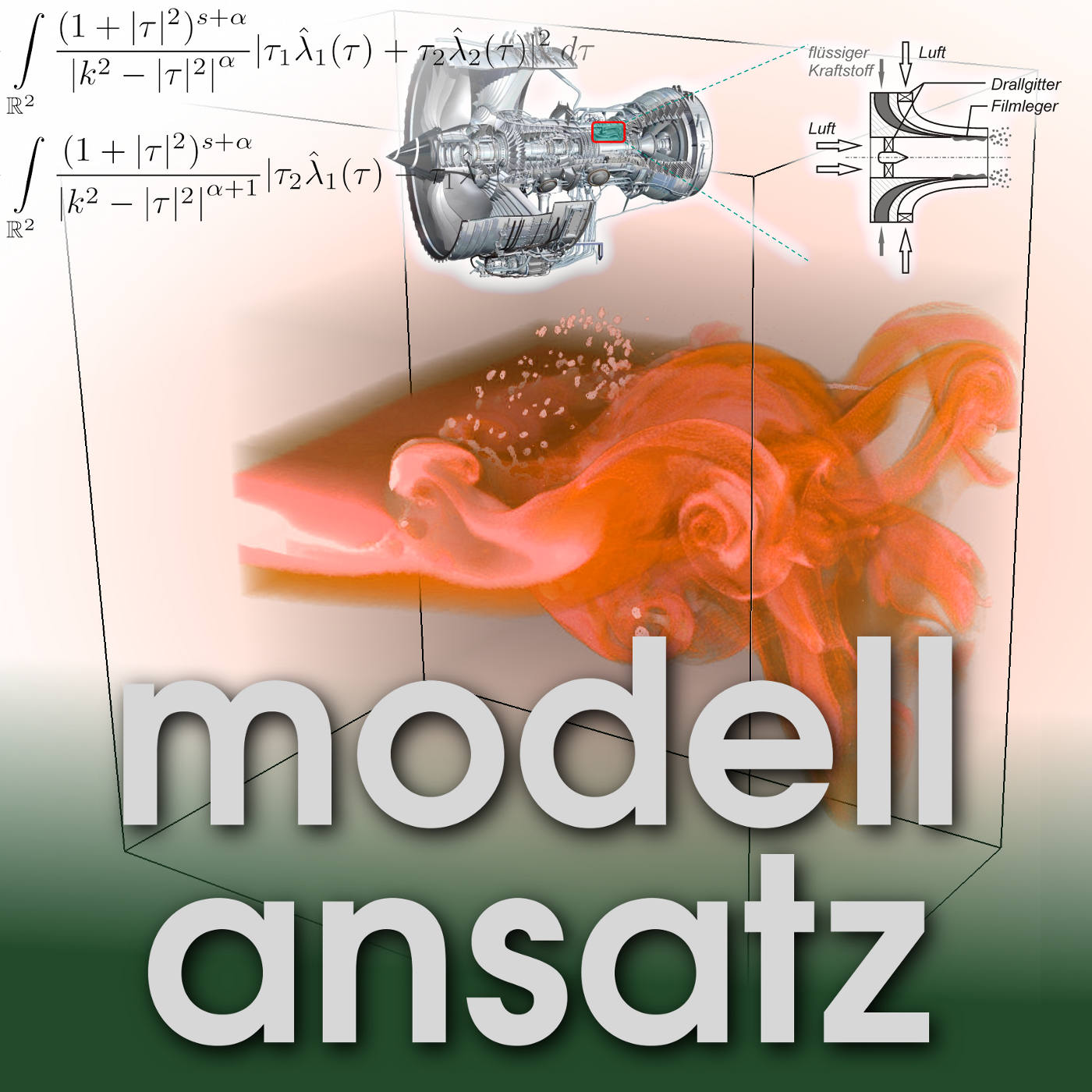

Zerstäubung

Corina Schwitzke ist Gruppenleiterin im Institut für thermische Strömungsmaschinen (ITS) am KIT. Gudrun wollte gern ein Gespräch über partikelbehaftete Strömungen mit ihr führen, denn dies ist ein wichtiges Thema in beiden Arbeitsgruppen. In Corinas Institut gilt das Interesse vor allem der Zerstäubung von Kerosin zu feinen Tröpfchen in Flugtriebwerken Seit 10 Jahren gibt es dort Strömungssimulation mit einer sogenannten Partikelmethode. Die Partikel in dieser Anwendung sind Stützstellen der Rechenmethode und repräsentieren die Flüssigkeit, z.B. Kerosin, und das Gas, d.h. die verdichtete Luft. Vom Blickpunkt der Simulation aus sind die Partikel eigentlich nur Diskretisierungspunkte, die sich mit der Strömung mitbewegen. Sie repräsentieren dabei ein Volumen und die benutzten Koordinaten "schwimmen" mit dem Fluid, d.h. die Methode benutzt ein Lagrange-Koordinatensystem. Die Gleichungen, die der Simulation zugrunde liegen, sind die Navier-Stokes Gleichungen - zunächst isotherm. Falls die Temperaturänderung mitbetrachtet werden muss, dann erfolgt das durch das Lösen der Energiegleichung, für die die diskrete Fassung sehr einfach zu realisieren ist. Das für den Zerstäubungsprozess gut geeignete numerische Verfahren, das am ITS umgesetzt wurde (und dort auch noch weiter entwickelt wird) ist Smoothed particle Hydrodynamics (SPH). Die Methode wurde zu Beginn der 1970er Jahre für die Simulation von Galaxie-Entstehung entwickelt. Ein großer Vorteil ist, dass das Verfahren sich extrem gut parallel implementieren läßt und die Simulation Gebiete ausspart, wo zunächst nichts passiert. Außerdem ist es einfacher, die Physik des Tröpfchenzerfalls zu modellieren als mit den klassischen kontinuumsmechanischen Ansätzen. Der wichtigste Aspekt für die Simulation der Kraftstoffzerstäubung ist die Oberflächenspannung. Sie muss physikalisch und numerisch richtig beschrieben werden und führt dann dazu dass ein Flüssigkeitsfilm in Tropfen zerfällt. Hier geht das Wissen um Oberflächenspannungskoeffizienten ein, die aus Experimenten gewonnen werden ebenso wie die erwartbaren Kontaktwinkel an Wänden. Das Kräftegleichgewicht von angreifenden Scher- und Oberflächenkräften muss die modellierende Physik abbilden - die numerischen Partikel bekommen daraus direkt eine Geschwindigkeit zugewiesen, die auch ausdrückt, ob der Film reißt oder zusammenhängend bleibt. Diese Partikelmethode vermeidet die Probleme von gitterbasierten Verfahren beim Reißen des Films, denn Grenzflächen werden automatisch mittransportiert. Durch die gut skalierende parallele Implementierung ist es möglich, mit einigen Milliarden Partikeln zu rechnen. Die Ergebnisse der Simulationen haben vielfältige Anwendungen. Eine ist es Schadstoffemission zu minimieren. Das ist möglich durch erzwingen der vollständigen Verbrennung des Kraftstoffes oder durch die Vermeidung der Entstehung von Stick- und Schwefeloxiden im Prozess. Das kann durch die Kraftstoffverteilung und über die Temperaturniveaus gesteuert werden. Eine andere Anwendung, die mit diesen Ideen schon funktioniert, ist die Kühlung von Zahnrädern in Getrieben durch einen Flüssigkeitsstrahl. In Zukunft soll auch die Simulation von Zerstäubung einer Biomasse möglich werden, die nichtnewtonsche Fließeigenschaften hat. Das große Ziel am ITS, das in naher Zukunft umgesetzt werden soll, ist ein virtueller Prüfstand für Zerstäubungsprozesse. Corina Schwitzke (geb. Höfler) hat Verfahrenstechnik an der Uni Karlsruhe studiert mit einem Schwerpunkt in Richtung Strömungsmechanik und Verbrennungstechnik. Ihre Diplomarbeit fertigte sie in Los Angeles zu einem Thema im Kontext von Verbrennung an. Es folgte eine Promotion an der KIT-Fakultät Maschinenbau in Karlsruhe, in der sie die Grundlage für die physikalische Modellierung der Zerstäubung mittels der SPH-Methode leistete. Studierende aus der Technomathematik und Informatik sowie dem Maschinenbau unterstützen das Institut in der Implementierung des Verfahrens.Literatur und weiterführende Informationen M.C. Keller e.a.:Turbomachinery Technical Conference and Exposition : Volume 2B - Turbomachinery Proceedings of ASME Turbo Expo 2017, Charlotte, North Carolina, USA, 26th - 30th June 2017, Art.Nr. GT2017-63594, ASME, New York (NY). doi:10.1115/GT2017-63594, 2017. M.C. Keller e.a.: Numerical Modeling of Oil-Jet Lubrication for Spur Gears using Smoothed Particle Hydrodynamics, 11th International SPHERIC Workshop, Munich, Germany, June 13-16, 2016, 69-76. S. Braun e.a.: Simulation of Primary Atomization: Assessment of the Smoothed Particle Hydrodynamics (SPH) Method ICLASS 2015 / 13th International Conference on Liquid Atomization and Spray Systems : August 23-27, 2015, Tainan, Taiwan. Ed.: Ta-Hui Lin C. Höfler:Entwicklung eines Smoothed Particle Hydrodynamics (SPH) Codes zur numerischen Vorhersage des Primärzerfalls an Brennstoffeinspritzdüsen. Dissertation. 2013. Karlsruhe. doi:10.5445/IR/1000048880 J.J. Monaghan: Smoothed Particle Hydrodynamics. Annu. Rev. Astrophys. 1992.Podcasts T. He

Mikrowellen

Gudrun unterhält sich diesmal mit Johanna Mödl. Johanna hat von August bis Oktober 2017 ihre Bachelorarbeit Analytische und numerische Untersuchungen zum mikrowelleninduzierten Temperaturanstieg von zylindrischen Probekörpern aus Beton geschrieben. Der Hintergrund war ein Thema aus dem Institut für Massivbau und Baustofftechnologie (Abt. Baustoffe und Betonbau). Dort wird untersucht, wie hochenergetische Mikrowellen solche Temperaturunterschiede in (trockenen) Betonkörpern erzeugen, dass der Werkstoff an der Oberfläche zerstört wird. Um Erfahrungswerte im Umgang mit diesem Verfahren zu erhalten, werden derzeit Laborexperimente durch das Institut für Massivbau und Baustofftechnologie und das Institut für Hochleistungsimpuls- und Mikrowellentechnik, beides Institute des Karlsruher Instituts für Technologie, durchgeführt. Auf Basis der Messergebnisse wird versucht, den Vorgang durch einfache Gleichungen zu beschreiben, um vorhersagen zu können, wie er sich in größerem Maßstab verhält. Aufgrund der Komplexität des Prozesses werden nur vereinfachende Modelle betrachtet. Da diese sich durch partielle Differentialgleichungen beschreiben lassen, sollte der Vorgang während der Bachelorarbeit aus mathematischer Sicht analysiert werden. Die Ausbreitung der Mikrowellen-Energie als Wärme im Baustoff wird durch die Wärmeleitungsgleichung gut beschrieben. Dies ist eine in der Mathematik wohlstudierte Gleichung. Im Allgemeinen lassen sich aber analytische Lösungen nur schwer oder gar nicht berechnen. Daher mussten zusätzlich numerische Verfahren gewählt und implementiert werden, um eine Approximation der Lösung zu erhalten. Johanna entschied sich für das Finite-Differenzen-Verfahren im Raum und ein explizites Eulerverfahren in der Zeitrichtung, da beide einfach zu analysieren und zu implementieren sind. Erfreulicherweise stimmt die numerisch auf diese Weise approximierte Lösung mit den experimentellen Ergebnissen in den hauptsächlichen Gesichtspunkten überein. Die Wärme breitet sich von der Quelle in den Beton aus und es kommt im zeitlichen Verlauf zu einer kontinuierlichen Erwärmung in den Körper hinein. Das größte Problem und die vermutliche Ursache dafür, dass die Meßdaten noch nicht ganz genau mit den Simulationen übereinstimmen ist, dass man physikalisch sinnvollere Randbedingungen bräuchte. Im Moment wird - wie üblich - davon ausgegangen, dass am Rand des Betonzylinders, wo nicht die Energie eintritt, der Körper Umgebungstemperatur hat. Hier bräuchte man eine phyiskalische Modellierung, die das korrigiert. Literatur und weiterführende Informationen W. Hackbusch: Theorie und Numerik elliptischer Differentialgleichungen, Springer Spektrum, Wiesbaden, 4. Auflage, 2017. B. Lepers e.a.: A drying and thermoelastic model for fast microwave heating of concrete. Global Digital Central, Frontiers in Heat and Mass Transfer, 2014. M. Umminger e.a.: Ablation kontaminierter Oberflächen zementgebundener Bauteile beim Rückbau kerntechnischer Anlagen. Abschlussbericht, BMBF- Förderkennzeichen 02S8709 und 02S8719, Februar 2015.

Wahlprognosemodelle

Gudrun hat sich mit Oliver Beige unterhalten. Im Gespräch geht es um die theoretische Seite von Modellen für Wahlprognosen. Dabei beziehen sie sich in vielen Beispielen auf den Wahlkampf in den USA und insbesondere auf die Besonderheiten der Kampagne von Donald Trump. Die Gelegenheit bot sich vor einem gemeinsamen Konzertbesuch in Berlin-Neukölln in der Alten Welt Siralti. In der Theorie sind Wahlprognosemodell traditionell in der Politologie verankert, wurden aber immer mehr durch ökonomische Modelle verbessert. Die größte Veränderung der letzten Jahre ist, dass es immer mehr empirische Daten gibt, die auch zum Teil der Öffentlichkeit zur Verfügung stehen. Solche Daten und Diskussionen zur Wertung finden sich z.B. auf der Webseite FiveThirtyEight. Große Berühmtheit erreichte schließlich Nate Silver dadurch, dass er 2008 in 49 von 50 US-Bundeststaaten das Ergebnis der US-Präsidentschaftswahlen korrekt vorhergesagt hatte. Im Wahljahr 2012 stimmte seine Vorhersage sogar in allen 50 Staaten. Seine Ergebnisse erzielte er dabei lediglich durch Aggregation von veröffentlichten Umfrageergebnissen. Im Wahljahr 2016 hat aber Donald Trump die Wahl gewonnen obwohl Nate Silvers Modelle (und die Modelle ähnlich arbeitender Wahlforscher) die Wahrscheinlichkeit dafür, dass Hillary Clinton die Präsidentschaftswahl für sich entschieden wird, auf 70% - 99% beziffert hatten. Es stellt sich die Frage, wo der Fehler dieser Prognosemodelle lag. Wenn man im Jahr 2016 genau zuhörte, gab es auch Stimmen, die Donald Trump schon im Frühjahr als wahrscheinlichen Gewinner der Wahlen sahen - z.B. die Zeitung Los Angeles Times. Sie wurden in den Medien zwar lieber als Ausreißer dargestellt, behielten aber schließlich recht. Wieso? Sie hatten den Demographiewandel in den USA in ihre Modellbildung einbezogen. Um zu verstehen, was damit gemeint ist, muss man zunächst einmal klarer beschreiben, wie US-Wahlen traditionell bisher abliefen, und welche Modelle daraus abgeleitet wurden. Es gibt ein schönes Denkmodell, das veranschaulicht, wie das sogenannte Hotelling Gesetz (1929) wirkt. Man stelle sich zwei Eisverkäufer am Strand vor. Wie sollten sie jeweils ihren Stand so positionieren, dass sie möglichst viele Kunden anziehen? Die stille Annahme dabei ist, dass die Badenden gleichmäßig über den Strand verteilt sind und alle irgendwann Lust auf ein (genau ein) Eis bekommen. Das verblüffende Ergebnis ist: Ein Equilibrium der Einflussbereiche der beiden Verkäufer stellt sich ein, wenn beide in der Mitte des Strandes nebeneinander stehen. Im Wahlkampf in den USA folgt man dieser Strategie, indem beide endgültigen Präsidentschaftskandidaten wenig ideologisch unterscheidbar aufgebaut werden. Begünstigt wird das auch durch das mehrstufige Wahlsystem, denn die Vorwahlen (Primaries) kann man dazu nutzen, dass die extremeren Kandidaten herausgefiltert werden. Dann entscheidet über den Sieg schließlich vor allem die erfolgreiche Mobilisierung der Wechselwähler. Eine (stillschweigende) Voraussetzungen dafür, dass von der Ähnlichkeit der Positionen der eigene Kandidat profitiert ist, dass die Wahlbeteiligung hoch ist. Das ist in den USA leider immer weniger der Fall. Dass die Wahlen 2016 anders verliefen als gewohnt, zeigte sich, als bei den Republikanern die Establishmentkandidaten keine Chance gegen den idologisch extremen Trump hatten. Bei den Demokraten konnte jedoch die moderatere Hillary Clinton den ideologisch positionierten Bernie Sanders ruhig stellen. Das bricht mit den bisher gültigen Annahmen der Wahlvorhersagemodelle: Hotellings Model funktioniert nicht mehr. Aber nur weniger der Modelle erkennen die veränderte Situation und reagieren mit neuen Prognosemodellen. Trump hatte dann schließlich auch Erfolg mit seiner Strategie, die Clinton-Wählerschaft zu entmutigen überhaupt zur Wahl zu gehen und die eigene - eigentlich kleine - Clientel extrem zu mobilisieren. Den Trend zur Radikalisierung der Republikaner beobachtet man tatsächlich schon eine Weile. Er setzte etwa mit der Wahl von Reagan ein. Es gab die inzwischen sprichwörtlichen "27%" -- Wähler, die auch einen völlig unqualifizierten rechtsgerichteten Kandidaten wählen. Der sprichwörtliche Name wurde erfunden, nachdem bei der Senatswahl in Illinois ein erkennbar aussichtsloser Kandidat gegen den damals unbekannten Obama 27% der Stimmen erhielt. Diese Zahl ist seitdem eher gestiegen. Für Wahlprognosen braucht es also Modelle, die dieses bekannte menschliche Verhalten besser berücksichtigen. Keith T. Poole und Howard Rosenthal sammeln alle Stimmen im amerikanischen Kongress - das sind ja einfache Ja/Nein Entscheidungen - und analysieren sie fortlaufend. Ihre Methoden lieferten Politikwissenschaftlern erstmals rigorose quantitative Methodiken für Ideologiehörigkeit von Entscheidern über die Zeit der Existenz der USA hinweg. Man nennt dies die Nominal Three-Step Estimation. Literatur und weiterführende Informationen Eisverkäufer Modell K.T. Poole, H. Rosenthal: A Spatial Model for Legislative Rol

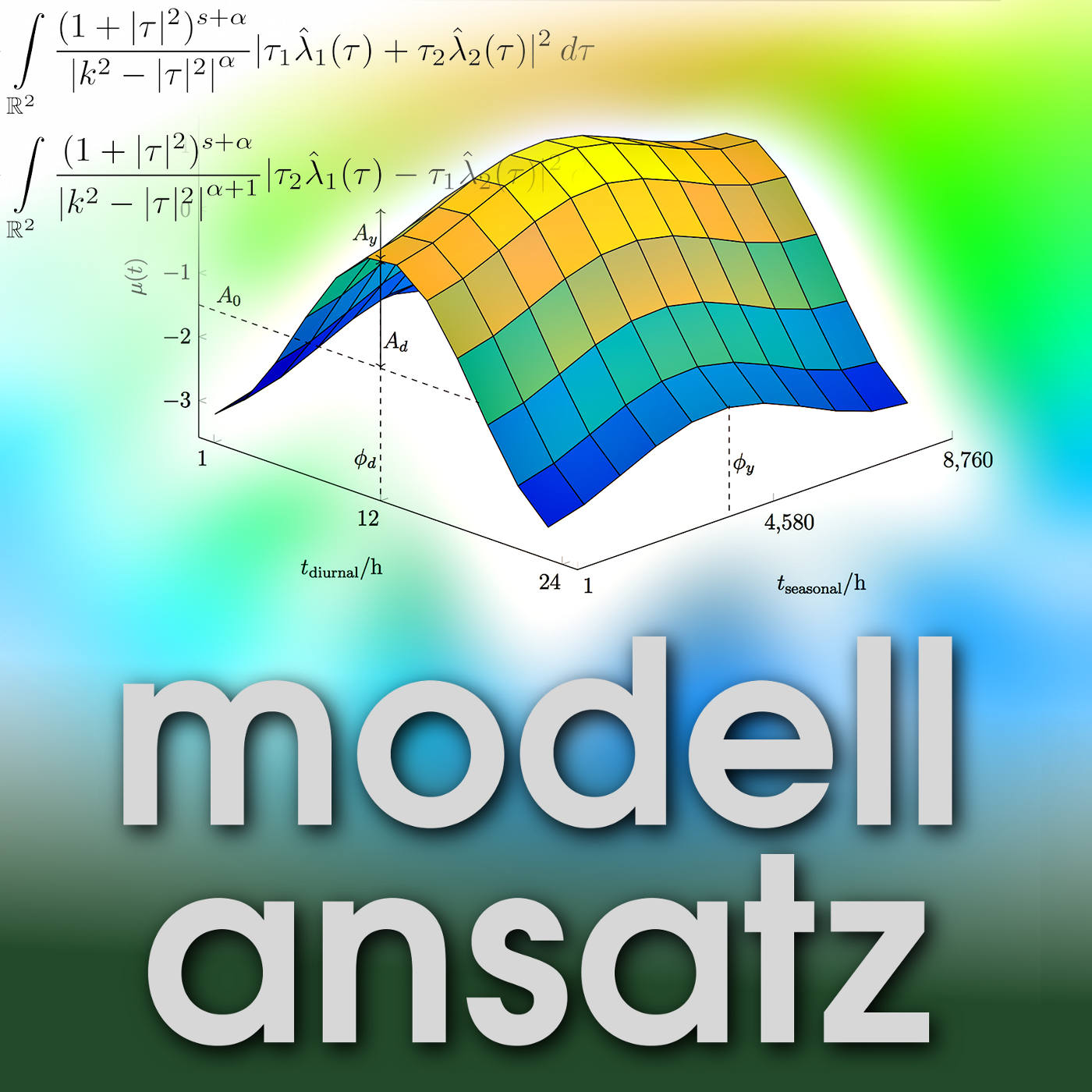

Weather Generator

Gudrun is speaking with the portuguese engineer Bruno Pousinho. He has been a student of the Energy Technologies (ENTECH) Master program. This is an international and interdisciplinary program under the label of the European Institute of Innovation and Technology (EIT) inbetween a number of European technical universities. Bruno spent his second master year at the Karlsruhe Institute of Technology (KIT). Gudrun had the role of his supervisor at KIT while he worked on his Master's thesis at the Chair of Renewable and Sustainable Energy Systems (ENS) at TUM in Garching. His direct contact person there was Franz Christange from the group of Prof. Thomas Hamacher. Renewable energy systems are a growing part of the energy mix. In Germany between 1990 and 2016 it grew from 4168 GW to 104024 GW. This corresponds to an annual power consumption share of 3.4% and 31.7%, respectively. But in the related research this means a crucial shift. The conventional centralized synchronous machine dominated models have to be exchanged for decentralized power electronic dominated networks - so-called microgrids. This needs collaboration of mechanical and electrical engineers. The interdisciplinary group at TUM has the goal to work on modeling future microgrids in order to easily configure and simulate them. One additional factor is that for most renewable energy systems it is necessary to have the right weather conditions. Moreover, there is always the problem of reliability. Especially for Photovoltaics (PV) and wind turbines Weather phenomena as solar irradiation, air temperature and wind speed have to be known in advance in order to plan for these types of systems. There are two fundamentally different approaches to model weather data. Firstly the numerical weather and climate models, which provide the weather forecast for the next days and years. Secondly, so-called weather generators. The numerical models are very complex and have to run on the largest computer systems available. For that in order to have a simple enough model for planning the Renewable energy resources (RER) at a certain place weather generators are used. They produce synthetic weather data on the basis of the weather conditions in the past. They do not predict/forecast the values of a specific weather phenomenon for a specific time but provides random simulations whose outputs show the same or very similar distributional properties as the measured weather data in the past. The group in Garching wanted to have a time dynamic analytical model. The model is time continuous which grant it the ability of having any time sampling interval. This means it wanted to have a system of equations for the generation of synthetic weather data with as few as possible parameters. When Bruno started his work, there existed a model for Garching (developped by Franz Christange) with about 60 parameters. The aim of Bruno's work was to reduce the number of parameters and to show that the general concept can be used worldwide, i.e. it can adapt to different weather data in different climate zones. In the thesis the tested points range from 33º South to 40º North. In the synthesis of the weather generator the crucial tool is to use stochastic relations. Mostly the standard normal distribution is applied and shaped for the rate of change and corelation between RER. In particular this means that it describes the fundamental behavior of weather (mean, standard deviation, time- and cross-correlation) and introduces them into white noise in an analytical way. This idea was first introduced for crop estimation by Richardson in 1985. Time-dependence works on different time scales - through days and through seasons, e.g.. In the Analysis it is then necessary to parametrize the measured weather data and to provide a parameter set to the weather model. Bruno started his Master course in Lisbon at Instituto Superior tecnico (IST). In his second year he changed to KIT in Karlsruhe and put his focus on Energy systems. In his thesis he uses a lot of mathematics which he learned during his Bachelor education and had to recall and refresh. The results of the project are published in the open source model 'solfons' in Github, which uses Python and was developed in MATLAB. References F. Christange & T. Hamacher: Analytical Modeling Concept for Weather Phenomena as Renewable Energy Resources, in IEEE International Conference on Renewable Energy Research and Applications (ICRERA), 2016. doi: 10.1109/ICRERA.2016.7884551 P. Ailliot, D. Allard, P. Naveau, C. D. Beaulieu, R. Cedex: Stochastic weather generators, an overview of weather type models, Journal de la Société Française de Statistique, Vol. 156, No 1, pp. 1-14, 2015. C.L. Wiegand, A.J. Richardson: Leaf area, light interception, and yield estimates from spectral components analysis, Agron. J., 76, 543, 1984. solfons: Artificial wheater data for energy system modeling, Software at GitHub. Podcasts S. Seier, T. Alexandrin: Blindstrom - Der En

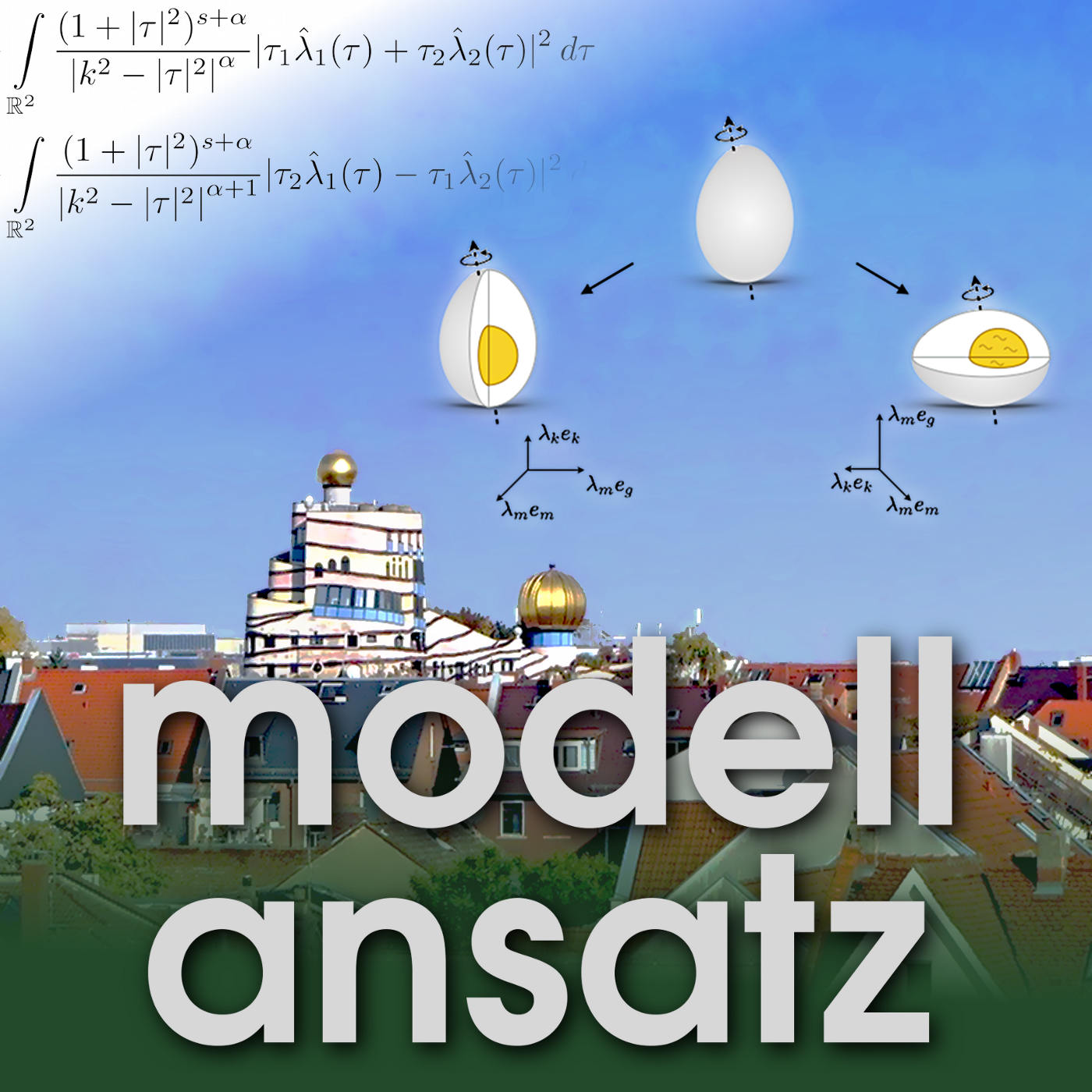

Dämpfung viskoser Flüssigkeiten

Gudrun und Karoline Disser trafen sich am Rand eines Seminarvortrages an der TU in Darmstadt. Dort arbeitet Karoline am internationalen Graduiertenkolleg Mathematical Fluid Dynamics als Postdoc. Der Forschungsgegenstand, über den die beiden schließlich ins Gespräch kamen, ist die Bewegung starrer Körper, in denen eine Flüssigkeit eingeschlossen ist. Ein recht anschauliches Beispiel hierfür ist die Frage, wie man herausfinden kann, ob ein Ei schon gekocht oder noch roh ist. Wenn man es auf einer glatten Fläche aufrecht stehend rotieren lässt, bleibt das gekochte Ei fast aufrecht, während sich das rohe Ei schnell hinlegt und weiter um eine kurze Achse rotiert. Die Flüssigkeit verhindert die Präzession um die lange Achse. Allgemeiner ausgedrückt untersucht Karoline Trägheitsbewegungen gekoppelter Systeme, die aus einem starren Körper bestehen mit einem Hohlraum, der vollständig mit einer viskosen Flüssigkeit gefüllt ist. Sie zeigt mathematisch, dass bei beliebigen Anfangsdaten mit endlicher kinetischer Energie, jede korrespondierende schwache Lösung im Laufe der Zeit in eine gleichmäßige Rotation übergeht. Darüber hinaus ist diese Rotation nur um die Trägheitsachse mit dem größeren Trägheitsmoment stabil. Anschaulich ist das bei einem symmetrischen Körper oft die geometrisch kürzeste Achse. Unabhängig von der Geometrie und den Parametern zeigt dies, dass - wenn das System genug Zeit hat - das Vorhandensein von Flüssigkeit Präzession des Körpers verhindert. Die theoretischen Untersuchungen wurden durch numerische Simulationen begleitet. In diesem Video zu einem Experiement eines mit Flüssigkeit gefülltem starrem Körpers wird der Effekt illustriert, dass wenn er zuerst um die lange Achse angedreht wird, in der freien Bewegung schnell zu einer Rotation um eine kurze Achse findet. Interessant ist auch der Fall, wenn sich das flüssige Material nicht ähnlich wie Wasser verhält, sondern ein sogenanntes Nichtnewtonsches Fluid ist. Hierfür gibt es viele Anwendungen - zum Beispiel, wenn auch elastische Verformungen möglich sind. Das heißt konkret: In den partiellen Differentialgleichungen treten noch mehr nichtlineare Terme auf als im Fall der Navier-Stokes Gleichungen für wasserähnliche Stoffe. Für diese Terme müssen neue Techniken entwickelt werden. Literatur und weiterführende Informationen K. Disser: Strong Solutions for the Interaction of a Rigid Body and a Viscoelastic Fluid, Journal of Mathematical Fluid Mechanics 15(4), 2012. K. Disser e.a.: L^p -theory for strong solutions to fluid-rigid body interaction in Newtonian and generalized Newtonian fluids, Transactions of the American Mathematical Society 365(3), 2013. K. Disser: Asymptotic behaviour of a rigid body with a cavity filled by a viscous liquid, arXiv:1405.6221, 2014. K. Disser e.a.: Inertial Motions of a Rigid Body with a Cavity Filled with a Viscous Liquid, Archive for Rational Mechanics and Analysis 221(1):1-40, 2016. Podcasts H. Wilson: Viscoelastic Fluids, Gespräch mit G. Thäter im Modellansatz Podcast, Folge 92, Fakultät für Mathematik, Karlsruher Institut für Technologie (KIT), 2016. M. Steinhauer: Reguläre Strömungen, Gespräch mit G. Thäter im Modellansatz Podcast, Folge 113, Fakultät für Mathematik, Karlsruher Institut für Technologie (KIT), 2016.

Advanced Mathematics

Gudrun Thäter and Jonathan Rollin talk about their plans for the course Advanced Mathematics (taught in English) for mechanical engineers at the Karlsruhe Institute of Technology (KIT). The topics of their conversation are relevant in the mathematical education for engineers in general (though the structure of courses differs between universities). They discuss how to embrace university mathematics, how to study, what is the structure of the educational program and what topics will be covered in the first semester in Karlsruhe. For students starting an engineering study course it is clear, that a mathematical education will be an important part. Nevertheless, most students are not aware that their experiences with mathematics at school will not match well with the mathematics at university. This is true in many ways. Mathematics is much more than calculations. As the mathematical models become more involved, more theoretical knowledge is needed in order to learn how and why the calculations work. In particular the connections among basic ideas become more and more important to see why certain rules are valid. Very often this knowledge also is essential since the rules need to be adapted for different settings. In their everyday work, engineers combine the use of well-established procedures with the ability to come up with solutions to yet unsolved problems. In our mathematics education, we try to support that skills insofar as we train certain calculations with the aim that they become routine for the future engineers. But we also show the ideas and ways how mathematicians came up with these ideas and how they are applied again and again at different levels of abstraction. This shall help the students to become creative in their engineering career. Moreover seeing how the calculation procedures are derived often helps to remember them. So it makes a lot of sense to learn about proofs behind calculations, even if we usually do not ask to repeat proofs during the written exam at the end of the semester. The course is structured as 2 lectures, 1 problem class and 1 tutorial per week. Moreover there is a homework sheet every week. All of them play their own role in helping students to make progress in mathematics. The lecture is the place to see new material and to learn about examples, connections and motivations. In this course there are lecture notes which cover most topics of the lecture (and on top of that there are a lot of books out there!). So the lecture is the place where students follow the main ideas and take these ideas to work with the written notes of the lecture later on. The theory taught in the lecture becomes more alive in the problem classes and tutorials. In the problem classes students see how the theory is applied to solve problems and exercises. But most importantly, students must solve problems on their own, with the help of the material from the lecture. Only in this way they learn how to use the theory. Very often the problems seem quite hard in the sense that it is not clear how to start or proceed. This is due to the fact that students are still learning to translate the information from the lecture to a net of knowledge they build for themselves. In the tutorial the tutor and the fellow students work together to find first steps onto a ladder to solving problems on the homework. Gudrun and Jonathan love mathematics. But from their own experience they can understand why some of the students fear mathematics and expect it to be too difficult to master. They have the following tips: just take one step after the other, and do not give up too early discuss problems, questions and topics of the lecture with fellow students - talking about mathematics helps to understand it teach fellow students about things you understand - you will be more confident with your arguments, or find some gaps to fix take time to think about mathematics and the homework problems sit down after the lecture, and repeat the arguments and ideas in your own words in order to make them your own use the problem classes and tutorials to ask questions In the lecture course, students see the basic concepts of different mathematical fields. Namely, it covers calculus, linear algebra, numerics and stochastics. Results from all these fields will help them as engineers to calculate as well as to invent. There is no standard or best way to organize the topics since there is a network of connections inbetween results and a lot of different ways to end up with models and calculation procedures. In the course in Karlsruhe in the first semester we mainly focus on calculus and touch the following subjects: Numbers Methods of proof Complex numbers Sequences and convergence Functions and continuity Series Differential calculus of one real variable Integral calculus Numerical integration Elementary differential equations All of these topics have applications and typical problems which will be trained in the problem class. But moreo

Lilium

Gudrun traf Patrick Nathen im April 2017 neben dem Flugfeld in Oberpfaffenhofen. Vielen ist dieser Ort ein Begriff, weil das Deutsche Zentrum für Luft- und Raumfahrt dort seinen Sitz hat. Auch das von Patrick mitgegründete Startup Lilium Aviation hat dort seine Büros. Die Vision von Lillium ist es ein Anbieter wie Uber zu werden - allerdings für den Luftraum. Dafür wird ein senkrecht startender Jet entwickelt, der mit Elektromotoren relativ leise und mit wenig Platzbedarf beim Starten und Landen Personen in Ballungsgebieten schnell von Punkt zu Punkt transportiert: Mobility on demand. Die Fluggeräte starten senkrecht wie Hubschrauber und auf Reisehöhe werden sie zum Jet. Diesem Traum waren sie zum Zeitpunkt unseres Gespräches schon sehr nahe: Der Prototyp flog und befand sich im Zulassungsverfahren der Europäischen Agentur für Flugsicherheit (EASA). Neben den Fluggeräten muss auch die Infrastruktur entwickelt werden. Einerseits lassen sich die Helipads als Landeplätze in Metropolregionen nutzen, andererseits braucht es auch die Software, die Nutzer, Geräte und Landemöglichkeiten miteinander verbinden wird. In der Zukunft soll es sogar möglich werden, auf Piloten ganz zu verzichten, weil die Geräte vom Boden ferngesteuert werden. Statt - wie Gudrun an dem Morgen - über eine Stunde aus der Innenstadt von München nach Oberpfaffenhofen zu fahren, würde sich die Reisezeit für diese Strecke auf etwa 5 min verkürzen. Das klingt zu schön, um wahr zu werden - diese Idee müssen Menschen erst für möglich halten bevor es Normalität werden kann. Die Geschichte von Lilium begann 2013 in der WG von vier Ingenieurstudenten - Daniel Wiegand, Matthias Meiner, Patrick Nathen and Sebastian Born - mit einer "spinnerten" Idee. Alle haben an der Fakultät für Maschinenwesen der TU München studiert oder promoviert. Sehr schnell hatten sie einen ersten großen Investor gefunden, sind auf ein Team von 40 Leuten gewachsen (Stand April - inzwischen sind es schon 70) und nun wird der Zweisitzer im 1:1 Modell getestet. Das Folgeprodukt soll schließlich auch eine bemannte Zertifizierung bekommen und eine effektive Problemlösung für die Allgemeinheit werden. Das betrifft dicht besiedelte Metropolregionen genauso wie ländliche Regionen mit wenig ÖPNV-Optionen. Dafür haben sie in der zweiten Finanzierungsrunde 90 Millionen Euro Kapital eingeworben. Beim Starten und Landen gibt es auch in der von Lilium entwickelten Technologie Lärm wegen der Propeller, die für den Auftrieb sorgen. Da aber möglichst wenig Lärmentwicklung eine wichtige Voraussetzung dafür ist, dass sich die Technologie möglichst weit durchsetzen wird, wurde nach neuen Ideen zur Lärmvermeidung gesucht. Jetzt hat der Propeller eine Hülle. Dadurch wird weniger Schall abgestrahlt und die Effizienz erhöht. Im Reiseflug trägt sich der Flieger selbst. Um so einfach wie möglich zu bauen, muss man aber mit dem für Starten und Landen nötigen großen Motor irgendwie leben. In der Konstruktion gingen sie approximativ vor. Als ersten Schritt kann man die nötige Spannweite und Flügelfläche zusammen mit der Fluggeschwindigkeit durch vorläufige aerodynamische Faustformeln schätzen. Die zu erreichenden Widerstands- und Auftriebsbeiwerte legen schließlich auch das Profil der Flügel mehr oder weniger fest. Und die statische Stabilität kann mit Hilfe von Vorerfahrungen mit klassischen Flugobjekten gesichert werden. Zum Beispiel durch eine elliptische Auftriebsverteilung, die widerstandsarm ist, weil sie Turbulenzen an den falschen Stellen vermeidet. Für genauere Untersuchungen mussten diese Ideen und die gesamte Geometrie aber zunächst am Computer simuliert werden. Hier gibt es Berührungspunkte zur Arbeit an Gudruns Lehrstuhl, denn die genaue Strömungsrechnung erfordert moderne Softwarepakete auf dem Gebiet. Hinzu kommt, dass Batterien immer kritisch für die Sicherheit der Geräte sind. Sie heizen sich in der Start- und Landephase auf und das Kühlungskonzept muss wirklich clever sein. Die Anforderung ist, dass das Fluggerät im Winter in Schweden und im Sommer in Dubai funktioniert. Außerdem muss sichergestellt werden, dass eine brennende Batterie nicht zur Zerstörung des ganzen Gerätes führt. Schließlich sind auch Ergonomie und Raumluftkomfort keine unwichtigen Themen. Zum Beispiel müssen Böen durch den Flugcomputer abgefangen werden und hierfür ist Redundanz in den Triebwerken nötig. Literatur und weiterführende Informationen K. Weltner: Flugphysik. Physik des Fliegens, Strömungsphysik, Raketen, Satelliten. Books on Demand, Norderstedt, ISBN 978-3-7412-1472-1. W.-H. Hucho: Aerodynamik der stumpfen Körper. Physikalische Grundlagen und Anwendungen in der Praxis. Vieweg + Teubner, Wiesbaden 2011, ISBN 978-3-8348-1462-3. P. Nathen e.a.: An extension of the Lattice-Boltzmann Method for simulating turbulent flows around rotating geometries of arbitrary shape, Conference: 21st AIAA Computational Fluid Dynamics Conference 2013. P. Nathen, D. Gaudlitz, N. Adams:Towards wall-adaption of turbulence models wit

Lokale Turbulenzen

Nikki Vercauteren erforscht an der Freien Universität Berlin die mehrskalige Analyse von atmosphärischen Prozessen und traf sich mit Sebastian Ritterbusch in der Urania Berlin, um über ihre Forschung und ihre Experimente auf Gletschern zu sprechen. Zum Zeitpunkt der Aufnahme fand in der Urania das Banff Mountain Film Festival, des Banff Centre for Arts and Creativity aus Kanada, statt. Auf dem Campus des Banff Centre befindet sich auch die Banff International Research Station (BIRS), ein Forschungsinstitut und Tagungsort nach Vorbild des Mathematischen Forschungsinstituts Oberwolfach, das sich der mathematischen Forschung und internationalen Zusammenarbeit verschrieben hat, und welches Nikki Vercauteren Anfang des Jahres zu einem Workshop besuchen konnte. Das Forschungsgebiet der Meteorologie umfasst viele Phänomene, von denen einige durch Fluiddynamik beschrieben werden können. Dabei geht es um eine große Menge von Skalen, von der globalen Perspektive, über kontinentale Skalen zur Mesoskala im Wetterbericht und der Mikroskala zu lokalen Phänomenen. Die Skalen bilden sich auch in den Berechnungsmodellen für die Wettervorhersage wieder. Das Europäische Zentrum für mittelfristige Wettervorhersage (EZMW) betrachtet die globale Perspektive mit Hilfe von Ensemblevorhersagen. Von dort verfeinert das aus dem lokalen Modell des Deutschen Wetterdienstes (DWD) entstandene COSMO Modell die Vorhersage auf die europäische und schließlich nationale Ebenen. Hier geht es um die sehr lokale Analyse von Windgeschwindigkeiten, die bis zu 20mal pro Sekunde gemessen werden und damit die Analyse von lokalen Turbulenzen bis zum natürlichem Infraschall ermöglichen. Die Erfassung erfolgt mit Ultraschallanemometer bzw. ultrasonic anemometers, wo bei manchen Typen durch die Erfassung des Doppler-Effekts bewegter Staubteilchen die Bewegungsgeschwindigkeit der Luft durch mehrere Sensoren räumlich bestimmt wird. Teilweise werden auch Laser-Anemometer eingesetzt. Im Rahmen ihrer Promotion in Umweltwissenschaften an der École Polytechnique Fédérale de Lausanne (EPFL) bekam Sie die Gelegenheit selbst vor Ort eine Messanlage auf einem Gletscher mit aufzubauen und in Stand zu halten. Der See- und Landwind sind typische Phänomene in der mikroskaligen Meteorologie, die Nikki Vercauteren zu ihrer Promotion am Genfersee zur Analyse von turbulenten Strömungen von Wasserdampf untersucht hat. Mit mehreren Laser-Doppler-Anemometern in einer Gitter-Aufstellung konnte sie so die Parametrisierung einer Large Eddy Simulation dadurch testen, in dem sie die im Modell angesetzte Energie in den kleinen Skalen mit den tatsächlichen Messungen vergleichen konnte. Kernpunkt der Betrachtung ist dabei das Problem des Turbulenzmodells: Als Verwirbelung in allen Skalen mit teilweise chaotischem Verhalten ist sie nicht vorhersagbar und kaum vollständig mathematisch beschreibbar. Sie spielt aber wegen der wichtigen Eigenschaften der Vermischung und Energietransfers eine elementare Rolle im Gesamtsystem. Glücklicherweise haben Turbulenzen beobachtete statistische und gemittelte Eigenschaften, die modelliert und damit im gewissen Rahmen und diesem Sinne mit Hilfe verschiedener Modelle durch identifizierte Parameter simuliert werden können. Besonderes Augenmerk liegt dabei auf der Betrachtung der Grenzschicht über dem Erdboden, die zum einen durch die Sonneneinstrahlung besonders durch die Aufwärmung und Abkühlung der Erdoberfläche beinflusst wird und gleichzeitig den Bereich beschreibt, wo das bewegte Fluid Luft auf die stehenden Erde reagiert. Eine meteorologische Eigenschaft der unteren Grenzschicht ist das theoretische logarithmische Windprofil, das aber bei Sonneneinstrahlung oder Nachts durch Verformung der Turbulenzen Korrekturterme erforderlich macht. In einer Temperaturinversion wird die Grenzschicht stabiler und es bildet sich weniger Turbulenz aus, wodurch sich Schadstoffe auch weniger verteilen können. In diesen Wetterlagen kann sich durch den fehlenden Luftaustausch im Stadtgebiet leichter Smog bilden. Entgegen der Theorie kann es interessanterweise trotz stabiler Schichtung zu Turbulenzen kommen: Ein Grund dafür sind Erhebungen und Senken des Bodens, die Luftpakete beeinflussen und damit lokale Turbulenzen erzeugen können. Eine besondere Fragestellung ist hier die Frage nach der Intermittenz, wann ein stabiles dynamisches System chaotisch werden kann und umgekehrt. Ein anschauliches Beispiel von Intermittenz ist das Doppelpendel, das von einem sehr stabilen Verhalten plötzlich in chaotisches Verhalten umschwenken kann und umgekehrt: Trajektorie eines DoppelpendelsCC-BY-SA 100 Miezekatzen Leider ist bisher die Intermittenz in der Wettervorhersage nicht alleine aus der Theorie zu berechnen, jedoch kann man die Richardson-Zahl bestimmen, die den Temperaturgradienten in Verhältnis zur Windscherung stellt. Dieses Verhältnis kann man auch als Verhältnis der Energieverteilung zwischen kinetischer Bewegungsenergie und potentieller Wärmeenergie sehen und daraus Sch

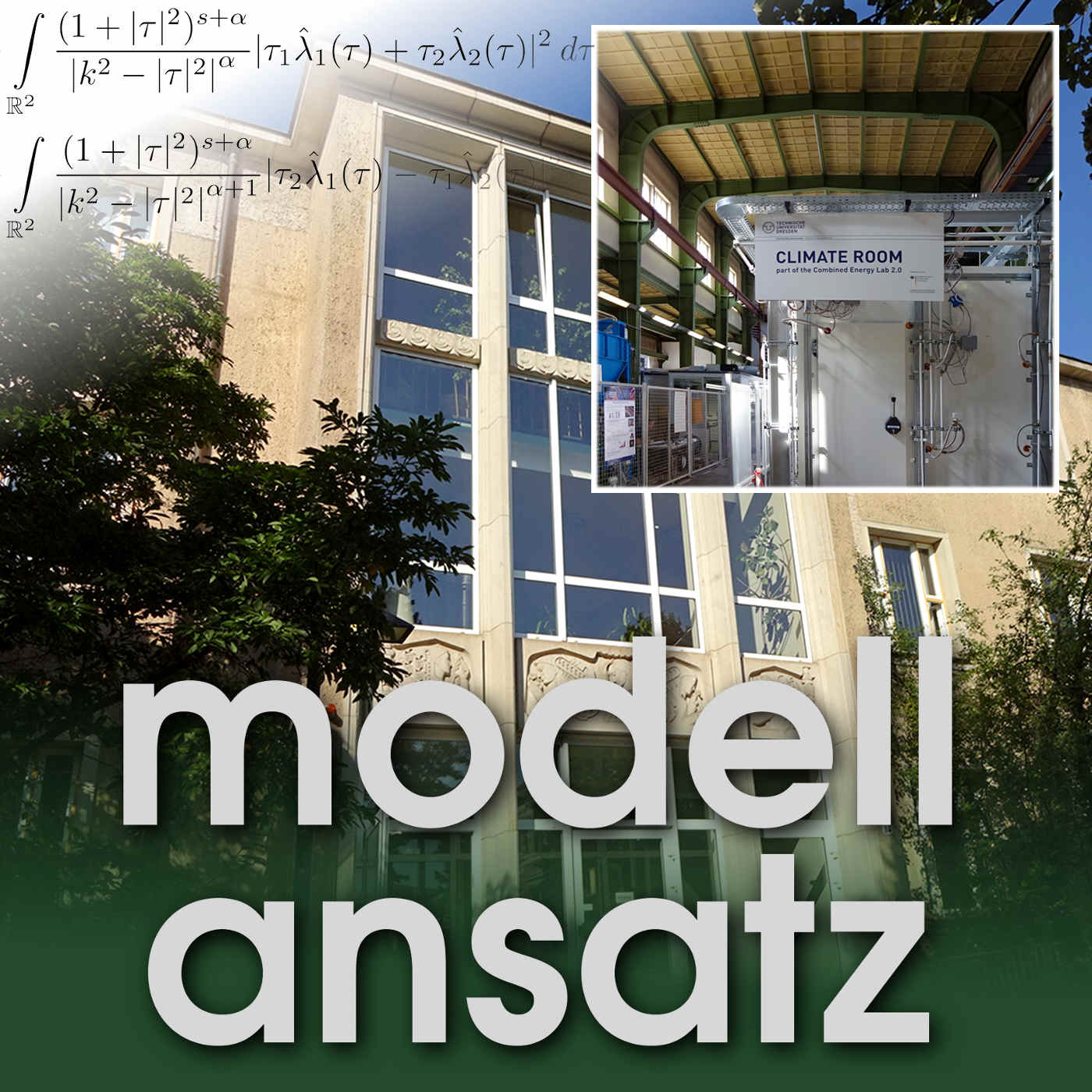

Raumklima

Gudrun hat sich auf den Weg an ihre Alma Mater nach Dresden gemacht, um mit einem ehemaligen Kommilitonen zu sprechen, der dort als Diplom-Mathematiker schon seit 30 Jahren unter Ingenieuren Strömungssimulation betreibt. Markus Rösler hat von 1982-87 an der TU Dresden Mathematik studiert. Im Industriepraktikum im Rahmen des Studiums kam er in Berührung mit der damaligen Sektion Energieumwandlung und stieg dort für drei Monate in die Strömungssimulation ein. Nach dem Studium wechselte er dauerhaft auf eine Stelle im Institut für Srömungsmechanik in der damaligen Sektion Energieumwandlung, promovierte zum Dr.-Ing. und arbeitet seitdem neben der Lehre für Maschinenbauer an Projekten mit, die Strömungen in Gebäuden und in Räumen besser vorhersagen und analysieren zu können. Inzwischen an der Fakultät Maschinenwesen, Professur für Gebäudeenergietechnik und Wärmeversorgung. Gudrun und Markus teilen die Faszination für Strömungen, die fast schon philosophisch tief greift sowohl in der Beschreibung der Beobachtungen als auch im Verständnis der Phänomenologie. Das Tagesgeschäft in Markus' Alltag an der TU Dresden sind die Erforschung der Wirkung von Strömung im Raum auf Energiebedarf und thermische Behaglichkeit. Das erfolgt einerseits in konkreten Projekten - andererseits aber auch in grundlegenden Überlegungen für Situationen in Typenräumen in typischen Situationen. So entstand bereits ein Katalog, in dem sich Aussagen finden lassen, wie gebaut oder umgebaut werden kann, um die Energie effektiver zu nutzen. Ein Problem in der numerischen Simulation ist, dass die Strömung in Innenräumen in der Regel eine nicht vollständig ausgebildete turbulente Strömung ist. D.h. die Modellgleichungen sind jeweils - optimistisch ausgedrückt - im Grenzfall der Gültigkeit, da es weder laminar noch wirklich voll turbulent strömt. Die geometrische Auflösung ist dabei auch ganz kritisch. In einem Plattenheizkörper muss beispielsweise die genaue Luftströmung um den Heizkörper mit all seinen Lamellen berücksichtigt werden. Außerdem die Wasserströmung im Heizkörper. Die Strömungen werden in der Arbeitsgruppe in der Regel mit einer Reynolds-Mittelung der Navier-Stokes Gleichungen gerechnet, die mit geeigneten Turbulenzmodellen gekoppelt wird. Hier ergibt sich jedoch in der Regel ein Schließungsproblem, d.h. es gibt zu wenige Gleichungen für die Zahl der Variablen. Diese Lücke wird mit gewählten Parametern, die auf Messungen beruhen, geschlossen. Alle Rechnungen sollten etwa in Echtzeit erfolgen. Dafür sind die eben genannten Methoden gut geeignet. Andererseits werden immer genauere Rechnungen nötig, die mit den bisher genutzten Mittelungen nicht möglich sind. Dafür arbeiten sich Markus und seine Kollegen in neue Methoden ein - wie z.B. Lattice Boltzmann Modelle. Aber es ist noch sehr schwierig, mit diesen neuen und genaueren Methoden die geforderten Rechengeschwindigkeiten zu erreichen. Ein konkretes Beispiel aus der aktuellen Arbeit sind Simulationen für Dialyseräume. Es geht darum, Heizung, Lüftung und Kühlung für maximale thermische Behaglichkeit auszulegen. Dafür wird die Geometrie das Raumes, der Geräte und der Personen im Computer genau nachgebildet. Die Energiewende fordert von der Forschung nachhaltige Lösungen für die Wärmeversorgung und die Elektroenergietechnik. Im Lehrstuhl werden hierfür z.B. regionale virtuelle Kraftwerke untersucht. Für Markus geht es jedoch im engeren Sinne eher um die effektive Nutzung der Energie. Konkret werden in der nächsten Zeit instationäre Szenarien für thermische Behaglichkeit untersucht. Probanden können in einem Versuchsraum dem Anheben und Absenken von Temperaturen ausgesetzt werden und die Frage beantworten: Wann wird es unbehaglich? Es ist möglich Puffer für Wärme/Kälte mit Hilfe von Technik oder dem Gebäude selbst zu füllen und so zu nutzen, wie die Erkenntnisse aus der Probandenforschung es sinnvoll erscheinen lassen. An diesen Fragestellungen ist natürlich besonders interessant, dass eine Brücke zu Gesundheit und (Arbeits-)Medizin geschlagen wird. Als Mathematiker hat Markus unter den Energietechnikern zunächst eine steile Lernkurve absolviert, aber er findet nach wie vor die Ansicht auf Probleme von zwei Seiten - mathematisch und ingenieurtechnisch - besonders hilfreich. Die von den Ingenieuren benutzen numerischen Modelle sind zwar vereinfacht - mitunter sogar stark vereinfacht - aber doch erstaunlich zutreffend und lösen tatsächlich die Probleme sehr gut. Literatur und weiterführende Informationen Video zum Klimaraum am Institut X. Yuan, M. Rösler, R. Gritzki, C. Felsmann: Lattice-Boltzmann-Methoden zur Berechnung von Raumluftströmungen, GI Gesundheitsingenieure 2017. J. Seifert, R. Gritzki, A. Perschk, M. Rösler, M. Knorr, M. Wild, C. Russ: Co-Simulation am Beispiel eines Dialyseraums, GI Gesundheitsingenieur 2017. R. Gritzki, C. Kandzia, M. Rösler, C. Felsmann: Frische Luft direkt am Arbeitsplatz – Vergleich von konventioneller und persönlicher Lüftung in Büroräumen, Bauen im Bestand,

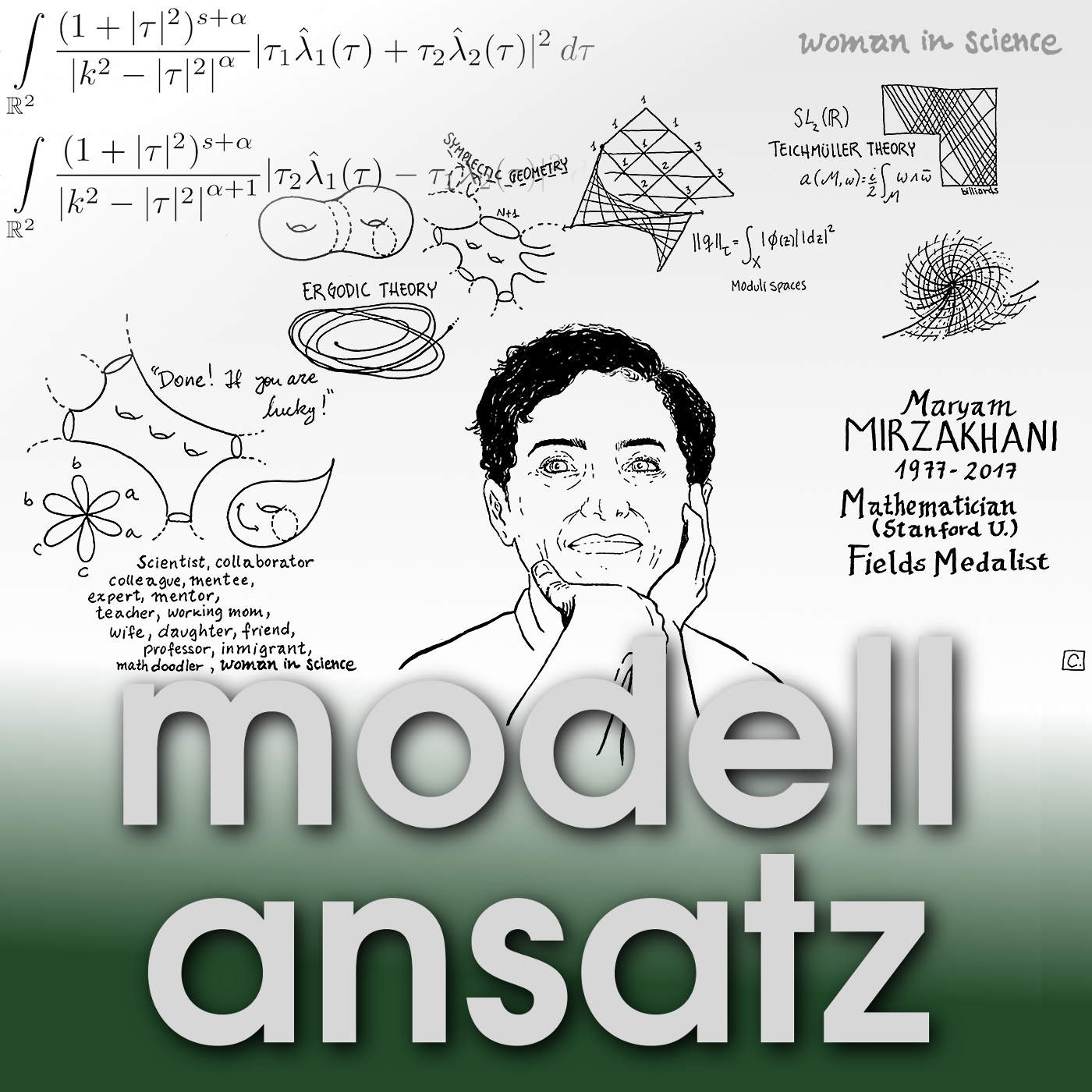

Gender und Mathematik

Gudrun Thäter hat sich an der FU Berlin zu einem Gespräch über Geschlecht und Mathematik mit Anina Mischau & Mechthild Koreuber verabredet. Anina Mischau leitet dort im Fachbereich Mathematik und Informatik die Arbeitsgruppe Gender Studies in der Mathematik. Dies ist in Deutschland die einzige derartige Stelle, die innerhalb der Mathematik angesiedelt ist. Sie hat dort vielfältige Aufgaben in Forschung und Lehre mit einem gewissen Schwerpunkt in der Ausbildung für das Lehramt. Dort hilft sie, einen Grundstein dafür zu legen, dass zukünftige Mathelehrkräfte für die Bedeutung der sozialen Kategorie Geschlecht bei der Vermittlung und beim Lernen von Mathematik sensibilisiert werden und lernen, einen gendersensiblen Mathematikunterricht zu gestalten. Auf Vorschlag von Anina Mischau hatten wir auch die zentrale Frauenbeauftragte der FU - Mechthild Koreuber - herzlich zu unserem Gespräch eingeladen. Auch sie ist studierte Mathematikerin und hat über Mathematikgeschichte promoviert. Uns alle bewegen solche Fragen wie: Warum entsprechen die Anteile von Frauen in höheren Ebenen der Mathematikfachbereiche nicht ihren Anteilen in den Eingangsstadien wie Studium oder Promotion? Liegt es auschließlich an den Eigenheiten der akademischen Laufbahn oder gibt es hierfür zudem spezifisch fachkulturelle Gründe? Was bedeutet es für die Mathematik, wenn sie ausschließlich von Männern entwickelt wird? In der wissenschaftlichen Arbeit hierzu verfolgen die zwei Gesprächspartnerinnen von Gudrun vier unterschiedliche Forschungsrichtungen: Wie stellt sich die Geschichte von Frauen in der Mathematik dar? Welche didaktischen Ansätze sind geeignet, um mehr Menschen zu Mathematik einzuladen? Was sind Exklusionsmechanismen für Frauen (und nicht in die vorherrschende Mathematiker-Norm passende andere Personen) in der Mathematik? Wie könnte eine Mathematik aussehen, die das Potential von unterschiedlicheren Menschen einbezieht? In der Geschichte der Mathematik geht es nicht nur darum, das Vergessen in und die Verdrängung von Frauen aus der eigenen Disziplingeschichte sichtbar zu machen, sondern vor allem auch um das Aufzeigen, wo und wie das Werk und Wirken von Mathematikerinnen mathematische Diskurse und damit innermathematische Entwicklungen der Disziplin beeinflusst haben. Ein Thema, an dem Mechthild Koreuber zum Beispiel intensiv forscht, ist die Schule um Emmy Noether. Wie konnte es einen so großen Kreis von Schülerinnen und Schülern geben, die bei ihr lernen wollten, trotz eigener prekären Stellensituation und damit verbunden auch (formal) wenig Reputationsgewinn für ihre Schüler und Schülerinnen. Es kann eigentlich nur die Faszination der mathematischen Ideen gewesen sein! Das Bild der Mathematik als von Männern entwickelte und betriebene - also männliche - Disziplin ist verquickt mit der Vorstellung, was von uns als Mathematik eingeordnet wird, aber auch wem wir mathematische Fähigkeiten zuschreiben. Automatisch werden innerhalb dieses Ideen- und Personennetzes Frauen bei gleichem Potential gegenüber ins Bild passenden Männern benachteiligt und ihr Potential kommt nicht so gut zur Entfaltung. Daneben feiern längst überwunden geglaubten Stereotype fröhliche Urständ, wie am 1.2. 2017 im ZEIT-Artikel Lasst Mädchen doch mit Mathe in Ruhe. Nicht ganz unschuldig am Abschied der Frauen von der Mathematik sind sicher auch unsere häufig steinzeitlichen Unterrichts-Konzepte auf der Hochschulebene, denn Mathematik ist nicht - wie angenommen - überkulturell. Wenn wir Mathematik betreiben, neue Ergebnisse gewinnen oder Mathematik vermitteln sind wir eingebunden in soziale und kulturelle Produktionszusammenhänge wie Kommunikationsprozesse, die u.a. auch durch die soziale Kategorie Geschlecht mit geprägt werden. Außerdem ist wie Mathematik publiziert und unterrichtet wird nicht wie Mathematik entsteht. Die Freude und Neugier an Mathematik wird in der Ausbildung nicht in den Vordergrund gestellt. Statt dessen ist Mathematik gerade für zukünftige Lehrkräfte oft mit negativen Gefühlen und einem eher eindimensionalen (und vielleicht auch stereotypen) Verständnis von Mathematik besetzt, was später in der eigenen schulischen Praxis unbeabsichtigt an Kindern und Jugendliche als Bild von Mathematik weitergegeben wird. Um diesen Teufelskreis aufzubrechen braucht es mehr Freiräume und auch neue Konzepte und Ansätze in der Hochschullehre. Wir Mathematiker und Mathematikerinnen sind für das Bild der Mathematik in der Gesellschaft verantwortlich. Ganz besonders in der Ausbildung für das Lehramt können wir hier starken Einfluss nehmen. Dafür müssen wir besser verstehen: Wo und wie werden Ideen ausgeschlossen, die dem engen vorherrschenden Bild von Mathematik nicht entsprechen? Wieso ist es ok, öffentlich auf Distanz zu Mathematik zu gehen (und damit zu kokettieren: In Mathe war ich immer schlecht) oder "Mathematiker als Nerd" oder halb verrückte Menschen darzustellen? Dieses Bild gehört neu gezeichnet durch allgemeinverständliches Reden über Mathematik und

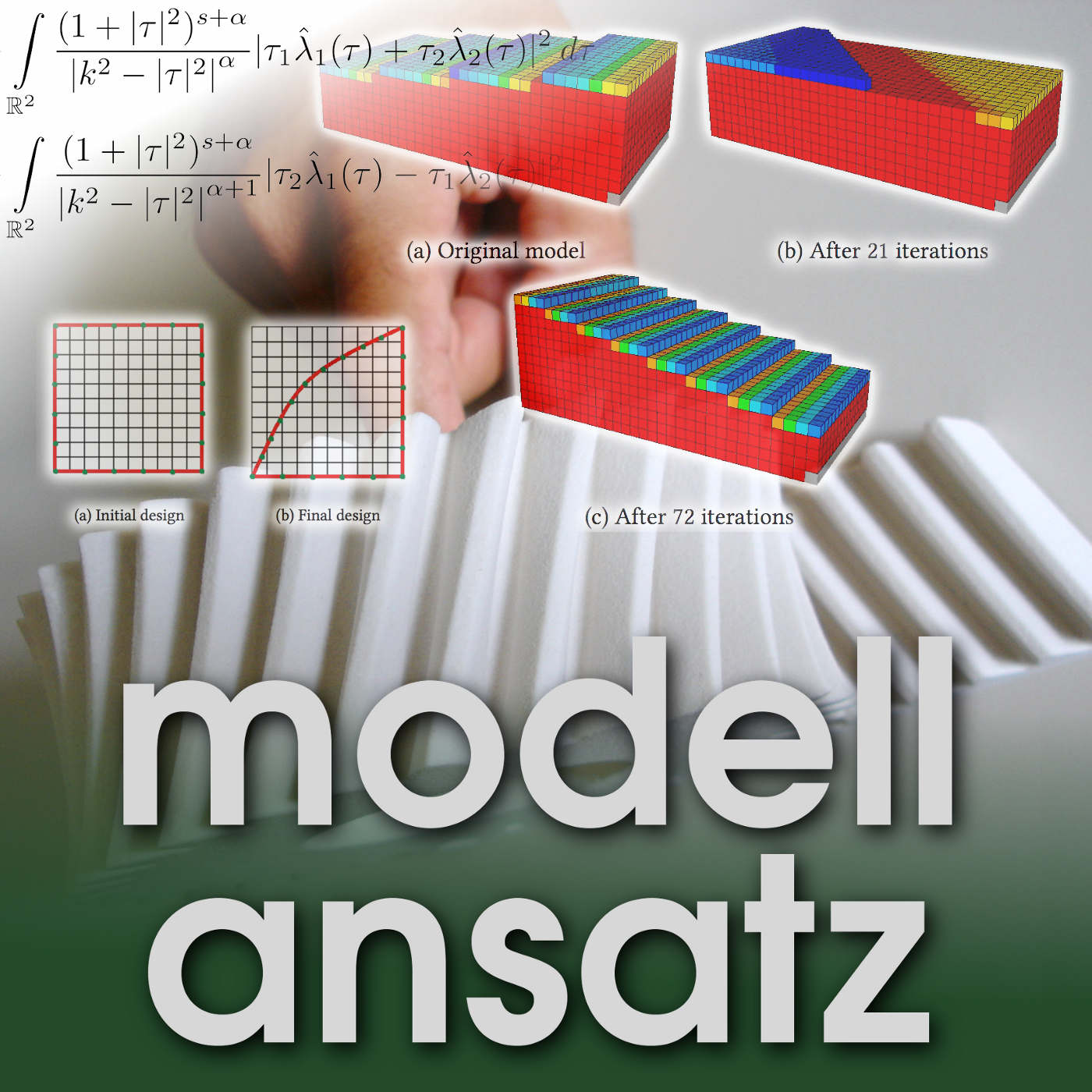

Bézier Stabwerke

Arne Rick (@Couchsofa) war schon ein häufiger, aber ungenannter Gast im Modellansatz Podcast: Als DJ war er auf den Aufnahmen von der aktuellen und früheren Gulasch-Programmiernächten im Hintergrund zu hören. Außer für Musik hat Arne auch ein großes Faible für Mathematik und Informatik und befasst sich im Zuge seiner von Prof. Marcus Aberle betreuten Bachelorarbeit zum Bauingenieurwesen an der Hochschule Karlsruhe mit Bezierkurven für Stabwerke. Stabwerke sind Modelle für Strukturen in Bauwerken und eine Lösung für ein System von Stabwerken hilft im konstruktiven Bauingenieurwesen, die Aufbauten in ihren Bemessungen und Anforderungen auszulegen und erforderliche Eigenschaften festzulegen. Die Darstellung als Stabwerke ist im Sinne eines Fachwerks eng verknüpft mit dem Prinzip von Finite Elementen, da diese in gewissen Anwendungen als Stabwerke und umgekehrt interpretiert werden können. Weiterhin können Stabwerke mit Hilfe von finite Elementen innerhalb der Stäbe genauer bestimmt bzw. verfeinert werden. Die Betrachtung des Stabwerks beginnt mit der Struktur und den Einwirkungen: Hier ist spielt das Semiprobabilistische Teilsicherheitsbeiwerte-System eine besondere Rolle, da es die möglichen Einwirkungen auf die Bauteile und damit die Gesamtanalyse probabilistisch erfassbar macht. Man unterscheidet hier nicht mehr so stark zwischen dem Bauen im Bestand, wo viele Nebenbedingungen zwar bekannt, aber die Eigenschaften der verbleibenden Bestandteile unsicher sind, und dem Aufbau eines Neubaus, wo es jeweils für die Bauingenieure gilt, die Vorgaben aus der Architektur konstruktiv, berechnend, planend und organisatorisch unter Berücksichtigung des möglichen Zeit- und finanziellen Rahmens, verfügbarer Materialien, Technik, Mitarbeiter und Bauverfahren sicher umzusetzen. Speziell in der Betrachtung der Stabwerke können die Fälle der statistischen Über- und Unterbestimmung des Bauwerks auftreten, wo Überbestimmung grundsätzlich zu Verformungen führt, eine Unterbestimmung andererseits kein funktionsfähiges Bauwerk darstellt. Weiterhin ändert jede Anpassung von beispielsweise der Tragfähigkeit eines Bauteils auch gleich zur Änderung des gesamten Stabwerks, da ein stärkerer Stab oft auch mehr wiegt und sich eventuell auch weniger verformt. Außerdem ziehen in einem statisch überbestimmten System die steiferen Elemente die Lasten an. So ist es häufig, eher unintuitiv, von Vorteil Bauteile zu schwächen um eine Lastumlagerung zu erzwingen. Dies führt in der Auslegung oft zu einem iterativen Prozess. Die Darstellung eines Stabes oder Balkens ist dabei eine Reduzierung der Wirklichkeit auf ein lokal ein-dimensionales Problem, wobei die weiteren Einwirkungen aus der Umgebung durch Querschnittswerte abgebildet werden. Die Voute ist ein dabei oft auftretendes konstruktives Element in der baulichen Umsetzung eines Tragwerks, die in der Verbindung von Stäben eine biegesteife Ecke bewirkt und in vielen Gebäuden wie beispielsweise dem ZKM oder der Hochschule für Gestaltung in Karlsruhe zu sehen sind. In der Modellierung der einzelnen Stäbe können verschiedene Ansätze zum Tragen kommen. Ein Standardmodell ist der prismatische Bernoulli Biegestab, das mit Differentialgleichungen beschrieben und allgemein gelöst werden kann. Daraus entstehen Tabellenwerke, die eine Auslegung mit Hilfe dieses Modell ermöglichen, ohne weitere Differentialgleichungen lösen zu müssen. Eine häufige Vereinfachung ist die Reduzierung des Problems auf zwei-dimensionale planare Stabwerke, die in den meissten Anwendungsfällen die relevanten Anforderungen darstellen können. Die Stäbe in einem Stabwerk können nun unterschiedlich miteinander verbunden werden: Eine Möglichkeit ist hier ein Gelenk, oder in verschiedene Richtungen und Dimension festlegte oder freie Lager, also Festlager oder Loslager zwischen Stäben oder einem Stab und dem Boden. Je nach Wahl der Verbindung entstehen in diesem Punkt eine unterschiedliche Anzahl von Freiheitsgraden. Für die praktische Berechnung werden Lager oft auch verallgemeinert, in dem die Verbindung über eine Feder modelliert wird: Hier haben ideale Loslager eine Federkonstante von 0, während die Federkonstante von idealen Festlagern gegen unendlich geht. Mit allen Werten dazwischen können dann reelle Lager besser beschrieben werden. In vereinfachter Form führt die Berechnung eines Stabwerks mit idealisierten unbiegbaren Balken mit den Endpunkten der Balken als Variablen und den Verknüpfung der Balken als Gleichungen direkt auf ein relativ einfaches lineares Gleichungssystem. Da sich in Realität alle Balken unter Last merklich verbiegen (es sei denn, sie sind vollkommen überdimensioniert), müssen sie grundsätzlich mit Steifigkeit modelliert werden, um belastbare Ergebnisse zu erhalten. Aber auch im erweiterten Modell wird der Stab durch eine Matrix linear beschrieben, nur dass hier auch die Last eine Rolle spielt und über das Elastizitätsmodul, Fläche und Trägheitsmoment die Verbiegungen abbilden kann. So ergibt das erweiterte Mod

Mikroökonomik

Ein Gespräch mit Oliver Beige über dynamische Prozesse in der Mikroökonomik: Über Einfluss, Ideenpropagation und Nachbarschaftseffekte. Oliver Beige und Gudrun Thäter haben sich online über die große gemeinsame Schnittmenge im Musikgeschmack gefunden. Obwohl Oliver in Berlin lebt und Gudrun in Karlsruhe ist es schon vorgekommen, dass sie im gleichen Konzert waren ohne das rechtzeitig zu bemerken, weil sie sich persönlich noch nicht kannten. Im vergangenen Jahr fand Gudrun dann interessante Überlegungen zur aktuellen Anwendbarkeit der Ideen und Modelle von Malthus, die Oliver veröffentlicht hatte. Diese erwiesen sich als spannende Lektüre für die Studierenden der Modellbildungsvorlesung, die Gudrun gerade hielt. Damit war der Plan geboren, dass man sich nicht nur unbedingt einmal persönlich kennenlernen müsste, sondern bei nächster Gelegenheit auch für den Podcast einmal unterhalten sollte. Diese Gelegenheit bot sich im Juli 2017 nach einem Freiluftkonzert in der Kulturbrauerei in Berlin. Oliver ist Ökonom. Er hat 1993 in Karlsruhe sein Diplom in Wirtschaftsingenieurwesen erworben und sich anschließend in den Staaten umgesehen. Dort hat er 1997 einen Master of Business Administration (University of Illinois) abgeschlossen und sich schließlich im Rahmen seiner Promotion an der UC Berkeley mit der mathematischen Modellierung von Ideenpropagation und Entscheidungsprozessen in Netzwerken beschäftigt. Er hat dabei auch zwei Wellen von Innovation im Silicon Valley hautnah miterlebt. Was so einfach und grundlegend klingt ist tatsächlich eine sehr schwierig zu beantwortende Frage: Wie beeinflussen sich Mitglieder in einer Gruppe gegenseitig beim Finden von Entscheidungen? Während Soziologen gerne über gruppendynmische Prozesse diskutieren, arbeiten Ökonomen traditionell unter der vereinfachten Annahme, dass Entscheidungen als unabhängig voneinander getroffen werden - gestützt auf einer rein rationalen, isolierten Nutzenkalkulation. Erst seit Kurzem wird diese Annahme in der Ökonmie durch neue Modelle in Frage gestellt. Was jedoch modellhaft einen Zugang zum dynamischen Entscheidungsprozess in einer Gruppe verschaffen kann - in dem natürlich ganz viel Rückkopplung eingebaut werden muss - sind neuronale Netze - z.B. die Boltzmann-Maschine. Diese hatte Oliver in Karlsruhe kennen- und schätzen gelernt. Sie bilden ein stochastisches Feedback-Netzwerk, in dem man auch untersuchen kann, wie man zu einem Equilibrium kommen kann. Wie läuft denn so eine kollektive Entscheidung ab? Vorab hat jede/r in der Gruppe Präferenz - z.B. für einen bestimmten Film, den er oder sie gern in Begleitung anderer in der Gruppe sehen würde. Darüber wird gesprochen und schließlich teilt sich die Gruppe auf in Untergruppen, die im Kino den gleichen Film sehen. Im Gespräch werden die Präferenzen der anderen jeweils gewichtet in die eigene Entscheidung einfließen. Mathematisch wird das ausgedrückt in einer Nutzenfunktion, deren Wert maximiert wird. In der evolutionären Spieltheorie kann dieses dann als ein stochastischer Prozess modelliert werden, der mittels einer Potentialfunktion die Meinungsbildung der Gruppe als Equilibriumspfad darstellt. Von einem mehr abstrakten Level stellen sich auch die Fragen an ein so gewonnenes Equilibrium: a) Sind die Entscheidungen für die Gruppe die besten? b) Inwieweit beeinflusst die Struktur des sozialen Netzwerkes die Gruppenentscheidung? c) Kann die Gruppendynamik dazu führen, dass einzelne Mitglieder entgegen ihrer Präferenzen entscheiden (und damit das Axiom der offenbarten Präferenzen verletzen)? Zur Darstellung dieser Prozesse wandelte Oliver den traditionellen Entscheidungsbaum unter Ausnutzung der Markow-Eigenschaft in einen Entschediungsgraphen um. Dies war damals ein komplett neuer Ansatz und hat sich auch im großen Maßstab bis heute nicht durchgesetzt. Neu an der Arbeit war auch, dass zum ersten Mal im Zusammenhang der Netzwerkeffekte die Struktur des Netzwerkes betrachtet wurde. In der ursprünglichen Konzeption in der Arbeit von Michael Katz und Carl Shapiro wurde die Heterogenität des Netzwerkes noch explizit ausgeschlossen. Wie wichtig Nachbarschaftseffekte sind, weiß man in der Innovationsökonomik aber schon seit Zvi Griliches die schrittweise Verbreitung des ertragreicheren Hybridmaises in den USA über Mundpropaganda erforscht hatte. Diese Form der Ideenpropagation ist auch ein wichtiger Baustein in Jared Diamonds "Guns, Germs, & Steel" (das den Pulitzerpreis gewann). Großen Einfluss auf Olivers Arbeit haben die Arbeiten des Pioniers der Spieltheorie Thomas Schelling (Nobelpreisträger 2005), der so wichtige Begriffe wie Nachbarschaftseffekte, kritische Masse und das Konzept des Tipping points einführte. Heute setzt Oliver seine Kenntnisse über dynamische Prozesse bei Entscheidungen über Investitionen in Startups, insbesondere im Bereich der verknüpften Mobilität und der Verbreitung neuer Technologien wie z.B. Blockchain, ein. Literatur und weitere Informationen J. Diamond: Guns, Germs, and S

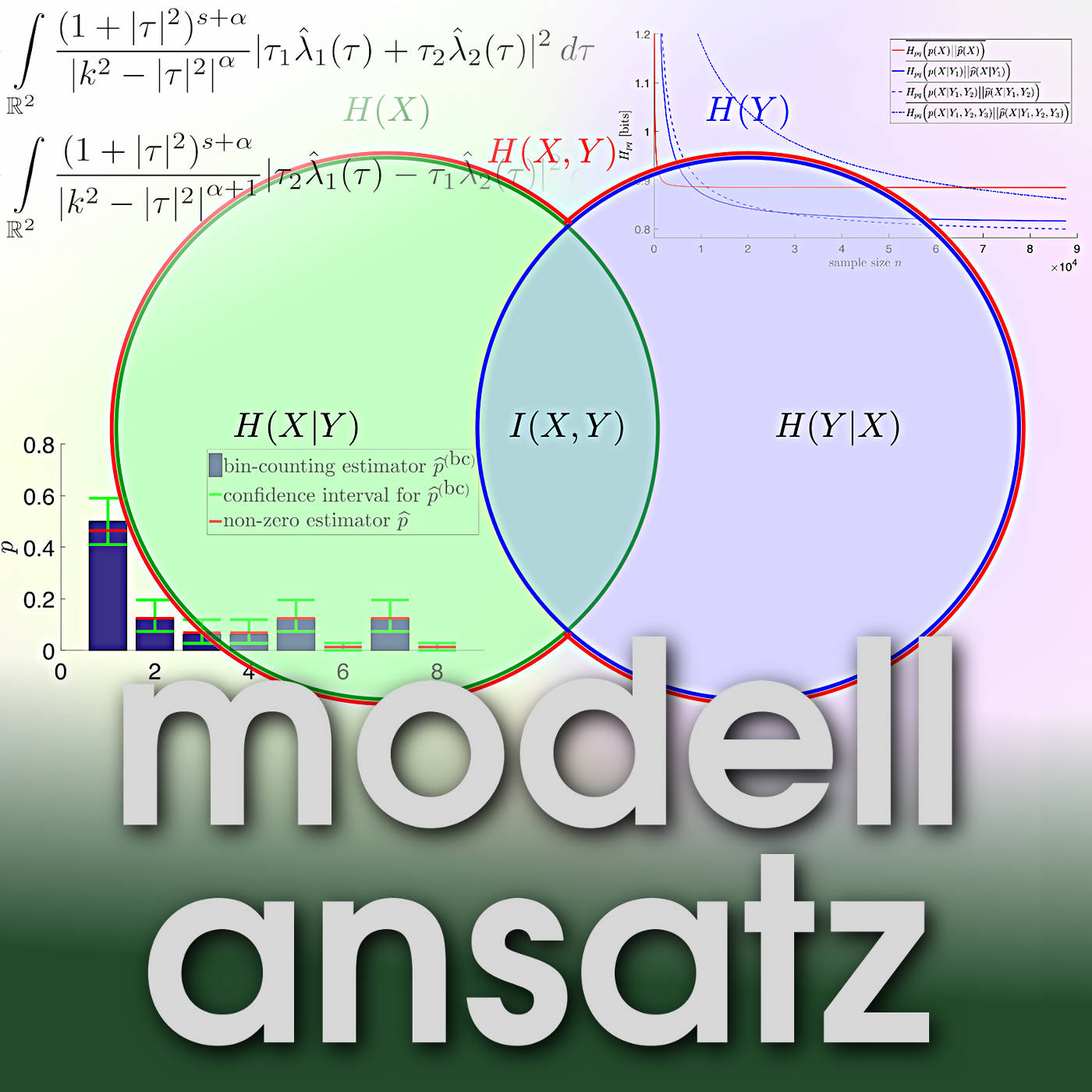

Shannon Information

Paul Darscheid gehört der KIT-Hochschulgruppe Engineers without borders an und arbeitet dort konkret in einer Projektgruppe mit, die im ländlichen Raum von Äthopien einen Brunnen bohrt. Um dafür die Nachhaltigkeit des Grundwasserzuflusses zu klären, suchte er den Kontakt zu Uwe Ehret vom Institut für Wasser und Gewässerentwicklung, Bereich Hydrologie. Die spannenden Themen dort fesselten ihn so sehr, dass schließlich auch seine Masterarbeit in Zusammenarbeit mit der Hydrologie entstand. Zum Spektrum der Fragen der Hydrologen gehören sehr viele unterschiedliche Themen. Man kann summarisch sagen: alles zum Thema Wasserkreislauf, was nicht die Meteorologen beantworten. Konkret geht es z.B. um Niederschlagsabfluss oder Hochwasservorhersage. Eine Frage, die dabei immer wieder auftaucht ist: Wo steckt die meiste Information in den Datensätzen oder den erstellten Modellen? Ein typischer Anwendungsfall schließt beispielsweise aus den Flußpegelstände von unterschiedlichen Flüssen im gleichen System, den Niederschlagmessungen, der Lufttemperatur, Schneehöhen, Bodenfeuchte und Bodenbeschaffenheit auf die Zielgröße - einen konkreten Flusspegelstand. Ein Zusammenhang aller Daten mit der Zielgröße ist klar, aber wie er konkret aussieht ist schwerer zu fassen. Informationsflüsse quantifizieren in diesem Kontext, welche Messreihen die meisten Informationen über die Zielgröße liefern. Daneben stellt sich auch die Frage: Kann ich einmal gewonnene Konzepte auf andere System übertragen? Kann ich mir dort sparen noch einmal sehr viel zu messen, also mit weniger Daten auskommen? Am Anfang steht dann die Frage: Was ist Information? Das Konzept für das sich Paul Darscheid entschieden hat ist die Shannon Entropie - ein Maß für Unsicherheit aufgrund der vorliegenden Streuung in den Daten. Tatsächlich besteht ein Zusammenhang zum physikalischen Begriff der Entropie. Die unterstellte Verteilung eines Datensatzes wird zur Grundlage auf der Größen wie Informationssicherheit und andere abgeleitet werden. Die Natur als Meßdaten führt auf eine diskrete Verteilung, die evtl. noch vergröbert wird durch Wählen von Stufen (bins) innerhalb derer der Unterschied als nicht relevant angesehen wird. Für eine Beobachtung stellt sich die Frage: Wieviel Information steckt in dieser zusätzlichen Messung? Für sehr wahrscheinliche Ereignisse ist es kaum zusätzliches Wissen, weil es mit vorherigen Vermutungen übereinstimmt. Für ein unwahrscheinliches Ereignis ist die zusätzlich gewonnene Information sehr groß. Ein Problem ist auch, dass die diskrete Verteilung aus beobachteten Daten gewonnen wird - d.h. man muss eine Schätzung der Verteilung vornehmen. Darauf aufbauend ist es wichtig zu wissen, wie mit Teilmengen des Datensatzes die geschätzte Verteilung approximiert werden kann. Die Unsicherheit hierbei kommt durch Streuung der Daten und durch den vorhandenen Ausschnitt der Realität, der in den Daten eingefangen wird. Wie sehr beeinflusst die Größe des Datensatzes die zutreffende Schätzung der Verteilung? Dies lässt sich mir der Kullberg-Leibler-Divergenz beschreiben, die die Unsicherheit durch Unwissen über die Verteilung misst. Die Kreuzenthropie addiert die Unsicherheiten der Shannon Entropie und der Kullberg-Leibler Divergenz und ist damit ein Maß für die Gesamtunsicherheit der Schätzung der Verteilung. Hierbei erleichtern die logarithmischen Maße das Rechnen - Produkte werden zu Summen. Literatur und weiterführende Informationen Brunnenprojekt Jello Adancho: Wir versorgen ein Dorf in Äthiopien mit sauberem Trinkwasser Claude Elwood Shannon: The Mathematical Theory of Communication, The Bell System Technical Journal, Vol. 27, pp. 379–423, 623–656, July, October, 1948. Grassberger: Entropy Estimates from Insufficient Samplings, arXiv:physics/0307138, 2003. Thomas M. Cover and Joy A. Thomas. Elements of Information Theory, (Wiley Series in Telecommunications and Signal Processing). Wiley-Interscience, 2006. Vijay P. Singh. Entropy theory and its applications in environmental and water engineering, Wiley-Blackwell, 2013. Janusz Miskiewicz. Improving quality of sample entropy estimation for continuous distribution probability functions, Physica A: Statistical Mechanics and its Applications, 450(C):473–485, 2016. Ilias G. Pechlivanidis, Bethanna Jackson, Hilary Mcmillan, and Hoshin V. Gupta. Robust informational entropy-based descriptors of flow in catchment hydrology, Hydrological Science Journal, 61(1):1–18, 2016. Podcasts S. Hemri: Ensemblevorhersagen, Gespräch mit G. Thäter im Modellansatz Podcast, Folge 96, Fakultät für Mathematik, Karlsruher Institut für Technologie (KIT), 2016.

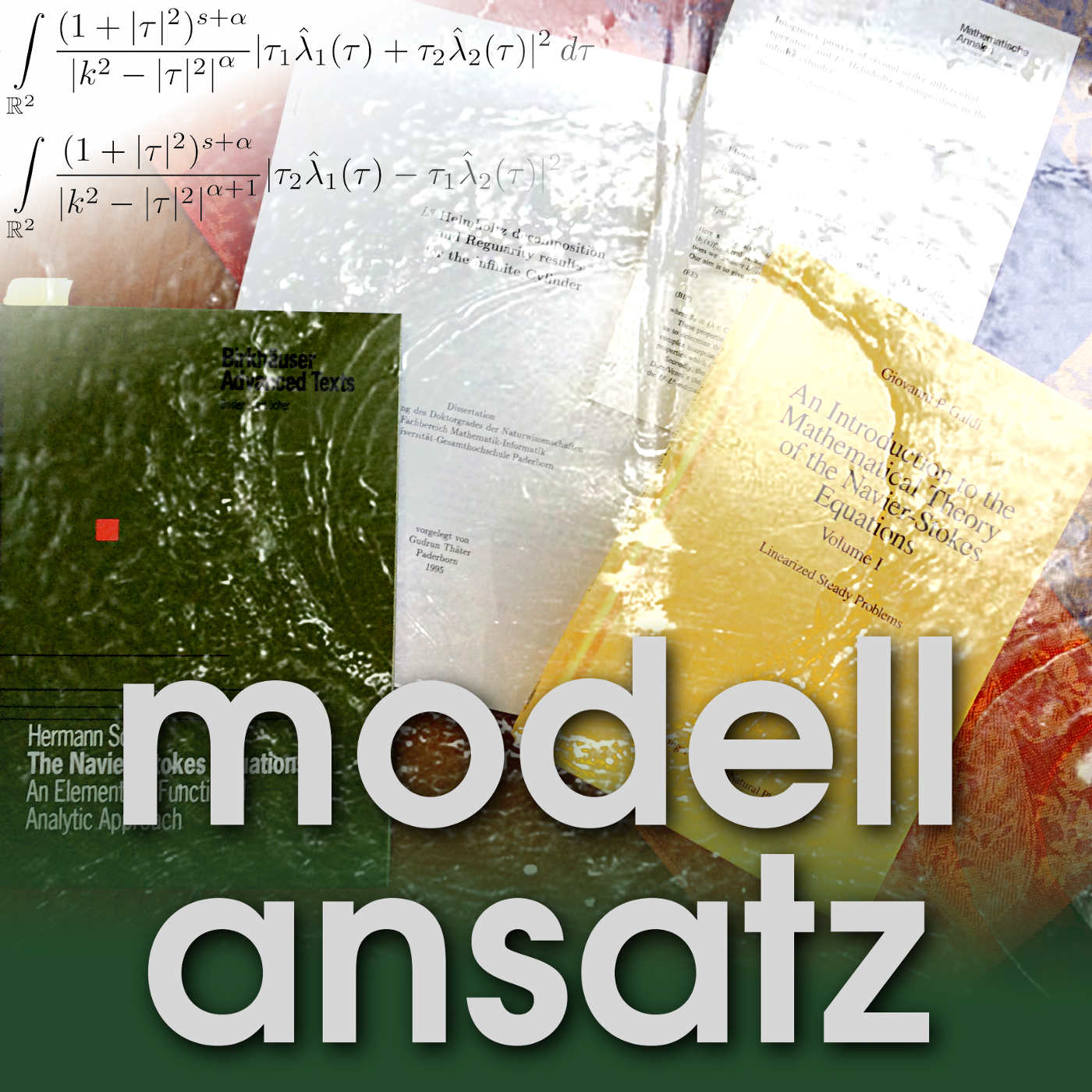

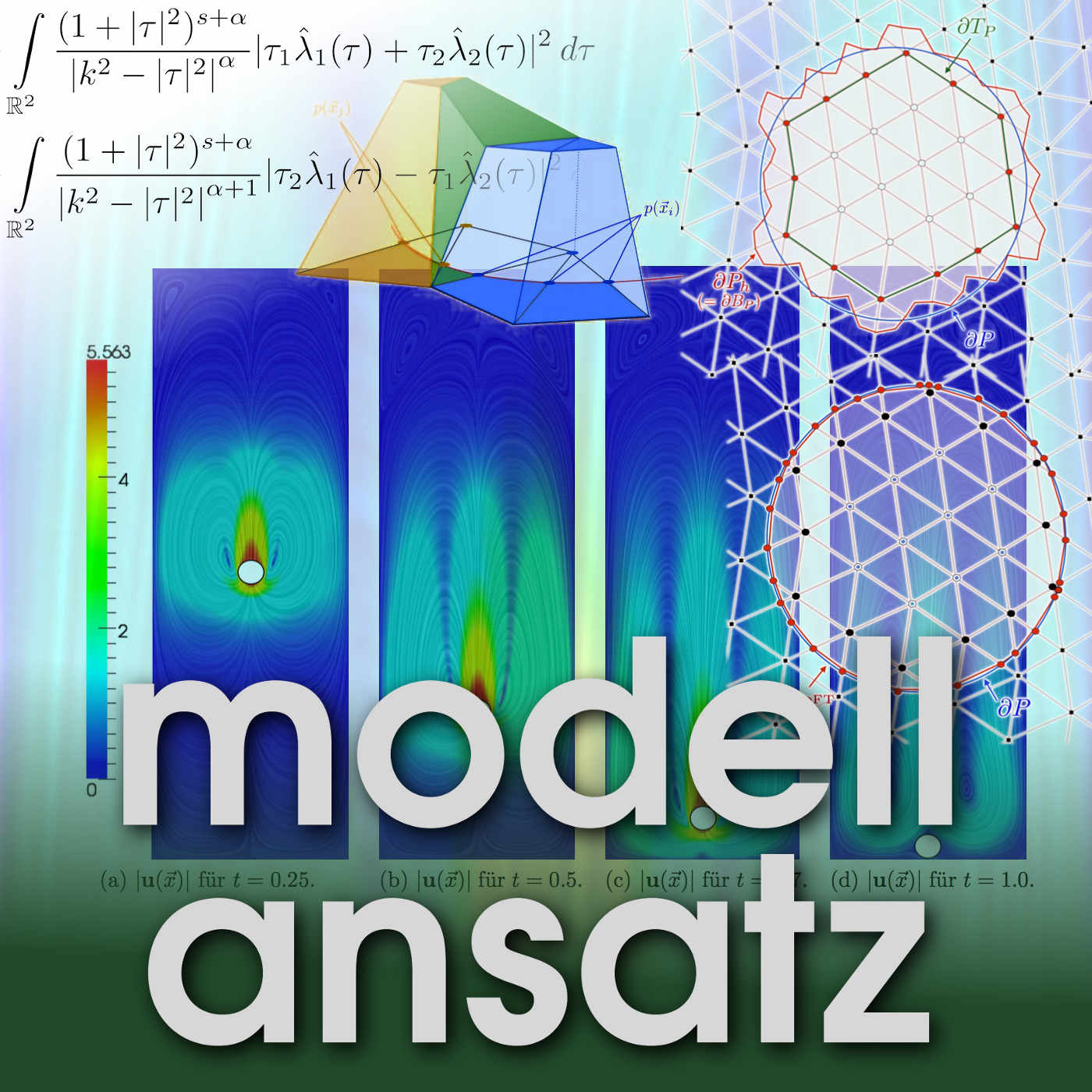

Stokes Operator

Peer Kunstmann hat in Kiel Mathematik studiert und 1995 promoviert. In seiner Zeit an der Fakultät für Mathematik in Karlsruhe hat er sich 2002 habilitiert. Er arbeitet als Akademischer Oberrat dauerhaft in der Arbeitsgruppe Angewandte Analysis an unserer Fakultät. Gudrun hat das Gespräch über ein für beide interessantes Thema - das Stokesproblem - gesucht, weil beide schon über längere Zeit mit unterschiedlichen Methoden zu dieser Gleichung forschen. Das Stokesproblem ist der lineare Anteil der Navier-Stokes Gleichungen, dem klassischen Modell für Strömungen. Sie haben eine gewisse Faszination, da sie einfach genug erscheinen, um sie in ihrer Struktur sehr eingehend verstehen zu können, zeigen aber auch immer wieder, dass man sie nicht unterschätzen darf in ihrer Komplexität. Peers Interesse wurde zu Beginn seiner Zeit in Karlsruhe durch Matthias Hieber geweckt, der inzwischen an der TU Darmstadt tätig ist. Es zeigte sich seit damals als sehr aktives Forschungsgebiet, weshalb er auch immer wieder neu zu diesen Fragestellungen zurückgekehrt ist. Mit den klassischen Randbedingungen (konkret, wenn auf dem Rand vorgeschrieben wird, dass die Lösung dort verschwindet = homogene Dirichletbedingung) ist das Stokesproblem auffassbar als Laplaceoperator, der auf Räumen mit divergenzfreien Vektorfeldern agiert. Der Laplaceoperator ist sehr gut verstanden und die Einschränkung auf den abgeschlossenen Unterraum der Vektorfelder mit der Eigenschaft, dass ihre Divergenz den Wert 0 ergibt, lässt sich mit einer Orthogonalprojektion - der Helmholtzprojektion - beschreiben. Im Hilbertraumfall, d.h. wenn die Räume auf einer L^2-Struktur basieren und der Raum deshalb auch ein Skalarprodukt hat, weiß man, dass diese Projektion immer existiert und gute Eigenschaften hat. Für andere Räume ohne diese Struktur (z.B. -basiert für q nicht 2) hängt die Antwort auf die Frage, für welche q die Projektion existiert, von der Geometrie des Gebietes ab. Für beschränkte Gebiete geht vor allem die Glattheit des Randes ein. Das spiegelt sich auch auf der Seite des Laplaceproblems, wo die Regularität im Innern des Gebietes relativ elementar gezeigt werden kann, aber in der Nähe des Randes und auf dem Rand gehen in die Argumente direkt die Regularität des Randes ein. Mathematisch wird das Gebiet dabei mit Kreisen überdeckt und mit Hilfe einer sogenannten Zerlegung der Eins anschließend die Lösung für das ganze Gebiet zusammengesetzt. Für die Kreise, die ganz im Innern des Gebietes liegen, wird die Lösung auf den ganzen Raum mit dem Wert 0 fortgesetzt, weil die Behandlung des ganzen Raumes sehr einfach ist. Für Kreise am Rand, wird der Rand lokal glatt gebogen zu einer geraden Linie und (ebenfalls nach Fortsetzung mit 0) ein Halbraum-Problem gelöst. Natürlich liegt es in der Glattheit des Randes, ob das "gerade biegen" nur kleine Fehlerterme erzeugt, die sich "verstecken" lassen oder ob das nicht funktioniert. Für einen Rand, der lokal durch zweimal differenzierbare Funktion dargestellt werden kann, funktioniert diese Technik gut. Für Gebiete, die einen Rand haben, der lokal durch Lipschitzstetige Funktionen darstellbar ist, werden z.B. Randintegraldarstellungen direkt untersucht. Dort existiert die Helmholtzzerlegung für alle q im Intervall (wobei vom Gebiet abhängt). Durch die kleinen Fehlerterme, die in der Technik entstehen, wird es auch nötig, die Gleichung für die Divergenz zu untersuchen, wo keine 0 sondern eine beliebige Funktion (natürlich mit den entsprechenden Regularitätseigenschaften) als rechte Seite erlaubt ist. Ein Begriff, der eine wichtige Eigenschaft von partiellen Differentialgleichungen beschreibt, ist der der maximalen Regularität. Einfach ausgedrückt heißt das, wenn ich die rechte Seite in einem Raum vorgebe, ist die Lösung genau so viel regulärer, dass nach Anwendung des Differentialoperators das Ergebnis die Regularität der rechten Seite hat. Für das Laplaceproblem wäre also die Lösung v für jedes vorgegebene f so, dass und f im gleichen Raum sind. Diese Eigenschaft ist z.B. wichtig, wenn man bei nichtlinearen Problemen mit Hilfe von Fixpunktsätzen arbeitet, also z.B. den Operators iterativ anwenden muss. Dann sichert die maximale Regularität, dass man immer im richtigen Raum landet, um den Operator erneut anwenden zu können. Im Zusammenhang mit der Frage der maximalen Regularität hat sich der -Kalkül als sehr nützlich erwiesen. Ein anderer Zugang wählt statt der Operatorformulierung die schwache Formulierung und arbeitet mit Bilinearformen und Ergebnissen der Funktionalanalysis. Hier kann man vergleichsweise wenig abstrakt und in diesem Sinn elementar auch viel für das Stokes- und das Navier-Stokes Problem zeigen. Es gibt ein vorbildliches Buch von Hermann Sohr dazu. Literatur und weiterführende Informationen M. Geißert, P.C. Kunstmann: Weak Neumann implies H^\infty for Stokes, Journal Math. Soc. Japan 67 (no. 1), 183-193, 2015. P.C. Kunstmann: Navier-Stokes equations on unbounded domains with rough initial data, Czechos

Automated Binary Analysis