Modellansatz

252 episodes — Page 4 of 6

Schülerlabor

Ernestina Dittrich ist Studiendirektorin und hat Mathematik, Physik und Informatik am Gymnasium unterrichtet. Sie arbeitete außerdem am Studienseminar in Karlsruhe, ist Fachberaterin am Regierungspräsidium Karlsruhe und wurde 2005 an unsere Fakultät geholt, um die Abteilung für Didaktik zu verstärken und neue Ideen zu verwirklichen. Dieses Jahr geht sie in den Ruhestand und so wurde es höchste Zeit, ein Gespräch über das Schülerlabor Mathematik und die Entwicklung bis heute zu führen. Frau Dittrich hatte sich schon lange vor ihrem Wechsel an unsere Fakultät mit der Idee getragen, dass wie in der Physik auch in der Mathematik Experimente den Stoff auf neuartige Weise zugänglich machen könnten. Ist das Schulfach Mathematik meist polarisierend also entweder Horror- oder Lieblingsfach so stünde doch ein entdeckender und spielerischer Zugang ohne Formeln allen gleichermaßen offen. Das wurde nun seit 2005 an unserer Fakultät Stück für Stück verwirklicht. Insgesamt wurden 90 mathematische Experimente zusammengetragen. Es war das erste seiner Art in Baden Württemberg und lange Zeit auch das einzige. Von der 3.-12. Klasse sind Schülerinnen und Schüler aller Schulformen oder auch Lehrergruppen bzw. Referendare vom Studienseminar und Lehramtsstudierende willkommen. An je einem Freitag Nachmittag im Monat steht die Tür sogar für alle interessierten offen. Darüber hinaus gehen Exponate auch auf Reisen, z.B. zur Kinderuni, zum Wissenschaftsfestival EFFEKTE im Schlosspark oder zu anderen Wissenschaftsfesten wie im Luisenpark in Mannheim oder im Europapark Rust. Die weiteste Reise führte bisher zum Science Festival nach Abu Dhabi. Das Schülerlabor wird sehr gut angenommen. Schon über 1000 Schulklassen haben es besucht. In der Regel dauert eine Veranstaltung 90 min. Am Anfang steht eine Einführung in drei wichtige Experimente - dann dürfen sich alle frei bewegen. Für Fragen gibt es stets Betreuung durch Mitarbeiterinnen der Abteilung für Didaktik. Die Lehrpersonen der Schulklassen sind außerdem mit dabei. Alle Versuche sind kurz und knapp beschrieben und es gibt einen Kasten mit Tipps, wenn man allein einfach nicht weiterkommt. Natürlich geht es dabei meist lebhaft zu: Die Schülerinnen und Schüler unterhalten sich über Lösungsversuche, es gibt Jubelgeschreie, wenn etwas geklappt hat und an einigen Stationen müssen sich die Kinder auch bewegen, um die Aufgaben zu lösen. Nachdem das Labor für die ersten Jahre sein Domizil in der Hertzstraße hatte, ist es nun seit dem Umzug der Fakultät ins renovierte Kollegiengebäude Mathematik endlich auch für alle Mitarbeiter und Gäste der Fakultät sichtbar und spürbar, welche Arbeit hier stattfindet. Im Unterschied zu ähnlichen Angeboten in Museen ist die Zusammenstellung der Experimente und Exponate didaktisch nach verschiedenen Aspekten durchdacht. Z.B. gibt es viele verschiedenartige Angebote rings um das Thema platonische Körper (inkl. eines Workshops). Während des Gespräches wurden folgende Exponate angesprochen: Die Unendlichkeit (realisiert mit Spiegeln) Ich bin eine Funktion (ein Bewegungsspiel) Glockenkurve (Normalverteilung als Grenzprozess für Bernoulli-Experimente) Minimalhäute (Seifenhäute um Gestelle aus platonischen Körpern) Der Besuch im Schülerlabor ist kostenlos. Die Einrichtung und die nötigen Mitarbeiterstellen wurden bisher vor allem von der Hector Stiftung gefördert. Inzwischen gibt es von der Abteilung für Didaktik noch eine ganze Anzahl weiterer Angebote, die zum Teil auch das Schülerlabor nutzen. So ist das Labor ein Lehr-Lern-Labor in der Ausbildung der Lehramtsstudierenden, d.h. die Experimente werden in der Fachdidaktik-Ausbildung verwendet, um didaktische Konzepte für die Umsetzung der mathematischen Sachverhalte und Kompetenzen im Unterricht zu entwickeln. Es gibt bisher 15 Workshops für verschiedene Altersstufen (Dauer je 90 min), die Schulklassen und andere Gruppen buchen können. Die sogenannten Mathekids (7./8. Klasse) und Matheprofis (9./10. Klasse) sind ein Schuljahr lang jede Woche für 90 min in der Fakultät, um im Rahmen der Begabtenförderung Workshops zu erleben. Diese werden von zwei erfahrenen Lehrkräften und von Lehramtsstudierenden gehalten. Die Studierenden gewinnen Praxiserfahrung während ihrer Fachdidaktikausbildung. Die Kinder entwickeln durch kleine Forschungsaufträge dabei auch neue Workshops selbst. Für zwei dieser Projekte haben die Gruppen sogar einen Preis für junge Forscher - den sogenannten OsKarl gewonnen. Literatur und weiterführende Informationen Alle Schülerlabore am KIT Begabtenförderung am KIT Fotos vom girls' day 2015 im Schülerlabor

Metrische Geometrie

Petra Schwer ist seit Oktober 2014 Juniorprofessorin an unserer Fakultät. Sie arbeitet im Institut für Algebra und Geometrie in der Arbeitsgruppe Metrische Geometrie. Ab Oktober 2016 startet in diesem Institut ein neues Graduiertenkolleg mit dem Titel Asymptotic Invariants and Limits of Groups and Spaces und Petra Schwer freut sich darauf, dort viele mit ihrer Begeisterung anstecken zu können. Ihr Weg in die Algebra war nicht ganz direkt: Sie hat zunächst Wirtschaftsmathematik in Ulm studiert. Ein Wechsel an die Uni Bonn ebnete den Weg ins etwas abstraktere Fahrwasser. Zwei Ausflüge in die Industrie (zwischen Diplom und Promotionszeit und in der Postdoc-Phase) haben ihre Entscheidung für die akademische Mathematik bekräftigt. Im Gegensatz zur Differentialgeometrie, die von Ihrem Ursprung her auf analytischen Methoden und Methoden der Differentialrechnung (wie zum Beispiel des Ableitens) beruht, untersucht die Metrische Geometrie Mengen mit Abstandsfunktion. Darunter fallen auch die klassischen Riemannschen Geometrien, aber auch viel allgemeinere geometrische Strukturen, wie zum Beispiel Gruppen oder Graphen. Eine Metrik ist nichts anderers als eine Funktion, die einen Abstand zwischen zwei Punkten definiert. Die Euklidische Geometrie (in zwei bzw. drei Dimensionen) ist sicher allen aus der Schule bekannt. Sie ist ein Beispiel eines Geometriemodells in der metrischen Geometrie. Euklid versuchte erstmals Geometrie von Ihren Grundbausteinen her zu beschreiben. Er hat sich gefragt: Was ist ein Punkt? Was ist eine Gerade? Wie lässt sich der Abstand eines Punktes zu einer Geraden definieren? Schließlich stellte er eine Liste von grundlegenden Objekten sowie deren Eigenschaften und Beziehungen auf (Axiome genannt) die eine Geometrie erfüllen soll. Diese Axiome sind dabei die Eigenschaften, die sich nicht aus anderen ableiten lassen, also nicht beweisbar sind. Eines dieser Axiome besagte, dass durch einen festen Punkt genau eine Gerade parallel zu einer vorgegebenen anderen Geraden verläuft. Es entbrannte ein Jahrhunderte dauernder Streit darüber, ob sich dieses Parallelenaxiom aus den anderen aufgestellten Axiomen ableiten lässt, oder ob man diese Eigenschaft als Axiom fordern muss. Sehr viel später wurde klar, dass der Streit durchaus einen wichtigen und tief liegenden Aspekt unserer Anschauungsgeometrie berührte. Denn es wurden gleich mehrere Mengen (mit Abstandsfunktion) entdeckt, in denen diese Eigenschaft nicht gilt. Deshalb nannte man die Geometrien, in denen das Parallelenaxiom nicht gilt nichteuklidische Geometrien. Ein sehr nahe liegendes Beispiele für nichteuklidische Strukturen ist z.B. die Kugel-Oberfläche (damit auch unsere Erdoberfläche) wo die euklidische Geometrie nicht funktioniert. In der Ebene ist der traditionelle Abstand zwischen zwei Punkten die Länge der Strecke, die beide Punkte verbindet. Das lässt sich im Prinzip auf der Kugeloberfläche imitieren, indem man einen Faden zwischen zwei Punkten spannt, dessen Länge dann anschließend am Lineal gemessen wird. Spannt man den Faden aber "falschrum" um die Kugel ist die so beschriebene Strecke aber nicht unbedingt die kürzeste Verbindung zwischen den beiden Punkten. Es gibt aber neben der klassischen Abstandsmessung verschiedene andere sinnvolle Methoden, einen Abstand in der Ebene zu definieren. In unserem Gespräch nennen wir als Beispiel die Pariser Metrik (oder auch SNCF oder Eisenbahnmetrik). Der Name beschreibt, dass man im französischen Schnellzugliniennetz nur mit umsteigen in Paris (sozusagen dem Nullpunkt oder Zentrum des Systems) von Ort A nach Ort B kommt. Für den Abstand von A nach B müssen also zwei Abstände addiert werden, weil man von A nach Paris und dann von Paris nach B fährt. Das verleiht der Ebene eine Baumstruktur. Das ist nicht nur für TGV-Reisende wichtig, sondern gut geeignet, um über Ordnung zu reden. Ebenso sinnvoll ist z.B. auch die sogenannte Bergsteiger-Metrik, die nicht allein die Distanz berücksichtigt, sondern auch den Aufwand (bergauf vs. bergab). Damit ist sie aber in den relevanten Fällen sogar asymmetrisch. D.h. von A nach X ist es "weiter" als von X nach A, wenn X oben auf dem Berg ist und A im Tal. Analog ist es wenn man mit dem Boot oder schwimmend mit bzw. gegen die Strömung oder den Wind unterwegs ist. Dann misst man besser statt der räumlichen Distanz die Kraft bzw. Energie, die man für den jeweiligen Weg braucht. Für Karlsruher interessant ist sicher auch die KVV-Metrik, die wie folgt beschrieben wird: Um den Abstand von einem Punkt A zu einem anderen Punkt B der Ebene zu messen, läuft man von A und B senkrecht zur x-Achse (und trifft diese in Punkten A', bzw B') und addiert zu diesen beiden Abständen den Abstand von A' zu B'. Anschaulich gesprochen muss man also immer erst von A zur Kaiserstrasse, ein Stück die Kaiserstraße entlang und dann zu B. Eben so, wie die KVV ihre Strecken plant. Zwischen einer Ebene und z.B. der Kugeloberfläche gibt es einfach zu verstehende und doch wichtige geometrische Unters

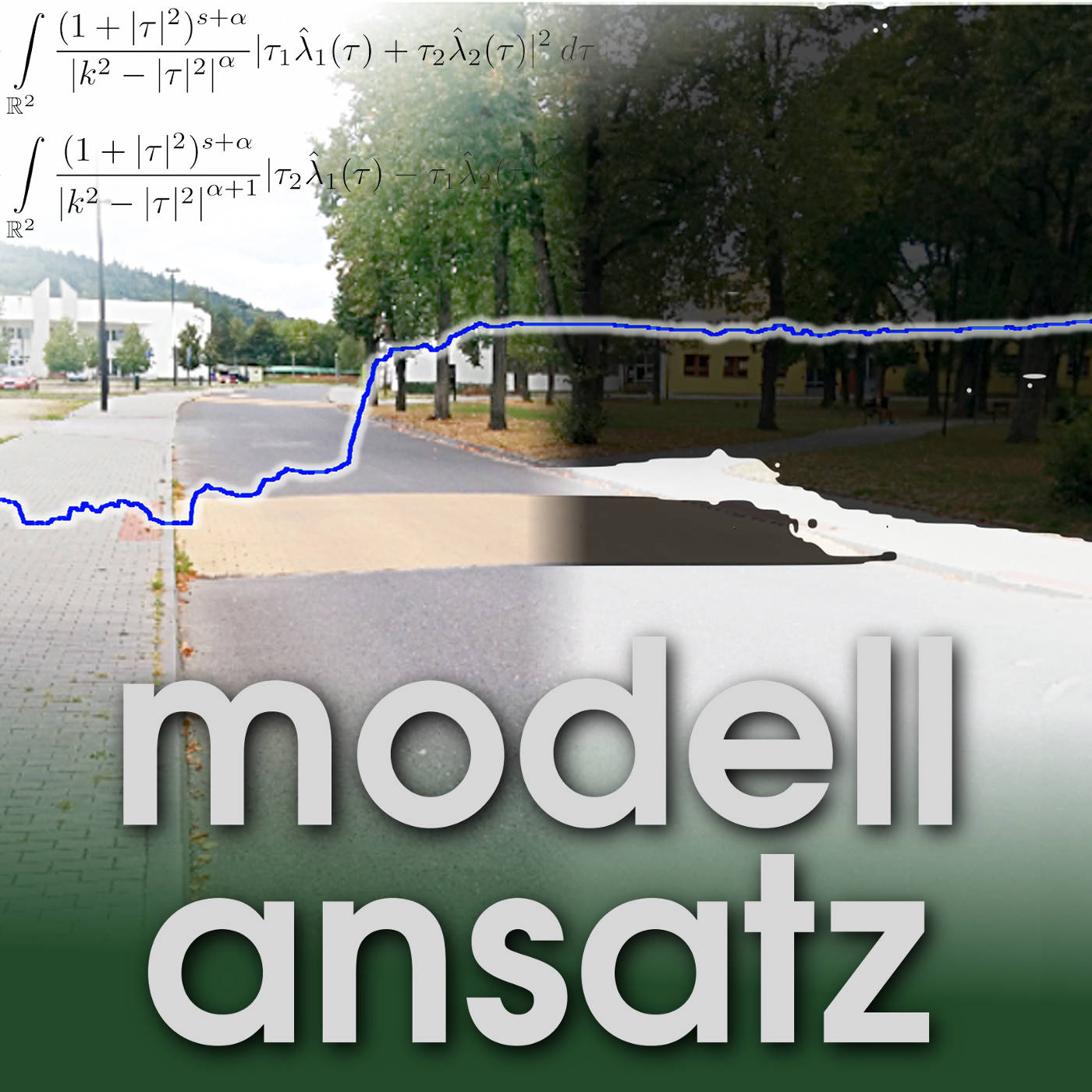

Schulwegoptimierung

Sven Müller ist Professor für Verkehrsbetriebswirtschaft im Studiengang Verkehrssystemmanagement an der HTW hier in Karlsruhe. Im Rahmen seiner Promotion an der TU Dresden in der Gruppe von Knut Haase begann er der Frage nachzugehen, welche Faktoren die Verkehrsmittelwahl für den Schulweg beeinflussen. Hintergrund dieser Frage war, dass zu der Zeit in Dresden die Schließung von Schulstandorten heiß diskutiert wurde. Die Notwendigkeit von Schulschließungen war dabei nicht umstritten, jedoch welche konkrete Variante die für alle beste Lösung darstellen würde. Hier war die Diskussion emotional stark aufgeladen, d.h. ein Modell, das bei der Planung des Schulnetzes für objektive Informationen sorgt, wäre ganz besonders hilfreich. Am besten mit klaren Empfehlungen für optimale Lösungen in Bezug auf Schulwege und deren Kosten. Der naheliegende und auch herkömmliche Indikator für so ein Modell ist eine Distanzminimierung. Dadurch lassen sich objektive Aussagen zu minimalen Transportkosten für die Schüler ermitteln. Jedoch stellte sich schnell heraus, dass verlässliche Aussagen dazu fehlten, welche Verkehrsmittel die Schüler anteilig wählen und wieso. Ebenso welche Schulen die Schüler selbst wählen würden und wieso. Deshalb war ein wichtiger Ausgangspunkt für das Forschungsthema eine sehr groß angelegte Schüler-Befragung, die von den Studierenden im Rahmen eines Seminares geplant und durchgeführt wurde. Durch das große Engagement war die Stichprobe schließlich sehr groß. Es wurden dabei Fragebögen in fast allen Schulen verteilt und die Ergebnisse in einer selbst konzipierten Datenbank gesammelt - gut aufbereitet für eine anschließende Auswertung und Optimierung. So war es möglich, aus diesen Daten Prognosen zur Verkehrsmittelwahl in Abhängigkeit von Distanz und Verkehrsmitteloptionen zu erstellen und über verschiedene Schließungsszenarien eine optimale Verteilung der Schulen (in Bezug auf Kosten für die Stadt) zu ermitteln. All das floß auch in die Promotion von Sven Müller ein. Als wichtiges Problem für die mathematische Behandlung der Optimierung erwies sich, dass die Optimierungslösung auf die Daten zurückwirkt. Das führt auf ein dynamisches Problem, das mit herkömmlichen Methoden nicht behandelt werden kann. Auch bei der ÖPNV-Planung von optimierten Liniennetzen tritt das Problem auf: Kürzere Reisezeiten und mehr Direktverbindungen führen z.B. zu einem höheren Fahrgastaufkommen. Mathematisch ausgedrückt heißt das die Nebenbedingungen werden dynamisch und das Problem wird in der Regel nichtlinear. Betriebliche Problemstellungen haben oft ein ähnliches Problem, d.h. die Daten bleiben nicht fix sondern sind abhängig von der gefundenen Lösung. Ein wichtiges Teilergebnis des Forschungsvorhabens von Sven Müller ist eine exakte lineare Reformulierung für das ursprünglich nicht-lineare Optimierungsmodell. Ein weiteres grundsätzliches Problem ist, dass die Nutzenfunktion hinreichend genau beobachtet werden müsste. Ideal wäre es, wenn nur noch weißes Rauschen im Störterm berücksichtigt werden muss, d.h. alle zufälligen Anteile sind wirklich nur zufällig und unverbunden mit den beobachteten Daten. Das ist in der Realität leider nicht möglich und so führen nicht beobachtete Anteile zu Kovarianzen im Modell, die nicht null sind. Anders ausgedrückt, ist der stochastische Anteil nicht nur weißes Rauschen. Nebenbei gewann er noch einige andere Erkenntnisse. Z.B. ist es für die Prognose der Fahrradnutzung nicht ausreichend, die Distanz als Maß zu nehmen, da es bergauf- bzw. bergab gehen kann und das für die Entscheidung mindestens ebenso wichtig ist wie die Entfernung. Dieser Frage geht er zur Zeit auch mit seinen Studierenden im Studiengang Verkehrssystemmanagement an der HTW nach. Zwei weitere Themen, an denen Sven Müller zur Zeit arbeitet, weil sich gute Anknüpfungspunkte aus den eben geschilderten neuen Optimierungsstrategien bieten, sind z.B. die Versorgungsplanung in der Medizin und die Planung der Pilgerströme in Mekka.Genauer gesagt geht es bei der Versorgungsplanung um Vorsorgeprogramme (Prävention). Durch eine hohe Attraktivität des Angebots soll erreicht werden, das möglichst viele Patienten freiwillig teilnehmen. Auch hier ist die gute Erreichbarkeit der Ärzte wichtig, aber auch ihre Attraktivität. Es gilt abzuwägen, wie viele Ärzte an dem Präventionsprogramm mit welcher Kapazität teilnehmen sollen. Einerseits aus Kostengründen natürlich möglichst wenige. Aber andererseits ist gerade die kurze Wartezeit auf einen Termin ein Garant dafür, dass der Termin auch wahrgenommen wird. Somit führt die Optimierung wieder auf ein dynamisches Problem. Viele Standorte führen zu kurzen Wegen und weniger "no shows". Aber viele Untersuchungen bei einem Arzt stärken seine Kompetenz - verlängern aber die zu erwartende Wartezeit. Leider führt das außerdem auf ein nicht konvexes Optimierungsproblem, d.h. die Existenz von Optima folgt nicht mit traditionellen Methoden (bei denen ist Konvexität eine zentrale Voraussetzung). In Mekka sind

Hundert

Zur 100. Folge haben sich Gudrun und Sebastian bei Gudrun getroffen, um sich zum Jubiläum einfach mal in Ruhe über den Podcast, den Ursprung, was wir so erlebten und was vor uns liegt. Für Sebastian öffnete die Raumzeit-Folge zu Tandem-X die Augen, wieviel wissenschaftlicher Inhalt in einem Podcast übertragen werden kann. Schnell war Gudrun begeistert und nahm mit Sebastian die erste Folge zu ihrer Vorlesung über mathematische Modellbildung auf. Nach zwei weiteren Aufnahmen zur Aorta-Challenge und zur Unsichtbarkeit machten wir unsere ersten Versuche öffentlich. Schon früh stellte sich heraus, dass uns die Themen zur Mathematik nicht schnell ausgehen, da es so viele Abschlussarbeiten, Forschungsthemen und Vorlesungen gibt, die jeweils auch noch unter unterschiedlichen Sichtweisen betrachtet werden können. Im Storify sieht man, wie wir schon früh vielseitig unterstützt wurden und unsere Hörerzahl stieg schnell an: Ein besonderer Unterstützer war dabei Henning Krause, der uns eine Grußbotschaft sendete und ganz besonders die Qwirkle-Folge schätzt. Einen weiteren Gruß sandte uns Katrin Leinweber vom KonScience Podcast. Weitere Grüße erreichten uns aus Kanada von Anja Randecker aus unserer Folge zu Wilden Singularitäten, die nun in Toronto als Post-Doc weiter zu Translationsflächen forscht. Sehr haben wir uns auch über die Grüße aus dem Grünen von Martin Rützler gefreut, der selbst im Radio Mono Podcast, im DKG-Podcast und im Sendegarten regelmäßig zu hören ist, die deutschen GanzOhr-Wissenschaftspodcast-Treffen initiierte und die Wissenschaftspodcasts-Seite mit begründete. Neben Gesprächen über Vorlesungen, wie zur Analysis, Höhere Mathematik oder Digitale Währungen, hat nun Gudrun auch eine Vorlesung aufgenommen: Den Schnupperkurs zur Verkehrsmodellierung, der jeweils auf viele Gespräche im Podcast verweist. Bei Konscience gibt es interessante Konzepte zur Verknüpfung von Vortrag und Podcast, die auch auf Vorlesungen angewendet werden könnten. Ganz besondere Grüße erreichten uns von Lorenz Adlung, den wir in der Folge 39 zur Systembiologie im Podcast hatten. Lorenz ist auch ein begnadeter Science-Slammer, wie auch Anastasia August aus unserer Folge 37 zum Metallschaum. Sie ist weiterhin als Mathematikerin am Institut für Angewandte Materialien, wo sie aktuell an Gradierten Schäumen und Magischen Schäumen forscht und ein Graduiertenkolleg vorbereitet. Sebastian hat die Folge 98 zu Primzahlen und Gruppen sehr gefallen, wo Rebecca Waldecker den Einstieg in die Algebra und Zahlentheorie sehr anschaulich beschrieben hat. Besonders spannend sind auch Themen, die inzwischen zu Ausgründungen geführt haben: Markus Dahlem in M-Sense mit dem Thema Migräne, Tobias Hahn mit der Chromatographie, sowie Carlos Falquez, Iris Pantle und Balazs Pritz zu Strömungslärm. Im Zuge des SFB zu Wellenphänomenen haben wir auch ein Special zum Cooking Math Projekt durchgeführt, wo durch Gespräche die vielseitigen Kunstobjekte zur Mathematik dargestellt werden. Ein persönliches Special war für uns aber auch die Nullnummer in Folge 73, die wir mit Nele Heise aufnehmen konnten. Ebenso haben wir uns sehr über die Grüße von Melanie Bartos gefreut, die mit ihrem Podcast Zeit für Wissenschaft immer wieder über spannende wissenschaftliche Themen aus der Uni Insbruck berichtet. Natürlich haben uns auch Annika Brockschmidt und Dennis Schulz vom Science Pie Podcast aus Heidelberg einen wunderschönen Gruß gesendet, und auch Nora Ludewig und Markus Völter vom Omega Tau Podcast schlossen sich mit einer lieben Botschaft an. Und wir freuen uns die beiden im Oktober beim GanzOhr2016-Treffen der Wissenschaftspodcasts wieder zu sehen. Unsere Audiodaten laufen inzwischen durch die Open Source Podcast Audio Chain (OSPAC). Einen Einblick kann man im Vortrag zu OSPAC auf der Subscribe7 oder dem erweiterten Vortrag zu OSPAC auf der GPN16 erhalten, und auch LIGO-Rohdaten auswerten. Informationen zum Aufnehmen von Podcasts mit dem iPhone habe ich auf dem Sendegate hinterlegt. Spannend waren auch die Podcast Nachbarschafts-Graphen, die nun auch eine neue Fortsetzung auf dem FYYD Podcast-Verzeichnis. Wir haben einige Überraschungen in den bisher beliebtesten Folgen und am längesten gehörten Folgen im Modellansatz- welches dies sind, muss man sich beim Interesse im Podcast anhören.

Kointegrierte Prozesse

Markus Scholz hat gerade seine Dissertation Estimation of Cointegrated Multivariate Continuous-Time Autoregressive Moving Average Processes an der KIT-Fakultät für Mathematik verteidigt. Gudrun ergriff die Gelegenheit, mit ihm über die Idee und Anwendungsmöglichkeiten von Zeitreihen-Modellen zu sprechen. Prinzipiell stehen Zeitreihen einerseits für zeitlich geordnete (Mess-)Daten, die z.B. durch Abtasten (wiederholtes Messen) eines Vorgangs in der Realität entstehen. Andererseits werden sie in der Statistik als Ergebnis eines Stochastischen Prozesses interpretiert, der diese Zeitreihe als eine seiner Realisierungen erzeugt. Der stochastische Prozess ist hierbei ein Modell und soll die wichtigsten Eigenschaften der Daten erfassen. Er soll auch dazu dienen, zuverlässige Schätzungen zu liefern, wie sich die Zeitreihe wahrscheinlich in die Zukunft fortsetzt. Mitunter interessieren hier sogar nur so oberflächliche Informationen wie Saisonalität und Trends. Ein Aspekt, der im Titel der Arbeit von Markus Scholz als "Moving Average" beschrieben ist, ist die Eigenschaft, dass die Werte der Zeitreihe vor allem durch die letzten davor liegenden Meßpunkte beeinflusst sind und die "Erinnerung" an weiter in der Vergangenheit liegende Zustände abklingt. Im Modell ist hier stets eine Zufallsquelle integriert, die man sich wie ein Auswürfeln pro Zeitpunkt vorstellen kann. Wie erfolgt hier die Zuordnung zwischen Datenreihe und stochastischem Modell? In der Regel basiert die Wahl auf der Erfahrung über zuvor benutzte Modelle in ähnlichen Zusammenhängen und auf den bekannten Eigenschaften der Modelle. Anschließend müssen jedoch stochastische Tests belegen, dass die Zuordnung tatsächlich korrekt ist. Markus Scholz hat sich mit stochastischen Prozessen beschäftigt, die kontinuierlich in der Zeit sind statt - wie bisher beschrieben - diskret. Sie eignen sich z.B. zur Modellierung von Temperaturverläufen. Prinzipiell nimmt man dabei an, dass eine hoch genug gewählte Abtastrate den Übergang von diskreten Messungen zu einem als stetig angesehenen Prozess unkritisch macht. Der Aspekt, der ihn hier vor allem beschäftigt hat, war die Erweiterung bekannter Modelle um die Eigenschaft der Nicht-Stationarität. Das heißt kurz gesagt, die Grundeigenschaften des Prozesses können sich über die Zeit ändern. Das kennen wir ja auch von der Temperatur: Einerseitzs durchlaufen tägliche Tiefst-, Höchst- oder Mittelwerte der Temperatur im Jahresverlauf eine typische Kurve für eine betrachtete Region. Andererseits kann im konkreten Jahr ein untypischer Verlauf vorliegen und es ist gar nicht so leicht zu quantifizieren, ob es sich um eine untypische Beobachtung handelt oder sich z.B. die Mittelwerte tatsächlich statistisch signifikant ändern. Anders gesagt führt die Nicht-Stationarität im Modell auf Probleme bei zugehörigen Schätzungen, die in der Regel schwer zu lösen sind. Deshalb hat Markus Scholz zunächst einen handhabbaren Spezialfall ausgewählt, die sogenannten kointegrierte Prozesse. Als stochastische Quelle - dienen ihm Lévy-Prozesse, die Sprünge zulassen. Die einfachste Zufallsquelle wären Brownsche Bewegungen, die aber nur stetig (d.h. ohne Sprünge) möglich sind. Lévy- Prozesse sind flexibel haben jedoch nützliche Eigenschaften, die ihre Behandlung erleichtern, wie z.B. stationäre Inkremente. Grundidee der Arbeit war es, vorhandene Resultate für zeitdiskrete nicht-stationäre Modelle und zeitstetige stationäre Modelle so zu vereinen, dass ein neues zeitstetiges und nicht-stationäres Modell mit gut studierbaren Eigenschaften entsteht. Hierbei wurden Zustandsraummodelle verwendet, welche durch Matrizen charakterisiert werden, die die Eigenschaften des Modells bestimmen. Eine entscheidende Beweisidee beruht darauf, dass die Matrizen so transformiert werden können, dass ein Entkopplung in stationäre und nicht-stationäre Anteile erfolgt und die Benutzung der jeweils bekannten Resultate auf den zusammengesetzten Prozess möglich wird. Besonders wertvoll sind hier die entwickelten Schätzverfahren für kointegrierte Prozesse. In der Praxis haben die Zeitreihen meist einen ungefähren Gleichlauf über die Zeit, damit sind sie gemeinsam integriert, also kointegriert. Der Begriff Integration bedeutet, dass die nicht-stationären Zeitreihen durch Differenzenbildung auf neue stationäre Zeitreihen zurückgeführt werden können. Die Schätzmethode baut auf derMaximum-Likelihood-Schätzung auf, welches anschließend mit Hilfe eines numerisches Optimierungsverfahren gelöst wird. Für die Schätzmethode konnte die Konsistenz nachgewiesen werden, d.h. Schätzfolgen mit immer mehr Daten werden immer besser (Konvergenz in Wahrscheinlichkeit gegen wahren Wert). Referenzen C. Granger: Nobel Prize Lecture, 2003. R. Stelzer: CARMA Processes driven by Non-Gaussian Noise, TUM-IAS Primary Sources - Essays in Technology and Science, 1 no.1, 2012. E. Schlemm and R. Stelzer: Quasi maximum likelihood estimation for strongly mixing state space models and multivariate Lévy-driven CARMA pro

Primzahlen und Gruppen

Rebecca Waldecker ist Professorin für Algebra an der Martin-Luther-Universität Halle-Wittenberg. Sie besuchte Karlsruhe aus Anlass einer Konferenz zu Ehren von Richard Weiss und Gudrun nutzte die Gelegenheit, um mit ihr über das Faszinosum und die Nützlichkeit von Primzahlen und ihr Forschungsgebiet der Gruppentheorie zu sprechen. In der Vergangenheit gab es verschiedene Definitionen für Primzahlen, die sich über die Zeit zu dem heute gebräuchlichen geschärft haben: Eine Primzahl ist eine natürliche Zahl, die genau zwei verschiedene natürliche Teiler hat - sich selbst und 1.Die Zahl 1 ist damit keine Primzahl, aber z.B. ist die Zahl 2 prim sowie die Zahlen 3, 5, 7, 11, 13, 17, 19 usw. Ein grundlegendes Resultat besagt, dass sich alle natürlichen Zahlen eindeutig in Produkte von Primzahlen aufteilen lassen. Zahlen, die selbst nicht prim sind, nennt man deshalb zerlegbar bzw. zusammengesetzt, weil man sie mit Hilfe dieser Darstellung in die zugehörigen Primfaktoren aufteilen kann bzw. man diese als Grundbausteine der natürlichen Zahlen ansehen kann. Es gibt in diesem Zusammenhang viele interessante Fragen. Zum Beispiel: Wie viele Primzahlen gibt es? Gibt es beliebig große Primzahlzwillinge, d.h. zwei Primzahlen, die voneinander nur den Abstand 2 haben (wie z.B. 11 und 13)? Wie kann ich eine Zahl als Primzahl erkennen? Wie kann ich für jede Zahl (effektiv) die Zerlegung in Primfaktoren berechnen? Interessant ist, dass diese Fragen, die doch eher theoretisch und fast schon spielerisch wirken, heute eine große Relevanz erhalten, weil sich alle gebräuchlichen digitalen Verschlüsselungsverfahren (z.B. beim online-Banking) großer Primzahlen bedienen (je größere Primzahlen man verwenden kann, desto sicherer ist die zugehörige Verschlüsselung). Das liegt daran, dass es im Allgemeinen tatsächlich eine recht lange Rechenzeit braucht, um große Zahlen in mögliche Primfaktoren zu zerlegen. Wenn man sich jedoch davon löst, Primzahlen und Teiler nur auf natürliche Zahlen zu beziehen, wird die Welt noch ein wenig interessanter. Besonders einfach und fast offensichtlich ist es bei der Ausweitung auf ganze Zahlen. In den ganzen Zahlen gibt es mehr Teiler: Zum Beispiel hat die Zahl 3 dort (neben 3 und 1) auch noch die Teiler -1 und -3. Man muss dann entscheiden, welches die Grundbausteine für ganze Zahlen sein sollen. Noch etwas allgemeiner ausgedrückt: Wenn der Begriff der Primzahl auf andere Zahlbereiche verallgemeinert wird, dann gibt es zwei Eigenschaften, die man als charakterisch für "prim" ansehen kann: Einerseits die "Unzerlegbarkeit", also die Eigenschaft, nur die offensichtlichen Teiler zu besitzen. Primzahlen haben aber auch die Eigenschaft (im Bereich der ganzen Zahlen), dass, wenn sie ein Produkt von Zahlen teilen, sie automatisch mindestens einen der Faktoren teilen. Auch diese Eigenschaft kann man zur Verallgemeinerung der Eigenschaft "prim" benutzen. Häufig ist es so, dass in der Übertragung der Idee auf Objekte, die die Struktur eines algebraischen Rings haben (d.h. grob gesprochen, man "rechnet" in ihnen mehr oder weniger so, wie wir es von den ganzen Zahlen kennen) die Unzerlegbarkeit mit dem Begriff "irreduzibel" verallgemeinert wird und dass die andere Eigenschaft (wenn man ein Produkt teilt, dann auch mindestens einen der Faktoren) mit "prim" oder "Primelement" verallgemeinert wird. In manchen Zahlbereichen fallen diese Begriffe zusammen. Zum Beispiel ist das bei den ganzen Zahlen so und bei den im Gespräch erwähnten Ganzen Gaußschen Zahlen. Die Ganzen Gaußschen Zahlen werden aus allen Punkten mit ganzzahligen Koordinaten in der Gaußschen Zahlenebene gebildet. Diese Ebene ist eine geometrische Interpretation der Menge der komplexen Zahlen - die beiden Achsen geben Real- und Imaginärteil der jeweiligen komplexen Zahl an. Wählt man alle ganzzahligen Punkte, so ergibt das eine Struktur, die geometrisch betrachtet ein Gitter ist, und die algebraisch betrachtet den ganzen Zahlen nicht unähnlich ist. Allerdings wird die Multiplikation etwas interessanter, deshalb ändern sich die Eigenschaften von Primzahlen im Ring der Ganzen Gaussschen Zahlen. 2 ist dort keine Primzahl, sondern hat neben den offensichtlichen Teilern 2,-2,1,-1,i,-i,2i,-2i auch noch die Teiler 1+i, 1-i und noch einige mehr. Alle Primzahlen, die beim Teilen durch 4 in den Rest 3 lassen, bleiben prim in . Zum Beispiel 3, 7 und 11. Alle Primzahlen, die beim Teilen durch 4 in den Rest 1 lassen, sind nicht mehr prim in , sondern bekommen dort interessante zusätzliche Teiler. Das liegt daran, dass diese Zahlen sich als Summe von zwei Quadraten schreiben lassen. Streng genommen geht es hier nicht um die Eigenschaft, prim zu sein, sondern um die Eigenschaft, irreduzibel zu sein (siehe oben). Aber im Ring der Ganzen Gaussschen Zahlen fallen diese Begriffe zusammen. Wer sich dafür interessiert, findet beispielsweise beim Suchen mit den Stichworten Zwei-Quadrate-Satz von Fermat und Normfunktion bei den Ganzen Gaußschen Zahlen viele weitere Informationen und

Finanzen damalsTM

Auf der Gulasch Programmiernacht (GPN16) des Entropia e.V. in der Hochschule für Gestaltung und dem ZKM in Karlsruhe trafen sich Stephan Ajuvo und Sebastian Ritterbusch für einen Cross-Over Podcast vom damals TM Podcast und dem Modellansatz Podcast um über die Geschichte von Finanzen und Mathematik zu plaudern. Der damalsTM Podcast befasst sich damit, wie es kam, dass es kam, so dass es ist, wie es ist- und hatte in der letzten Zeit schon eine Reihe zu Geld (Geld I, Geld II, Geld III), wo die Entwicklung der Zahlungsmittel bisher bis zum 2. Weltkrieg behandelt wurden. Die Ökonomie zählt zu den Sozialwissenschaften, die oft Theorien auf Annahmen behandeln, während die Mathematik als Geisteswissenschaft sich gerne auch mal sehr exakt mit Theorien fernab der Realität befassen kann. Die Kryptographie ist jedoch ein schönes Beispiel, wie aus abstrakten mathematischen Theorien der Algebra und der Zahlentheorie plötzlich sehr reale Anwendungen aus unserem Alltag wurden. Mit Kryptoanalyse konnte man sowohl einfache Transpositionschiffren als auch die Enigma durch mathematische Verfahren knacken. Bevor vereinheitlichte Geldeinheiten eingeführt wurden, waren schon früh Objekte mit Geldfunktion eingesetzt, wo oft die Seltenheit und Wertigkeit des Materials schon für sich einen gewissen Wert sicherte. Ebenso früh kam es zu Geldversprechen wie dem Agrarkredit (zurück bis hin zum Codex Hammurapi), mit denen jetzige Ausgaben durch versprochene spätere Erntegewinne beglichen werden konnten. Dies führte zum Konzept des Zinses, mit dem das Verlustrisiko durch Ausfall und die erst spätere Zugängigkeit des Geldes bewerten kann. Das Größenordnung des Zehnt war gesellschaftlich zwar als Steuer akzeptiert, wurde jedoch als Zins schnell als Wucher gesehen, da der Zinseszins sehr schnell anwuchs. Daraus entstand auch die Gegenbewegung des Zinsverbots, das auch heute noch im Islamischen Bankwesen zu Umgehungsgeschäften führt. Die mit Geldgeschäften oft assoziierten Geldwechsler hatten als Arbeitsmittel eine Bank, die namensgebend für unsere heutigen Banken ist, und woran das Wort bankrott auch heute noch erinnert. Neben astronomischen Berechnungen, wie der Berechnung des Osterfests, war die Geldwirtschaft früh ein großes Anwendungsfeld für die Mathematik. Ein wichtiges Berechnungsmodell waren die Abzinsung und die Zinsformel, mit der man die Werte zwischen jetzt und in Zukunft unter Berücksichtigung des Zinses umrechnen konnte. Hier war das exponentielle Wachstum der Kreditentwicklung unter Zinseszinsen für viele nicht zu übersehen. Aber selbst, wenn man diese Berechnung beherrschte, so gab es das Zinsänderungsrisiko, das besonders bei langfristigen Verträgen zu erheblichen Änderungen zu den Kalkulationen führen konnte. Verschiedene Zinssätze verschiedener Landesherren führte auch unmittelbar zu unterschiedlichen Wechselkursen zwischen den lokalen Währungen der Landesherren. Zusätzlich gab es schon früh den Effekt der Teuerung oder Inflation oft durch unkontrolliertes Geldmengenwachstum. Ein Beispiel ist hier die Inflation durch die Entdeckung Amerikas. Es war damals noch nicht klar, wie der tatsächliche Wert des Geldes auch durch einen Warenkorb identifiziert werden kann. Ein sehr grobes aber dafür sehr leicht zugängiges aktuelles Indiz für den Wert verschiedener Währungen ist der Big-Mac Index. Aus der Anforderung des waren- und ortsübergreifenden Handels wurden die Börsen geboren: Hier konnten Waren und Währungen im Jetzt, aber auch in der Zukunft in Termingeschäften gehandelt werden. Schnell etablierte sich hier auch die Spekulation, die über Risikoübernahme zu einem wichtigen Bestandteil der Wirtschaft wurde. Ein bekanntes Beispiel für eine Fehlentwicklung ist die Tulpenkrise, bei der es zu einer Finanzblase bis hin zum Börsencrash kam, und exemplarisch für spätere Immobilienblasen wurde. Die Effekte konnten durch Hebeleffekte noch verstärkt werden, wenn Fremdkapital für mehr erwartete Rendite eingesetzt wurde. Eine Renditebetrachtung ist auch für die persönliche Finanzplanung sehr wichtig- so sollte jeder die Altersvorsorge frühzeitig angehen und dabei Risikoklassen und die Diversifikation zur Risikoverteilung beachten. Aus der Erfahrung, dass viele Finanzprodukte und Anlageberater die zugrunde liegenden Indices oft nur in der Vergangenheit schlagen, haben sich Finanzcommunities wie The Motley Fool gebildet, um sich gegenseitig zu informieren. Mathematisch kann man die Optimalität einer Investition auch als Multikriterielle Optimierung zwischen Rendite und Risiko im Sinne der Volatilität verstehen: Hier stellt sich heraus, dass hier zwischen den Kriterien abgewogen werden muss, und es nicht ein Optimum gibt, sondern die Linie der Pareto-Optimalität. Jedoch darf man nicht einfach aus der vergangenen Entwicklung auf Rendite und Risiko schließen: Gerade Ponzi-Systeme scheinen eine hohe Rendite bei geringer Volatilität und Risiko zu liefern, wo die Zinsen früherer Anleger nur durch die Investitionen durch angelockte Neuanleger bez

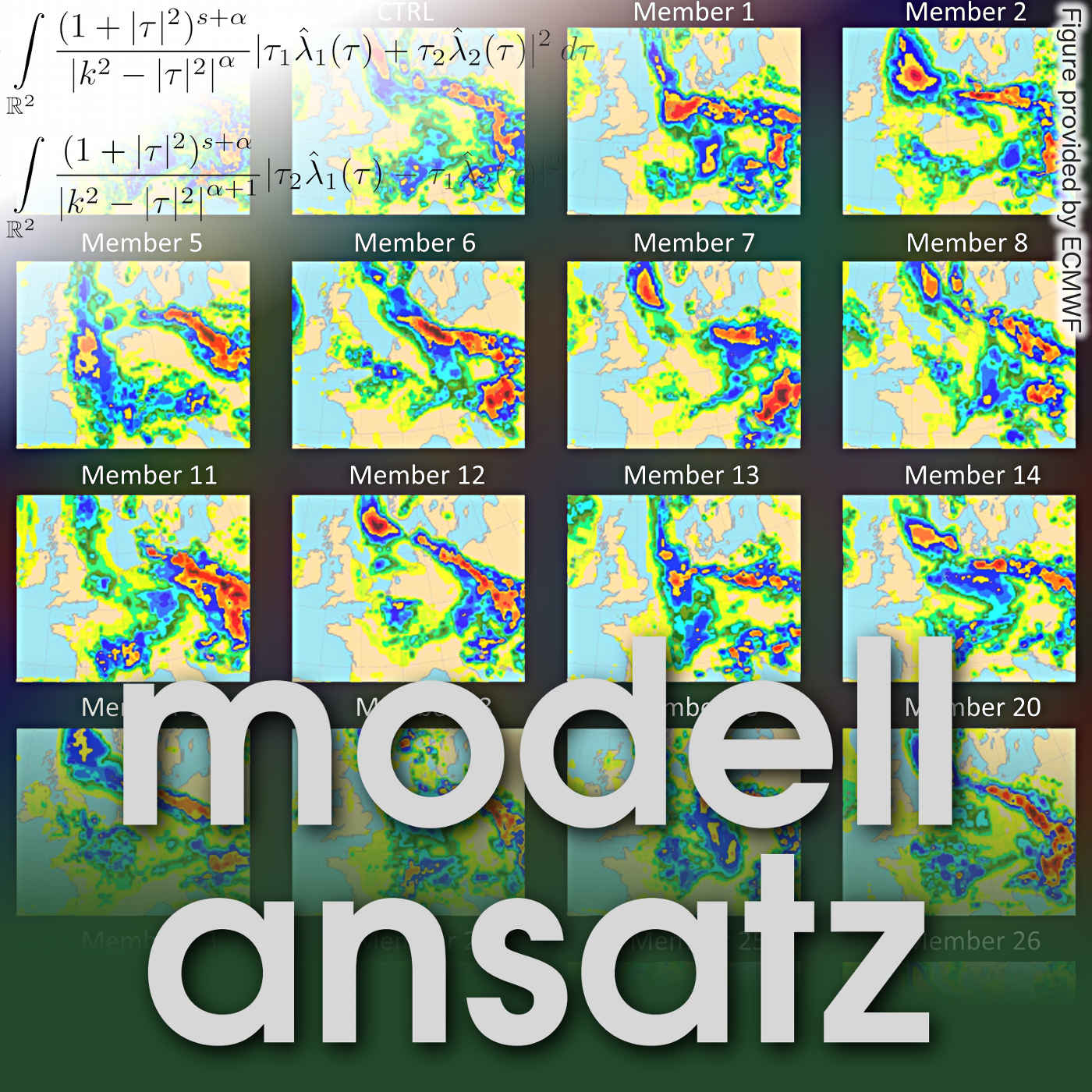

Ensemblevorhersagen

Stephan Hemri hat an der ETH in Zürich einen Bachelorstudiengang Umweltwissenschaften absolviert und sein Studium mit einem Master in Statistik abgerundet. Seine Masterarbeit entstand an der Eidgenössischen Forschungsanstalt für Wald, Schnee und Landschaft (WSL). Hierbei hat er auch statistisches Postprocessing kennengelernt. Mit diesem Wissen und dem vorhandenen Interesse übernahm er ein Promotionsthema von Tilmann Gneitling am Lehrstuhl für Computational Statstics an der KIT-Fakultät für Mathematik und am Heidelberger Institut für Theoretische Studien. Zu den Höhepunkten dieser Zeit zählt er die vier Monate, die er am Europäischen Wetterzentrum (Zentrum für Mittelfristprognose) in Reading mitforschen konnte. Schon seit langem werden für die Wettervorhersage numerische Modelle eingesetzt. Dabei werden Größen wie zum Beispiel Temperatur und Niederschlag auf einem globalen 3-dimensionale Gitter durch das Lösen von großen gekoppelten und nichtlinearen Gleichungssystemen bestimmt, die aus physikalischen Modellen hergeleitet sind, nach denen sich Luftmassen und Wasser in der Atmosphäre in etwa bewegen und dabei unser Wetter erzeugen. Ebenso wichtig - wenn auch weniger bekannt - sind hydrologische Vorhersagen zu Pegelständen an Flüssen, die mit ähnlichen Methoden für einige Zeit im voraus berechnet werden. Zu Beginn waren die damit verbundenen Rechnungen rein deterministisch, was den großen Nachteil hatte, dass die Ergebnisse der Modellläufe nichts über Unsicherheiten der Vorhersage aussagen konnten. Eine Idee, um Ungenauigkeiten der Modellrechnungen zu bestimmen, ist zu Ensemblevorhersagen überzugehen. Das heißt, man berechnet nicht nur eine Vorhersage, sondern mehrere Modelläufe, jeweils zu abgeänderten (gestörten) Anfangsbedingungen oder mit verschiedenen Modellen, um zu sehen, wie stark sie sich in den Ergebnissen unterscheiden. Sind sich die verschiedenen Rechnungen weitestgehend einig, ist die Vorhersage recht sicher zutreffend. Weichen sie stark voneinander ab, sind sie entsprechend wenig sicher. Die Datenlage in der Wettervorhersage ist sehr gut. Insofern, kann man natürlich im Nachgang immer abgleichen, inwiefern Vorhersagen eingetroffen sind und dies zur Verbesserung der Modelle benutzen. Aber trotzdem bleiben konkrete Aussagen wie z.B. Hochwasservorhersagen oder Vorhersagen zu Pegeln anhand von Niederschlags-Daten sehr schwierig, weil die Modelle nicht ausgereift sind und die Verbesserung nicht auf der Hand liegt. Zum Beispiel am Europäischen Wetterzentrum in Reading ist derzeit ein Ensemble bestehend aus 51 Modellenvarianten verfügbar. Zusammen mit einem deterministischen Modell höherer Auflösung, führt dies zu einem recht großen Ensemble von Vorhersagen. In der statistischen Nachbearbeitung (dem Postprocessing) wird vor allem nach systematischen Fehlern Ausschau gehalten. Dabei werden bedingte Wahrscheinlichkeits-Vorhersagen auf das Ensemble bezogen und parametrische Dichtefunktionen erzeugt. Als Trainingsperiode werden dabei z.B. die letzten 30 Tage gewählt. Bei hydrologischen Abschätzungen sind jahreszeitliche Trainingsperioden (gleiche Jahreszeiten, aber andere Jahre) häufig sehr hilfreich. Dieses Vorgehen führt in der Regel zu einer besseren Schätzung des zukünftigen Wetters und Pegelständen. Für die Temperatur kann man sich das Vorgehen am einfachsten vorstellen: Es gibt einen Ensemble-Mittelwert, dessen Fehler in etwa normalverteilt ist. Bei der Nachbearbeitung wird z.B. der Mittelwert-Parameter an den Mittelwert des Ensembles in linearer Weise angepasst. Auch die Varianz ist in erster Näherung eine lineare Funktion der Varianz des Ensembles. Das ist ein sehr einfaches Modell, aber schon hilfreich. Zwei grundlegende Ideen gehen in der Parameterschätzung ein. Zum einen nichthomogene Regression, die gut verstanden aber nicht so flexibel ist - zum anderen Baysean Model averaging. Über allen statistischen Verfahren und Verbesserungen bleibt jedoch auch die Forderung, dass die Nutzbarkeit der Ergebnisse für den Endnutzer gegeben sein muss. Deshalb wird - gerade bei Wasserstandsvorhersagen - manchmal dann doch nur ein zu erwartender Pegelstand übermittelt ohne alle im Prozess gewonnenen Erkenntnisse über mögliche Abweichungen von diesem approximativen Wert mitzuteilen. Literatur und weiterführende Informationen Cloke, H. L. and F. Pappenberger (2009). Ensemble flood forecasting: a review. Journal of Hydrology 375, 613--626. Gneiting, T., A. E. Raftery, A. H. Westveld, and T. Goldman (2005). Calibrated probabilistic forecasting using ensemble model output statistics and minimum CRPS estimation. Monthly Weather Review 133, 1098--1118. Raftery, A. E., T. Gneiting, F. Balabdoui, and M. Polakowski (2005). Using Bayesian model averaging to calibrate forecast ensembles, Monthly Weather Review 133, 1155--1174. Thorarinsdottir, T. L. and T. Gneiting (2010). Probabilistic forecasts of wind speed: ensemble model output statistics by using heteroscedastic censored regression, Journal of the Royal Statistical So

Probabilistische Robotik

Einen fahrbaren Roboter zu bauen- das ist schon eine echte Herausforderung. Um diesem aber auch noch beizubringen autonom Aufgaben zu lösen, bedienten sich Michael Fürst und sein Team der Mathematik: Im Rahmen der Gulasch Programmier-Nacht (GPN16) des Entropia e.V. in der Hochschule für Gestaltung (HfG) und dem Zentrum für Kunst und Medien (ZKM) in Karlsruhe berichtete er über die Verfahren der Probabilistischen Robotik (Video) und welche Erfahrungen sie damit machen konnten- und erzählt uns im Gespräch mit Sebastian Ritterbusch davon. Michael Fürst studiert Informatik am Karlsruher Institut für Technologie (KIT) und befasst sich im Team Informatik der Hochschulgruppe Kamaro Engineering speziell mit robusten probabilistischen Methoden zur Entscheidungsfindung. Der aktuelle Roboter Beteigeuze der Hochschulgruppe ist die zweite Generation und wurde dafür ausgelegt, Aufgaben in der Überwachung und Bewirtschaftung von Maisfeldern oder der Navigation im urbanen Umfeld zu erfüllen. Die Hochschulgruppe gibt es seit 3 Jahren und besteht aus 30-45 Mitgliedern. Sie ist eingebettet in das Teilinstitut Mobile Arbeitsmaschinen (MOBIMA) am Institut für Fahrzeugsystemtechnik (FAST) am KIT mit dessen Unterstützung und Drittspenden sich die Hochschulgruppe finanziert. Die interdisziplinäre Hochschulgruppe besteht aus vier Teams: Das Organisationsteam, das Mechanik-Team, das Elektrotechnik-Team und das Informatik-Team. Die Gruppe organisiert sich auch als Verein mit Vorstand und einer Leitung in jedem Team, um mit einer flachen Hierarchie jedem die Möglichkeit zu bieten sich in das Projekt einzubringen. Auf der einen Seite will die Gruppe die autonome Robotik voranzubringen und allen Teammitgliedern gleichzeitig auch die Möglichkeit zu bieten, praktisches Wissen und Erfahrungen neben dem oft theoretischem Studium zu erlangen. Das Team nimmt dazu regelmäßig an verschiedenen internationalen Wettbewerben teil, wie dem Field Robot Event, dem SICK Robot Day oder der Robotour. Technisch basiert die Software-Lösung des Roboters inzwischen auf dem Robot Operating System (ROS), mit dem auf einer Ubuntu-Plattform auf einem im Roboter eingebauten Computer in Java, Python oder C++ die gestellten Aufgaben bearbeitet werden. Mit 40kg Gewicht ist der Roboter für seine Größe kein Leichtgewicht und kann daher nicht beliebig Batterien transportieren, so dass dem Lademanagement eine besondere Rolle zufällt. Die gewählte Größe ermöglicht gerade bei der Feldarbeit einen nicht-invasiven Ansatz, der im Vergleich zu anderen Varianten, wie der automatischen Steuerung von Traktoren, die Pflanzen nicht schädigt. Der Roboter erfasst seine Umwelt mit einer Vielzahl von Sensoren: Die Lidar-Sensoren zur Entfernungsmessung in verschiedenen Richtungen sind dabei besonders wichtig, und sie messen bis zu 50mal pro Sekunde. Sie bestimmen die Entfernungen zur Umgebung des Roboters in einer Ebene bis 16m in einer Auflösung von bis zu drei Messpunkten pro Winkel-Grad und 3cm Entfernungsauflösung- mit gewissen Fehlerraten und Problemen mit reflektierenden Oberflächen. Zusätzlich misst eine intertiale Messeinheit translative und radiale Beschleunigungen wie auch die Ausrichtung zum Erdmagnetfeld. Zusätzlich können auch digitale Kameras zur Detektion von befahrbaren Untergründen, Objekten oder zur Analyse von Pflanzen eingebaut und verwendet werden. Zusätzlich messen Radencoder die Umdrehungen und Auslenkung durch Servos der Räder, womit der Roboter durch Odometrie seine durchgeführte Bewegung aus sich selbst heraus abschätzt. Durch die Kombination der Lidar-Daten mit der Odometrie durch ein SLAM-Verfahren (Simultaneous Localization and Mapping) ermöglicht mit einem Kalman-Filter durch Analyse der Kovarianzen die robuste Erstellung einer Karte während des Befahrens, und korrigiert Fehler bei der eigenen Lokalisierung durch die Odometrie. Zusätzlich kann der Roboter mit einem GPS-Empfänger seine Position grob bestimmen. In der Auswertung der Sensoren wird zwar von einer guten Kalibrierung ausgegangen, jedoch ist es Teil des probabilistischen Ansatzes, die erfassten Werte immer mit einer konservativen Fehlerverteilung zu verarbeiten. Die Kamerabilder werden ebenso robust verarbeitet: Die Bilddaten werden nach einer Konvertierung in den HSV-Farbraum zunächst auf eine konstante Helligkeit gebracht, um Schatteneffekte zu reduzieren. Dann werden alle weniger farbigen Pixel als befahrbarer Weg markiert, und die Anzahl der befahrbaren Pixel pro Spalte in ein Histogramm zusammengeführt. Jeder Wert in dem Histogramm wird nun als Güte bzw. der Wahrscheinlichkeit für Fahrbahn in diese Richtung gewertet. Die GPS-Position wird zur Lokalisierung in der Open Street Map verwendet, wo nach Berechnung einer Route die aktuelle Zielfahrtrichtung bestimmt wird. Die eigentliche Entscheidungsfindung erfolgt dann auf Basis der verschiedenen Sensordaten durch die Berechnung von Erwartungswerten in Abhängigkeit von einer möglichen Fahrtrichtung. Genauer betrachtet werden für jeden Sensor Ziel

Banach-Tarski Paradox

Nicolas Monod teaches at the École polytechnique fédérale in Lausanne and leads the Ergodic and Geometric Group Theory group there. In May 2016 he was invited to give the Gauß lecture of the German Mathematical Society (DMV) at the Technical University in Dresden. He presented 100 Jahre Zweisamkeit – The Banach-Tarski Paradox. The morning after his lecture we met to talk about paradoxes and hidden assumptions our mind makes in struggling with geometrical representations and measures. A very well-known game is Tangram. Here a square is divided into seven pieces (which all are polygons). These pieces can be rearranged by moving them around on the table, e.g.. The task for the player is to form given shapes using the seven pieces – like a cat etc.. Of course the Tangram cat looks more like a flat Origami-cat. But we could take the Tangram idea and use thousands or millions of little pieces to build a much more realistic cat with them – as with pixels on a screen. In three dimensions one can play a similar game with pieces of a cube. This could lead to a LEGO-like three-dimensional cat for example. In this traditional Tangram game, there is no fundamental difference between the versions in dimension two and three. But in 1914 it was shown that given a three-dimensional ball, there exists a decomposition of this ball into a finite number of subsets, which can then be rearranged to yield two identical copies of the original ball. This sounds like a magical trick – or more scientifically said – like a paradoxical situation. It is now known under the name Banach-Tarski paradox. In his lecture, Nicolas Monod dealt with the question: Why are we so surprised about this result and think of it as paradoxical? One reason is the fact that we think to know deeply what we understand as volume and expect it to be preserved under rearrangements (like in the Tangram game, e.g.).Then the impact of the Banach-Tarski paradox is similar for our understanding of volume to the shift in understanding the relation between time and space through Einstein's relativity theory (which is from about the same time). In short the answer is: In our every day concept of volume we trust in too many good properties of it. It was Felix Hausdorff who looked at the axioms which should be valid for any measure (such as volume). It should be independent of the point in space where we measure (or the coordinate system) and if we divide objects, it should add up properly. In our understanding there is a third hidden property: The concept "volume" must make sense for every subset of space we choose to measure. Unfortunately, it is a big problem to assign a volume to any given object and Hausdorff showed that all three properties cannot all be true at the same time in three space dimensions. Couriously, they can be satisfied in two dimensions but not in three. Of course, we would like to understand why there is such a big difference between two and three space dimensions, that the naive concept of volume breaks down by going over to the third dimension. To see that let us consider motions. Any motion can be decomposed into translations (i.e. gliding) and rotations around an arbitrarily chosen common center. In two dimensions the order in which one performs several rotations around the same center does not matter since one can freely interchange all rotations and obtains the same result. In three dimensions this is not possible – in general the outcomes after interchanging the order of several rotations will be different. This break of the symmetry ruins the good properties of the naive concept of volume. Serious consequences of the Banach-Tarski paradox are not that obvious. Noone really duplicated a ball in real life. But measure theory is the basis of the whole probability theory and its countless applications. There, we have to understand several counter-intuitive concepts to have the right understanding of probabilities and risk. More anecdotally, an idea of Bruno Augenstein is that in particle physics certain transformations are reminiscent of the Banach-Tarski phenomenon. Nicolas Monod really enjoys the beauty and the liberty of mathematics. One does not have to believe anything without a proof. In his opinion, mathematics is the language of natural sciences and he considers himself as a linguist of this language. This means in particular to have a closer look at our thought processes in order to investigate both the richness and the limitations of our models of the universe. References: F. Hausdorff: Bemerkung über den Inhalt von Punktmengen. Math. Ann. 75 (3), 428–433, 1914. S. Banach and A.Tarski: Sur la décomposition des ensembles de points en parties respectivement congruentes, Fundamenta Mathematicae 6, 244–277, 1924. J. von Neumann: Zur allgemeinen Theorie des Maßes Fundamenta Mathematicae 13, 73–116, 1929. S. Wagon: The Banach–Tarski Paradox. Cambridge University Press, 1994. B.W. Augenstein: Links Between Physics and Set Theory, Chaos, Soli

Verkehrsmodellierung I

Peter Vortisch bekleidet seit 2010 eine Professur für Verkehrswesen am Karlsruher Institut für Technologie (KIT) und ist Leiter des Instituts für Verkehrswesen. Wir haben über die Entwicklung der Modellierung von Verkehr gesprochen und dabei den Schwerpunkt zunächst auf die Anfangszeit gelegt, in der sich die in der Forschung geborene Idee Schritt für Schritt in ein Softwareprodukt entwickelte und wo und warum sich die Idee und das Produkt durchsetzen konnten. Peter Vortisch hat in Karlsruhe eigentlich Informatik studiert und kam zum Verkehrswesen zunächst als wissenschaftliche Hilfskraft. Er hat dann bald mit an den ersten Simulationen programmiert. Solche Simulationen wurden damals auf Großrechnern durchgeführt, von denen es nur wenige gab. Die Forschungen und theoretischen wie praktischen Überlegungen wurden im wesentlichen von Professor Wiedemann vorangetrieben. Seine Karlsruher Gruppe war die erste, die das in Deutschland erfolgreich erprobte und schließlich als Standard eingeführt hat. Es gab damals Forschungsprojekte z.B. zur Wirkung von Tempolimits im Auftrag des Verkehrsministeriums. In der Zwischenzeit entwickelte sich die Rechentechnik weiter und mit dem Siegeszug des PCs wanderte die Simulation vom Rechenzentrum auf die Schreibtische. Damals war es möglich, auf so einem Rechner ein Modell mit etwa 20 Fahrzeugen in Echtzeit zu simulieren - heut sind die Rechner so viel schneller, dass mehrere 100.000 Fahrzeuge möglich sind. Aber auch mit so wenigen Fahrzeugen war es ein wichtiger Schritt hin zur Kommerzialisierung der Verkehrsmodelle. In den USA gab es damals z.B. ein öffentlich subventioniertes Produkt für Verkehrsplaner, was einen durchschlagenden Erfolg hatte und die Simulation in allen Büros etablierte. In Karlsruhe entwickelte sich ein Spin off aus dem Institut, die Firma ptv entwickelte das Produkt und die Vermarktung der Verkehrssimultion zunächst in Deutschland. Seither besteht eine enge Zusammenarbeit mit dem Institut für Verkehrswesen. Im Zuge dieser Professionalisierung wurde die Verwendung des Produktes durch Verkehrsingenieure der neue Standard. Es gab zwei große deutsche Unternehmen, die die Entwicklung der Software stark beschleunigt haben. Zunächst die Firma SIEMENS weil sie die Wirkung von Ampelsteuerungen besser vorhersehen wollte. U.a. auch im Zusammenhang mit der Grün-Anforderung durch den ÖPNV. Vor dem Aufbau auf einer echter Kreuzung sollte die Simulation auf dem Rechner beweisen, dass auch der gewünschte Effekt durch die Ampelsteuerung erreicht werden würde. Das wurde schließlich sogar Teil der SIEMENS Software Verkehrsplanung. Verkehrsplaner in den Städten haben in dieser Zeit weitergehende Ideen noch nicht so gut angenommen. Dafür war dann die Firma Volkswagen ein Vorreiter. Sie hat sich eigentlich für Abgasemissionen interessiert, wofür man Temperaturverläufe der Motoren braucht. Es wurde daraus die Aufgabe abgeleitet, für eine ganze Stadt den Verkehr über den Tag hinweg zu simulieren (inkl. parken). Sie haben sich in großem Umfang finanziell an den Entwicklungsarbeiten beteiligt. Prototyp wurde die Stadt Braunschweig. Ohne die heute selbstverständlich vorliegenden Daten zu Straßen und Kreuzungen war das ein sehr aufwändiges Vorhaben. Außerdem brauchte man neue Verfahren, die entscheiden, welche Wege die Fahrzeuge in der Stadt zurücklegend. Ein wichtiges neues Verfahren hierfür wurde die Dynamische Umlegung. Diese neue Fähigkeit des Programms hat zu einer deutlich weiteren Verbreitung geführt, denn es war nun ein wirklich professionelles Softwareprodukt auf dem Markt in Deutschland vorhanden. Der Funktionsumfang des ptv-Produktes war schließlich größer als das des USA-Standards. Da dort Verkehrssimulation aber schon Usus war, war es einfach mit dem noch besseren Produkt in den US-Markt einzusteigen. Ein weiterer wichtiger Markt war auch Großbritannien, da dort traditionell bei Planungen viel modelliert wird ("Mutterland der Modellierung"). Dort war der Einstieg geschafft, als sich Transport for London entschied, mit dem ptv-Produkt zu arbeiten. Podcasts und Videos PTV Youtube-Kanal U. Leyn: Verkehrswesen, Gespräch mit G. Thäter im Modellansatz Podcast, Folge 88, Fakultät für Mathematik, Karlsruher Institut für Technologie (KIT), 2016. http://modellansatz.de/verkehrswesen K.Nökel: ÖPNV, Gespräch mit G. Thäter im Modellansatz Podcast, Folge 91, Fakultät für Mathematik, Karlsruher Institut für Technologie (KIT), 2016. http://modellansatz.de/oepnv

Viscoelastic Fluids

This is the second of four conversations Gudrun had during the British Applied Mathematics Colloquium which took place 5th – 8th of April 2016 in Oxford. Helen Wilson always wanted to do maths and had imagined herself becoming a mathematician from a very young age. But after graduation she did not have any road map ready in her mind. So she applied for jobs which - due to a recession - did not exist. Today she considers herself lucky for that since she took a Master's course instead (at Cambridge University), which hooked her to mathematical research in the field of viscoelastic fluids. She stayed for a PhD and after that for postdoctoral work in the States and then did lecturing at Leeds University. Today she is a Reader in the Department of Mathematics at University College London. So what are viscoelastic fluids? If we consider everyday fluids like water or honey, it is a safe assumption that their viscosity does not change much - it is a material constant. Those fluids are called Newtonian fluids. All other fluids, i.e. fluids with non-constant viscosity or even more complex behaviours, are called non-Newtonian and viscoelastic fluids are a large group among them. Already the name suggests, that viscoelastic fluids combine viscous and elastic behaviour. Elastic effects in fluids often stem from clusters of particles or long polymers in the fluid, which align with the flow. It takes them a while to come back when the flow pattern changes. We can consider that as keeping a memory of what happened before. This behaviour can be observed, e.g., when stirring tinned tomato soup and then waiting for it to go to rest again. Shortly before it finally enters the rest state one sees it springing back a bit before coming to a halt. This is a motion necessary to complete the relaxation of the soup. Another surprising behaviour is the so-called Weissenberg effect, where in a rotation of elastic fluid the stretched out polymer chains drag the fluid into the center of the rotation. This leads to a peak in the center, instead of a funnel which we expect from experiences stirring tea or coffee. The big challenge with all non-Newtonian fluids is that we do not have equations which we know are the right model. It is mostly guess work and we definitely have to be content with approximations. And so it is a compromise of fitting what we can model and measure to the easiest predictions possible. Of course, slow flow often can be considered to be Newtonian whatever the material is. The simplest models then take the so-called retarded fluid assumption, i.e. the elastic properties are considered to be only weak. Then, one can expand around the Newtonian model as a base state. The first non-linear model which is constructed in that way is that of second-order fluids. They have two more parameters than the Newtonian model, which are called normal stress coefficients. The next step leads to third-order fluids etc. In practice no higher than third-order fluids are investigated. Of course there are a plethora of interesting questions connected to complex fluids. The main question in the work of Helen Wilson is the stability of the flow of those fluids in channels, i.e. how does it react to small perturbations? Do they vanish in time or could they build up to completely new flow patterns? In 1999, she published results of her PhD thesis and predicted a new type of instability for a shear-thinning material model. It was to her great joy when in 2013 experimentalists found flow behaviour which could be explained by her predicted instability. More precisely, in the 2013 experiments a dilute polymer solution was sent through a microchannel. The material model for the fluid is shear thinning as in Helen Wilson's thesis. They observed oscillations from side to side of the channel and surprising noise in the maximum flow rate. This could only be explained by an instability which they did not know about at that moment. In a microchannel inertia is negligible and the very low Reynolds number of suggested that the instability must be caused by the non-Newtonian material properties since for Newtonian fluids instabilities can only be observed if the flow configuration exeeds a critical Reynolds number. Fortunately, the answer was found in the 1999 paper. Of course, even for the easiest non-linear models one arrives at highly non-linear equations. In order to analyse stability of solutions to them one firstly needs to know the corresponding steady flow. Fortunately, if starting with the easiest non-linear models in a channel one can still find the steady flow as an analytic solution with paper and pencil since one arrives at a 1D ODE, which is independent of time and one of the two space variables. The next question then is: How does it respond to small perturbation? The classical procedure is to linearize around the steady flow which leads to a linear problem to solve in order to know the stability properties. The basic (steady) flow allows for

ÖPNV

Klaus Nökel arbeitet in der Firma ptvgroup an der Verkehrsmodellierung. Er war und ist an vielen Aspekten der Entwicklung der ptv-Software beteiligt. Einer seiner Schwerpunkte sind Modelle für den öffentlichen Nahverkehr - kurz ÖPNV. Oft kann man nur mit geeigneten Modellen und Simulationen den für Fördergelder erforderlichen Nachweis über einen zu erwartenden Nutzen von Baumaßnahmen erbringen. In Karlsruhe ist der Tunnel für die Straßenbahnen (in Karlsruhe kurz UStrab genannt) ein prominentes Beispiel einer solchen Großbaustelle. Die wichtigste Fragen zum erwarteten Nutzen, ist wie sich die Reisezeit verkürzt: Der Kosten-Nutzen-Quotient sollte hier natürlich möglichst klein sein. Die gesamten Baukosten sind dabei relativ einfach zu ermitteln. Die Nutzen-Seite ist dagegen nicht so einfach zu schätzen. Man braucht dafür ja Zahlen darüber, was für die Fahrgäste (quantifizierbar) besser wird- insbesondere im Bezug auf Zeiteinsparung. Um diese Frage beantworten zu können, muss für alle Einwohner eine Routenplanung für jeden Tag durchgeführt werden. In Bezug auf ÖPNV sind dies insbesondere die Mobliltätsentscheidungen zwischen Weg zu Fuß, mit dem Auto oder Fahrrad und dem ÖPNV. Das betrifft vor allem die Wege zur Arbeit, zu Freizeitaktivitäten und zum Einkaufen. Die Wohn- und Arbeitsorte liegen hier über längere Zeit fest - alle anderen Größen sind jedoch variabel und Entscheidungen wo man beispielsweise einkaufen geht, können sich mit besserer Erreichbarkeit verändern. Hier muss aufgrund vorliegender Informationen zu Wegen in der Stadt die Wahl des Verkehrsmittels modelliert werden und welche Route mit welchem Verkehrsmittel typischerweise gewählt wird. Die Frage ist dann, ob es zu Verschiebungen in der Verkehrsmittelwahl kommen wird, nachdem sich die Infrastruktur geändert hat (wie z.B. durch den Tunnel bei uns in Karlsruhe). Die Angebotsseite ist vergleichsweise einfach zu beschreiben: Verkehrsnetz(e) wie Straßen und Liniennetz des ÖPNV mit zugehörigem Fahrplan sind bekannte Daten. Die Kenntnisse über die Nachfrage sind komplex und setzen sich aus verschiedenen Anteilen zusammen. Ein gut verstandener Teil hier ist der soziodemographische z.B. ob ein Auto zur Verfügung oder nicht. Typischerweise haben junge Leute auf dem Weg zur Schule oder in die Ausbildung kein Auto zur Verfügung. Ebenso kann man gut beschreiben, wo gewohnt, gearbeitet und typischerweise eingekauft wird. Die Frage, welche Wege zurückgelegt werden, wird nicht wirklich gezählt oder genau ermittelt, sondern modelliert. Dabei sind viele Fragen nicht eindeutig beantwortbar. Manches sind auch ganz persönliche Vorlieben, so wie verschiedene Personen höhere Wegekosten gegenüber höherer Wegezeit sehr unterschiedlich gewichten. Eine typische Datenbeschaffungsmethode ist bisher, Menschen über einen gewissen Zeitraum Tagebuch zu ihren Mobilitätsentscheidungen führen zu lassen. Zusätzlich zu den so dokumentierten und hochgerechneten Entscheidungen müssen für das Modell als Vergleich auch noch mögliche Alternativen zu diesen Entscheidungen mit berechnet werden (inklusive Zeit- und Geldaufwand). Als mathematische Methode bietet sich ein Discrete Choice Modell an, denn es geht um endlich viele Alternativen zwischen denen gewählt wird. Es gibt darin einige objektive Anteile der persönlichen Nutzenfunktion und einen unbeobachtbaren Teil der Nutzenfunktion, der üblicherweise durch eine Wahrscheinlichkeitsverteilung im Modell realisiert werden kann und muss. Statistik insbesondere die Schätztheorie hilft bei der Bestimmung der Wahrscheinlichkeitsverteilungen aus vorliegenden Entscheidungen. Das Gewicht für das "Rauschen" ist eine Unbekannte im Modell. Je nach Standort für den das Modell entwickelt wird, unterscheidet sich das tatsächlich. In den letzten Jahren hat sich die Anzahl der Wahlmöglichkeiten für Mobilität durch verschiedene Sharing-Modelle außerdem stark erweitert, wie z.B. durch Carsharing oder Fahrrad-Leihe, die inzwischen auch niederschwellig und sehr flexibel geworden sind. Vor allem in Kombination mit herkömmlichen Transportmitteln liegt ein großes Potential, das gerade erschlossen wird (z.B. haben zur Zeit etwa 600 Städte in der Welt ein Leihfahrrad-System). Es wäre einfacher, wenn die Benutzung noch klarer standardisiert wäre und eine Benutzerführung so einfach wie in einer typischen App erfolgte. Sinnvoll und wünschenswert wären natürlich ausführliche Vorher-nachher-Untersuchungen, um die Güte der Vorhersagen der Modelle zu prüfen und auch zu verbessern. Bisher war das meist zu teuer, aber das ändert sich gerade, weil Datenmengen aus Smartphones nutzbar und einfach auswertbar werden. Zum Glück gibt es hier keine Berührung der Privatsphäre, weil nur anonyme Angaben aus großen Mengen von Bewegungsprofilen gebraucht werden aus denen keine Rückschlüsse auf einzelne Personen möglich sind. Die Städte versuchen für ihre Einwohner die Erreichbarkeits-Gerechtigkeit zu verbessern. Hier vereinfachen die neuen Verkehrsmittel potentiell das Problem der let

Fußgängermodelle

Dr. Tobias Kretz arbeitet in der Firma PTV Group in Karlsruhe an der Modellierung und Simulation von Fußgängerströmen. Er studierte Physik an der Universität Karlsruhe und behandelte in seiner Diplomarbeit Teilchen-Zerfallsprozesse. Anschließend führte ihn die Suche nach interessanten Anwendungen physikalischer Konzepte zur Arbeitsgruppe Physik von Transport und Verkehr an der Universität Duisburg-Essen. Dort promovierte er im Themenfeld der Fußgängersimulation bei Prof. Schreckenberg. Damit war er genau der Experte, den die ptv suchte, als sie sich entschied, die Verkehrssimulations-Software im Haus um den Aspekt der Fußgängersimulation zu erweitern. Eine erste für Karlsruhe interessante Anwendung der neuen Software VISWALK war die Simulation der Großveranstaltung Das Fest hier in Karlsruhe. Die Simulation von Fußgängerströmen ist eine noch junge Disziplin. Sie entwickelte sich zunächst für Evakuierungs- und Notfall-Szenarien. Heute dient die Fußgängersimulationssoftware beispielsweise der Planung in großen Bahnhöfen. Denn hängt die Frage, ob man einen Anschlußzug kann, nicht auch von der Problematik ab, dass man dabei von anderen Fahrgästen behindert wird? Außerdem ist die Untersuchung der von Effizienz von Laufwegen sehr hilfreich in der Planung von Bauvorhaben. In der Fußgängersimulation werden verschiedene Methoden aus der Mathematik und Physik benutzt. In der Arbeitsgruppe von Herrn Schreckenberg waren es vor allem Zellularautomaten. Im nun vorhandenen Modul VISWALK wurde bei der ptv vor allem auf das Social force Modell gesetzt, das auf einem Newtonschen Ansatz (also dem Zusammenhang von Kraft und Beschleunigung) beruht und auf eine Beschreibung durch Differentialgleichungen für die einzelnen Fußgänger führt. Dieses System muss numerisch gelöst werden. Die schrittweise Lösung entspricht dabei der zeitlichen Entwicklung der Bewegung. Die Grundidee beim Social Force Modell ist, dass man sich vorstellt, dass die am Fußgänger angreifende Kräfte seine Beschleunigung (inklusive der Richtung) verändern und damit seine Bewegung bestimmen. Das einfachste Modell ist der Wunsch das Ziel zu erreichen (driving force), denn es genügt dafür eine zum gewünschten Ziel ziehende starke Kraft. Dabei muss man aber anderen Fußgängern und Hindernissen ausweichen. Das Ausweichen kann man aber leider nicht in genau ein Modell (also genau ein erwartetes Verhalten) übersetzen; es gibt dazu einfach zu viele Einflussfaktoren. Physikalisch werden sie daher als abstoßende Kräfte im Nahfeld von anderen Fußgängern und Hindernissen modelliert. Wichtige Fragen, die im Algorithmus zu berücksichtigen sind, wären beispielsweise, wie nah geht ein typischer Fußgänger typischerweise an anderen Fußgängern vorbei geht, und welche Umwege typischerweise am attraktivsten erscheinen. Aus eigener Erfahrung kennt man den inneren Kampf, wie man mit Gruppen, die sozusagen als ein weiches Hindernis im Weg stehen, umgeht. Hindurchdrängeln vermeidet man oft. Das muss auch der Algorithmus so tun, wenn er menschliches Verhalten nachbilden soll. So kann man hier die Dichte der Gruppe in eine "Härte" des Hindernisses übersetzen. Je nachdem wie dicht gepackt der Raum ist, werden solche Entscheidungen aber auch unterschiedlich ausfallen. Berechnet wird natürlich stets die Bewegung des Schwerpunkts des Fußgängers. Für die visuelle Umsetzung im Programm wird das entsprechend graphisch aufbereitet, was natürlich auch einen gewissen Rechenaufwand verursacht. Das Modell selbst ist zeitkontinuierlich und so wird die Genauigkeit durch die für das numerische Verfahren gewählte Zeitschrittweite bestimmt. Etwa 20.000 Personen können zur Zeit in Echtzeit simuliert werden. Leider ist es im Programm bisher nahezu unmöglich zu berücksichtigen, wie sich Menschen in zusammen gehörenden Zweier- oder Dreier-Gruppen bewegen. Zum Glück ist das beispielsweise in der Simulation von Berufspendlern auf einem Bahnhof ein vernachlässigbares Phänomen. Ein weiterer Aspekt ist, dass die Ergebnisse der intern komplexen Simulation sich schließlich für den Verkehrsplaner in wenig komplexen Zahlenwerten spiegeln (wie in Dichten). Dabei muss auch eine Balance gefunden werden zwischen Komplexität des Modells und der Bedienbarkeit durch einen Verkehrsplaner im Arbeitsalltag. Zu einfache Modelle - wie solche, die nur Dichten von Personen berücksichtigen (sogenannte Makromodelle) - können eventuell nicht mehr wiedergeben, dass es in Korridoren gegenläufige Bewegungen gibt, was jedoch ein zentraler Aspekt der tatsächlichen Fußgängerbewegung ist. Daten zur Kalibrierung dieser Modelle sind nicht so einfach zu erheben. Eine Möglichkeit ist die Auswertung von Videos (z.B. von Überwachungskameras). Dabei weiß man natürlich nichts über den Hintergrund der beobachteten Personen (Alter, Größe, Dringlichkeit des Ortswechsels). In Laborexperimenten sind diese Informationen verfügbar, aber es bleibt immer eine künstliche Umgebung, die die Realitäts-Nähe der Ergebnisse potentiell gefährdet. Ein noch ganz neue

Crop Growth

This is the first of four conversation Gudrun had during the British Applied Mathematics Colloquium which took place 5th – 8th of April 2016 in Oxford. Josie Dodd finished her Master's in Mathematical and Numerical Modelling of the Atmosphere and Oceans at the University of Reading. In her PhD project she is working in the Mathematical Biology Group inside the Department of Mathematics and Statistics in Reading. In this group she develops models that describe plant and canopy growth of the Bambara Groundnut - especially the plant interaction when grown as part of a crop. The project is interdisciplinary and interaction with biologists is encouraged by the funding entity. Why is this project so interesting? In general, the experimental effort to understand crop growth is very costly and takes a lot of time. So it is a great benefit to have cheaper and faster computer experiments. The project studies the Bambara Groundnut since it is a candidate for adding to our food supply in the future. It is an remarkably robust crop, draught tolerant and nitrogent inriching, which means the production of yield does not depend on fertilizer. The typical plant grows 150 days per year. The study will find results for which verfication and paramater estimations from actual green house data is available. On the other hand, all experience on the modelling side will be transferable to other plants up to a certain degree. The construction of the mathematical model includes finding equations which are simple enough but cover the main processes as well as numerical schemes which solve them effectively. At the moment, temperature and solar radiation are the main input to the model. In the future, it should include rain as well. Another important parameter is the placement of the plants - especially in asking for arrangements which maximize the yield. Analyzing the available data from the experimental partners leads to three nonlinear ODEs for each plant. Also, the leave production has a Gaussian distribution relationship with time and temperature. The results then enter the biomass equation. The growth process of the plant is characterized by a change of the rate of change over time. This is a property of the plant that leads to nonlinearity in the equations. Nevertheless, the model has to stay as simple as possible, while firstly, bridging the gap to complicated and more precise models, and secondly, staying interpretable to make people able to use it and understand its behaviour as non-mathematicians. This is the main group for which the models should be a useful tool. So far, the model for interaction with neighbouring plants is the computational more costly part, where - of course - geometric consideration of overlapping have to enter the model. Though it does not yet consider many plants (since green house sized experimental data are available) the model scales well to a big number of plants due to its inherent symmetries. Since at the moment the optimizaition of the arrangements of plants has a priority - a lot of standardization and simplifying assumptions are applied. So for the future more parameters such as the input of water should be included, and it would be nice to have more scales. Such additional scales would be to include the roots system or other biological processes inside the plant. Of course, the green house is well controlled and available field data are less precise due to the difficulty of measurements in the field. During her work on the project and as a tutor Josie Dodd found out that she really likes to do computer programming. Since it is so applicable to many things theses skills open a lot of doors. Therefore, she would encourage everybody to give it a try. Literature and additional material Crops for the Future website Asha Sajeewani Karunaratne: Modelling the response of Bambara groundnut (Vigna subterranea (L.) Verdc) for abiotic stress, PhD thesis, University of Nottingham (2009). A.S. Karunaratne e.a.: Modelling the canopy development of bambara groundnut, Agricultural and Forest Meteorology 150, (7–8) 2010, 1007–1015.

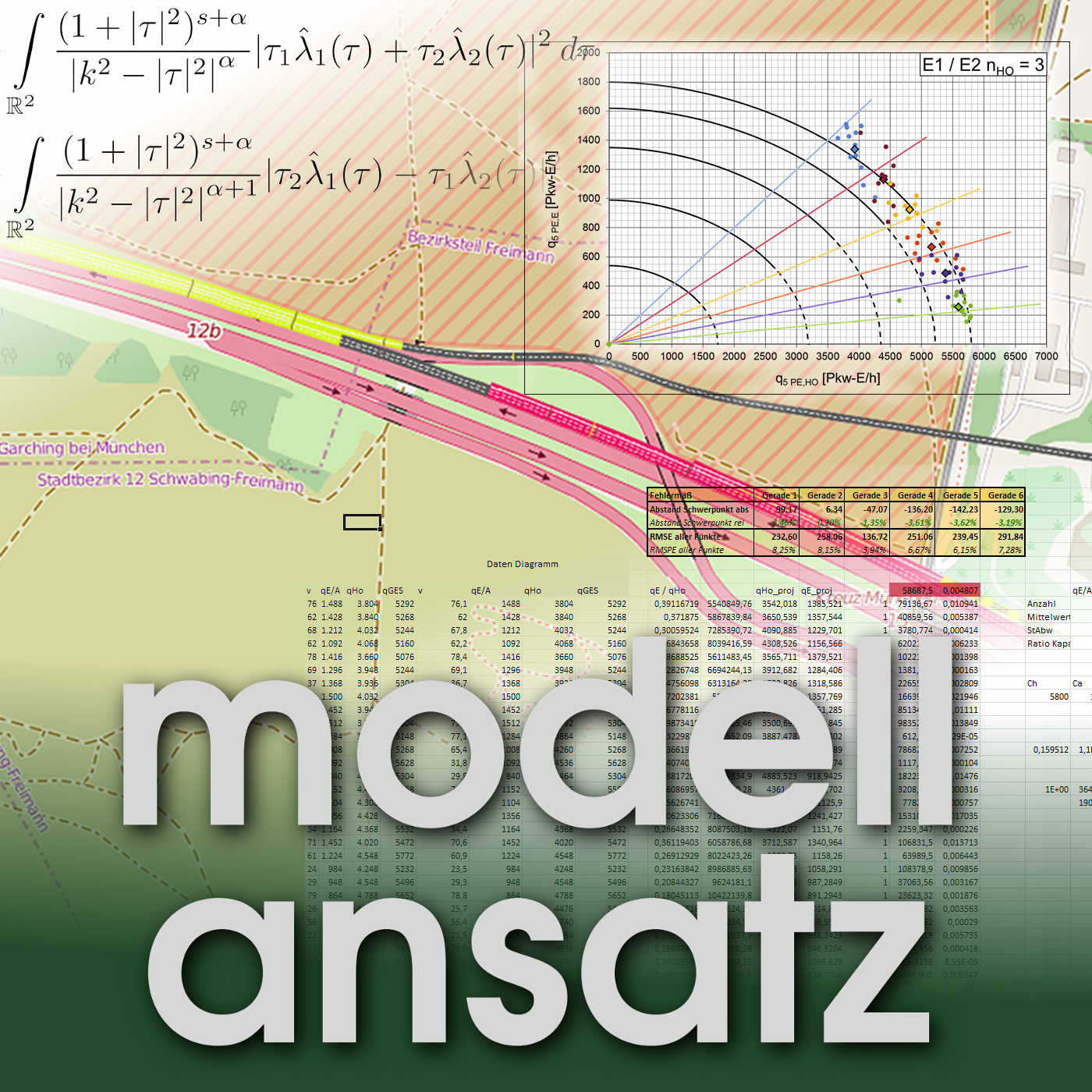

Verkehrswesen

Im Gespräch mit Ulrike Leyn wollten wir den Blick auf Aufgaben im heutigen Verkehrswesen richten. Wir begannen die Unterhaltung damit, zu erkunden, auf welchem Weg Ulrike Leyn zum Verkehrswesen gekommen ist und schließlich für das Thema Feuer gefangen hat. Am Anfang stand wohl ihre Entscheidung für das Studienfach Wirtschaftsingenieurwesen aus dem einfachen und sehr nachvollziehbaren Grund, sich damit thematisch nicht so stark festlegen zu müssen und im Anschluss sehr viele auch sehr verschiedenartige Möglichkeiten des beruflichen Einstiegs zu haben. Im Wirtschaftsingenieurwesen gibt es je nach Universität verschiedene Ausbildungsstrategien. An einigen muss man sich zu Beginn auf eine Ingenieurdisziplin festlegen, die dann mit ökonomischen Fächern kombiniert wird. In Karlsruhe ist die Ausbildung jedoch ingenieurtechnisch sehr breit angelegt. Es werden also Grundlagen für sehr verschiedene Ingenieurwissenschaften im Studium gelehrt und erst in der Vertiefung erfolgt eine Spezialisierung nach eigener Neigung. Außerdem ist auch der Anteil zwischen ökonomisch ausgerichteten und ingenieurstechnischen Fächern am Karlsruher Institut für Technologie (KIT) je nach persönlicher Wahl stark variabel. Das waren zwei Aspekte, die Ulrike Leyn darin bestärkten in Karlsruhe zu studieren. Für sie war es schließlich die Wahl der Fächerkombination 'Grundlagen der Raum- und Infrastrukturplanung', die zum ersten Schritt in die Richtung Verkehrwsesen wurde. Die Interdisziplinarität des Themas hat sie von Anfang an sehr angesprochen. Deshalb schrieb sie schließlich auch ihre Diplomarbeit am Institut für Verkehrswesen. Direkt im Anschluss begann sie, als wissenschaftliche Mitarbeiterin am Institut zu arbeiten. In ihrer jetzigen Tätigkeit im Verkehrswesen kann Ulrike Leyn vor allem ausnutzen, dass sie im Studium gelernt hat, sich in sehr viele verschiedene Probleme selbstständig einzuarbeiten. Außerdem erwies sich ihre Tätigkeit als Tutorin der Vorlesung Programmieren in Java als sehr hilfreich, um Simulationen anzupassen und automatisiert auszuwerten. In Karlsruhe am KIT ist Verkehrswesen als Teil des Bauingenieurwesens an der KIT-Fakultät für Bauingenieur-, Geo- und Umweltwissenschaften etabiliert. Inzwischen gibt es auch einen eigenen Master-Studiengang Mobilität und Infrastruktur. Neben der Möglichkeit als Ingenieurs-Vertiefung im Wirtschaftsingenieurwesen (und der technischen VWL) kann es auch als Zusatzfach in Informatik, Physik oder Wirtschaftsmathematik gewählt werden oder als technisches Fach im Master Technomathematik. Die Lehrangebote des Instituts erstrecken sich über mehrere Bereiche. Das Projekt, an dem Ulrike Leyn für lange Zeit gearbeitet hat und das gerade abgeschlossen wurde, soll die Möglichkeit bieten, Verkehrs-Simulation auf Computern so zu verwenden, dass man sie einfacher als Ergänzung bzw. Ersatz der Richtlinien im Handbuch für die Bemessung von Straßenverkehrsanlagen (HBS) einsetzen kann. Diese Richtlinie hilft die Qualitätsstufe von Anlagen einzuschätzen. Allerdings - insbesondere bei Nicht-Standard-Situationen ist es heute schon üblich, statt der stark vereinfachenden Rechnungen nach dieser Richtlinie, Simulationen zu benutzen. Denn die Voraussetzungen für die Anwendung der Richtlinien sind nur dann gegeben, wenn auch vorher Richtlinen-getreu gebaut wurde für Normalverkehrssituationen. Ein Schwerpunkt der Untersuchungen waren Autobahnen, wo z.B. Ein- und Ausfahrten und starke Anstiege besondere Herausforderungen an die Modellierung stellen. Das Ziel war kurz gesagt das Finden von Parametern, bei denen die durch Simulation erzeugten Ergebnisse denen nach der Richtlinie berechneten entsprechen. Das klingt einfacher als es ist. Ein generelles Problem ist beispielsweise, dass es häufig nicht genug verlässliche Verkehrsdaten gibt bzw. die Güte der Daten nicht offensichtlich ist. Trotzdem soll mit den so gefundenen Einstellungen der Realität möglichst gut entsprechende Simulationen möglich werden - sogar falls keine Daten vorhanden sind - wenn man nun mit den Einstellungen arbeitet, die im Projekt gefunden wurden. Die Parameter sind zugeschnitten auf die Situation auf deutschen Autobahnen (also auch ohne Tempolimit). Der Einfluss verschieden großer Anteile von Schwerverkehr auf der Autobahn wurde untersucht und als etwas vereinfachender Standard dann 10% gewählt. Es gibt neben Standard-LKWs auch längere Zugverbände, die dann mehr Platz brauchen. Das wird auch beim Einfädeln relevant. Bei der Bewertung der Güte der Modelle werden vor allem Endergebnisse von Simulationen für festgelegte makroskopische Größen wie z.B. die Kapazität der Strecke (nämlich typischerweise etwa 2000 PKW-Einheiten pro Fahrstreifen pro Stunde) zugrunde gelegt. Das Messen der Kapazität ist aber gar nicht so einfach, weil man eigentlich nur konkrete Fahrzeuganzahlen pro Zeit- oder Raumeinheit der Simulation oder der Realität entnehmen kann. Die Kapazität ist die Obergrenze für realisierbare Dichten, also das, was kurz vor dem Zusammenbrechen

Perkolation